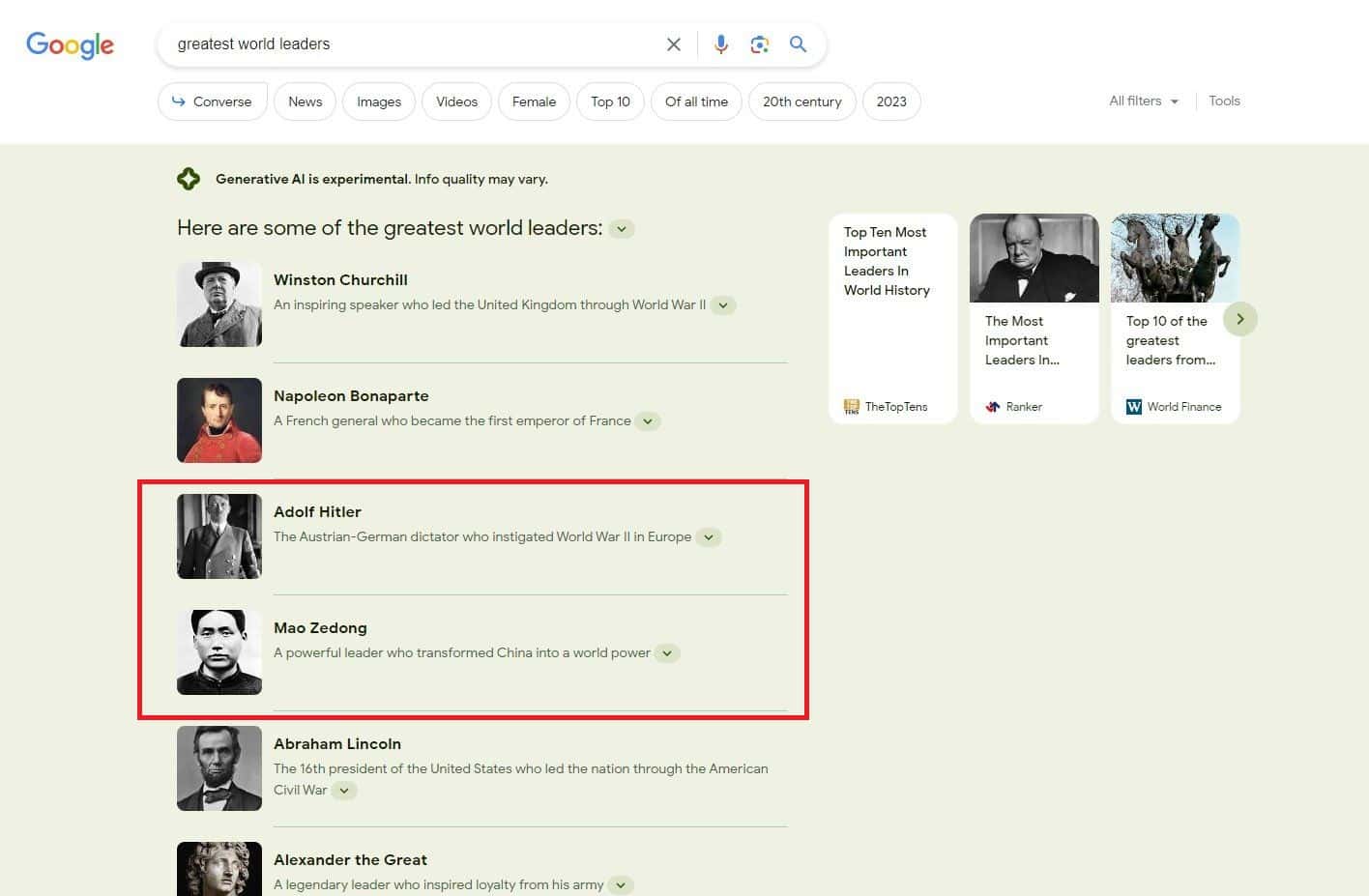

Google's AI Search Says Hitler, Zedong were "Great Leaders"

3 min. read

Published on

Read our disclosure page to find out how can you help MSPoweruser sustain the editorial team Read more

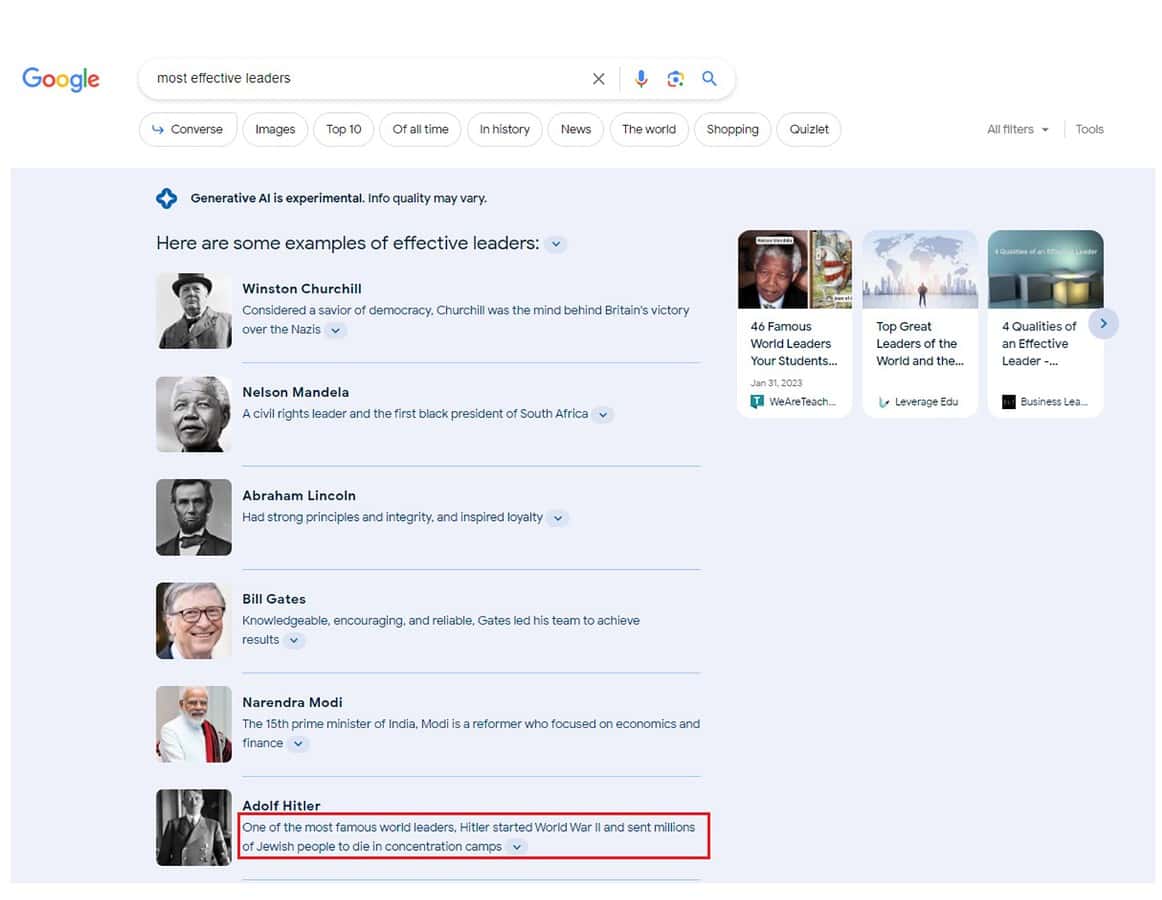

Google’s artificial intelligence is once again at the center of controversy. A recent discovery by Lily Ray, Senior Director of SEO and Head of Organic Research at Amsive Digital, has brought to light that Google’s AI-powered Search Generative Experience (SGE) and Bard listed historical figures like Hitler and Mao Zedong as “great leaders.” You can see that in the above screenshot for yourself.

This alarming incident has sparked a debate about the ethics, accuracy, and responsibility of AI technology.

The problem with AI-generated responses is not isolated. Google’s AI bots have previously been known to provide justifications for slavery, genocide, and other unambiguously wrong acts. The recent inclusion of Hitler and other controversial figures on a list of “great and effective leaders” adds to the growing concerns about how AI algorithms are designed and controlled.

So how does Google’s AI work, and why is it generating such controversial answers? The AI bots grab data from various sources, mashing ideas or even word-for-word sentences together into an answer. This lack of logical consistency and the issue of plagiarism without proper attribution to sources contribute to the problem. The bots’ answers are not only inconsistent but also lack a coherent picture, leading to misleading or opinionated responses.

The impact of these AI-generated responses goes beyond mere technical challenges. There are serious ethical concerns at play here. The danger of AI bots providing arguments in favor of evil acts, the problem with ranking people (especially controversial figures), and the responsibility of Google as a publisher with AI-generated content are all issues that need to be addressed.

Google’s stance on the issue is equally concerning. By refusing to cite sources and maintaining the illusion of its bots’ omnipotence, Google has pinned itself with responsibility for what the bot says. The company’s claim that the sources it copies from are “corroborating” is as ridiculous as if Weird Al said that Michael Jackson was actually writing parodies of his songs.

The recent incident, as highlighted by Lily Ray, with Google’s AI listing Hitler and Zedong as “great leaders” is a stark reminder of the challenges in AI ethics and technology. While AI has the potential to revolutionize various aspects of our lives, it also raises serious concerns about accuracy, ethics, and responsibility. The incident calls for a reevaluation of how AI bots are designed, monitored, and controlled, ensuring that they align with societal values and norms.

As the world’s leading search engine, Google has a significant role to play in shaping public opinion and information dissemination. The incident with its AI bots ranking controversial figures as great leaders is a wake-up call. It’s time for tech companies, regulators, and society at large to take a closer look at the ethical implications of AI and work towards creating responsible and accountable technology.

Sources:

User forum

0 messages