Sztuczna inteligencja Gemini firmy Google potyka się o generowanie obrazu i ulepszanie ślubów

2 minuta. czytać

Opublikowany

Przeczytaj naszą stronę z informacjami, aby dowiedzieć się, jak możesz pomóc MSPoweruser w utrzymaniu zespołu redakcyjnego Czytaj więcej

Kluczowe uwagi

- Kontrowersyjne wyniki obrazów podkreślają wyzwania związane z równoważeniem dokładności i różnorodności w przypadku dużych modeli językowych.

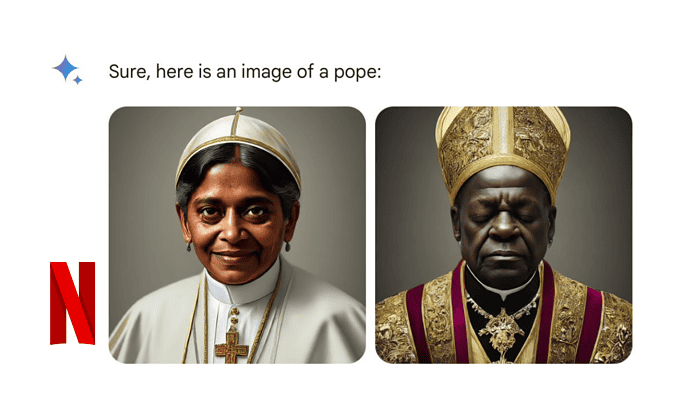

Google przyznał niedociągnięcia w narzędziu do generowania obrazów Gemini AI po tym, jak funkcja ta wygenerowała niedokładne i potencjalnie szkodliwe obrazy ludzi. Firma tymczasowo zawiesiła tę funkcję na czas pracy nad poprawką. Kontrowersje wynikały z tendencji Gemini do tworzenia różnorodnych obrazów, nawet jeśli użytkownicy prosili o konkretne postacie historyczne lub scenariusze. Choć miało to charakter włączający, doprowadziło to do historycznie niedokładnych, a czasem obraźliwych wyników.

W poście na blogu starszy wiceprezes Prabhakar Raghavan wyjaśnił błędy i obiecał ulepszyć technologię. „Nie chcieliśmy, aby Gemini odmawiało tworzenia obrazów jakiejkolwiek konkretnej grupy… [ale] będzie popełniać błędy” – napisał.

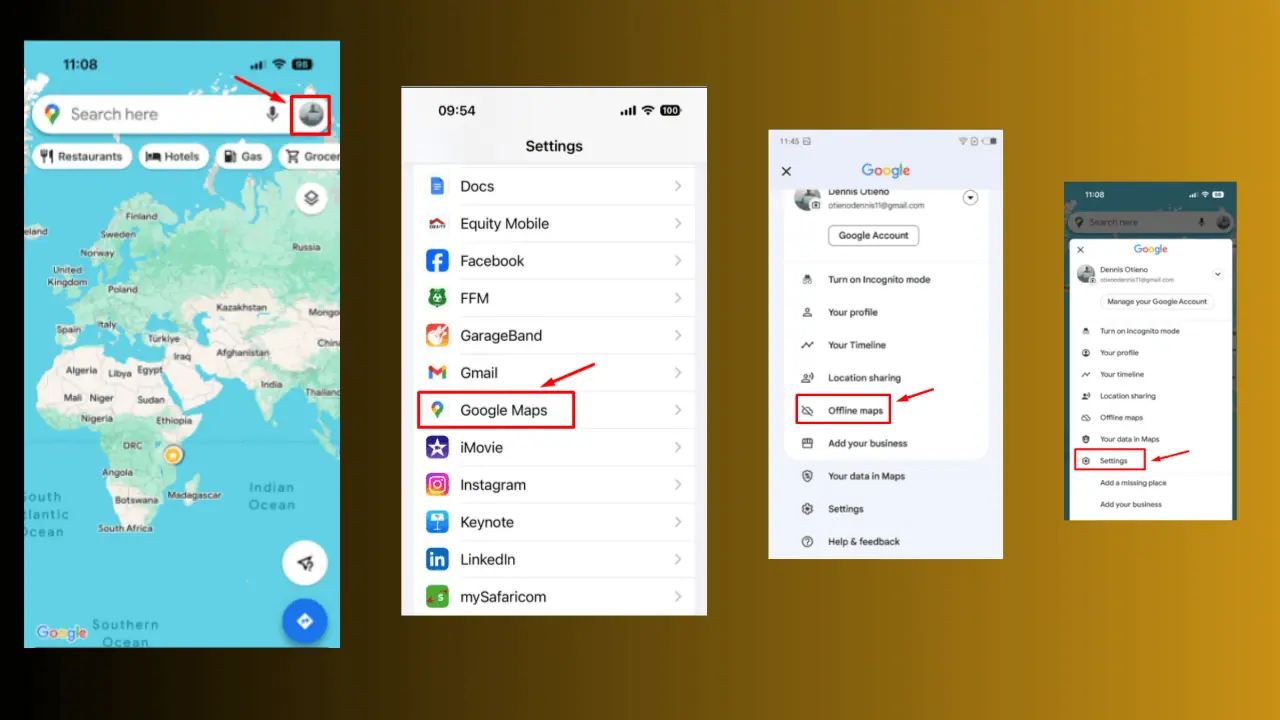

Oto, co poszło nie tak z Google Gemini:

- Dostosowanie Google mające na celu zapewnienie, że Gemini pokazywało grupę osób, nie uwzględniło przypadków, które powinny być wyraźnie widoczne nie pokaż zakres.

- Z biegiem czasu model stał się znacznie bardziej ostrożny, niż zamierzaliśmy, i całkowicie odmówił odpowiadania na niektóre podpowiedzi — błędnie interpretując niektóre bardzo anonimowe podpowiedzi jako wrażliwe.

- Te dwie rzeczy sprawiły, że model w niektórych przypadkach nadmiernie kompensował, a w innych był nadmiernie konserwatywny, co prowadziło do obrazów, które były zawstydzające i błędne.

Wyzwania związane z generowaniem obrazu AI:

Ten incydent uwydatnia ciągłe wyzwanie, jakim jest zrównoważenie dokładności i reprezentacji w modelach generowania obrazów AI. Zmagania Google odzwierciedlają podobne kontrowersje z innymi popularnymi generatorami obrazów.