Czy samochody bez kierowcy są naprawdę dokładne? Naukowcy z Duke University twierdzą, że można ich oszukać

3 minuta. czytać

Opublikowany

Przeczytaj naszą stronę z informacjami, aby dowiedzieć się, jak możesz pomóc MSPoweruser w utrzymaniu zespołu redakcyjnego Czytaj więcej

Samochody bez kierowcy obiecują komfort i bezpieczeństwo kierowcom i pasażerom, ale może się to zmienić wraz z odkryciem naukowców z Duke University. Według zespołu istnieje strategia ataku, którą przestępcy mogą zastosować, aby oszukać czujniki pojazdów autonomicznych (połączenie danych 2D z kamery i dane 3D z LiDAR), aby dostrzec pobliskie obiekty bliżej lub dalej, niż się wydaje. Może to oznaczać problemy i znaczne uszkodzenia, zwłaszcza w sytuacjach wojskowych, w których pojedynczy pojazd stanowi cenny cel. Co więcej, naukowcy podkreślili, że hakerzy mogą znaleźć sposób na jednoczesne zaatakowanie różnych pojazdów.

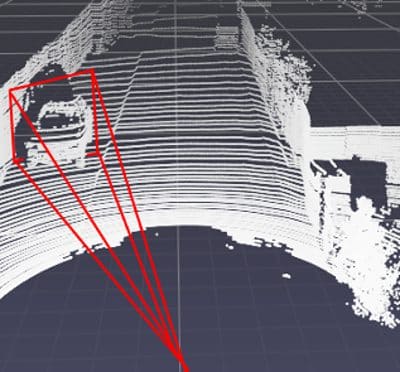

„Naszym celem jest zrozumienie ograniczeń istniejących systemów, abyśmy mogli chronić się przed atakami” – powiedział Miroslav Pajic, profesor nadzwyczajny inżynierii elektrycznej i komputerowej Dickinson Family w Duke. „To badanie pokazuje, jak dodanie zaledwie kilku punktów danych w chmurze punktów 3D, przed lub za miejscem, w którym faktycznie znajduje się obiekt, może zmylić te systemy do podejmowania niebezpiecznych decyzji”.

Według naukowców, wada systemu pojawi się, gdy do czujnika LIDAR zostanie użyty pistolet laserowy. Spowoduje to zniekształcenie postrzegania samochodu przez dodanie fałszywych punktów danych. Według Pajica system może to wykryć atakować jeśli punkty danych znacznie różnią się od tego, co widzi kamera samochodu. Jednak według badań Duke'a system może zostać oszukany, gdy punkty danych 3D LIDAR zostaną precyzyjnie umieszczone w określonym obszarze pola widzenia kamery 2D.

Tworzy to obszar podatny na ataki. Ma kształt frustum wyciągniętego przed obiektyw aparatu lub trójwymiarowej piramidy z odciętą końcówką.

„Ten tak zwany atak frustum może oszukać tempomat adaptacyjny, tak by pomyślał, że pojazd zwalnia lub przyspiesza” – powiedział Pajic. „A zanim system zorientuje się, że istnieje problem, nie będzie sposobu na uniknięcie uderzenia w samochód bez agresywnych manewrów, które mogłyby spowodować jeszcze więcej problemów”.

Pajic i jego zespół na szczęście mają realne rozwiązanie tego ryzyka dzięki dodatkowej redundancji, takiej jak kamery stereofoniczne z nakładającymi się polami widzenia. Według nich te technologie będą współpracować, aby właściwie obliczyć odległości i określić błąd między danymi LIDAR a percepcją kamery.

„Kamery stereoskopowe z większym prawdopodobieństwem zapewnią wiarygodną kontrolę spójności, chociaż żadne oprogramowanie nie zostało wystarczająco zweryfikowane, aby określić, czy dane LIDAR/kamer stereo są spójne lub co zrobić, jeśli okaże się, że są niespójne”, powiedział Spencer Hallyburton, główny autor opracowania i doktorant. kandydat w Cyber-Physical Systems Lab firmy Pajic. „Ponadto perfekcyjne zabezpieczenie całego pojazdu wymagałoby wielu zestawów kamer stereo wokół całego nadwozia, aby zapewnić 100% pokrycie”.

Pajic wprowadził również stworzenie systemu, który pozwoli samochodom znajdującym się blisko siebie na dzielenie się danymi. Badania i sugestie zespołu zostaną zaprezentowane od 10 do 12 sierpnia na sympozjum bezpieczeństwa USENIX 2022.