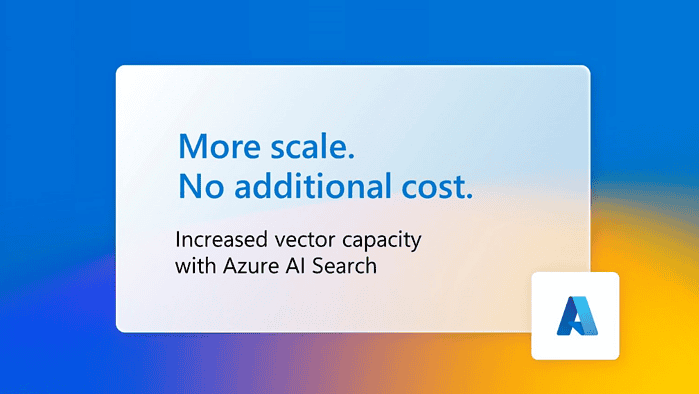

Azure AI Search vergroot nu de opslagcapaciteit en de vectorindexgrootte. Dit is wat er is veranderd

Deze update verlaagt de kosten aanzienlijk.

2 minuut. lezen

Uitgegeven op

Lees onze openbaarmakingspagina om erachter te komen hoe u MSPoweruser kunt helpen het redactieteam te ondersteunen Lees meer

Belangrijkste opmerkingen

- RAG-apps gaan in 2024 live en moeten kosteneffectief kunnen worden opgehaald.

- Azure AI Search vergroot de opslag en het zoeken naar vectoren en blijft efficiënt.

- Upgrades zorgen voor betere prestaties en schaalbaarheid.

Microsoft heeft zojuist onlangs aangekondigd dat het de opslagcapaciteit en de vectorindexgrootte van Azure AI Search, de populaire AI-aangedreven tool voor ontwikkelaars, uitbreidt.

De aankondiging kwam net op het moment dat RAG-apps in 2024 live gaan, dus mensen hebben behoefte aan kosteneffectief ophalen. Nu bieden in bepaalde regio's de nieuwe Basic- en Standard-tier-services meer opslagruimte en verwerkingskracht, vooral voor het vinden van vectoren, tekst en metagegevens. Deze update verlaagt de kosten aanzienlijk, waarbij de prijs per vector met ongeveer 85% daalt en de totale opslagkosten met wel 75% of meer worden verlaagd.

Deze upgrades betekenen ook dat u meer gegevens per partitie kunt opslaan, grotere vectorindexen kunt gebruiken en kunt profiteren van snellere prestaties voor taken als indexeren en zoeken.

Het bedrijf verbetert ook de manier waarop vectorzoeken werkt en bespaart opslagruimte. Nu kunt u technieken als kwantisering en oversampling gebruiken en instellingen aanpassen om het opslaggebruik met wel 75% te verminderen. Bovendien kan het instellen van de eigenschap “Opgeslagen” op vectorvelden de opslagoverhead verder verminderen

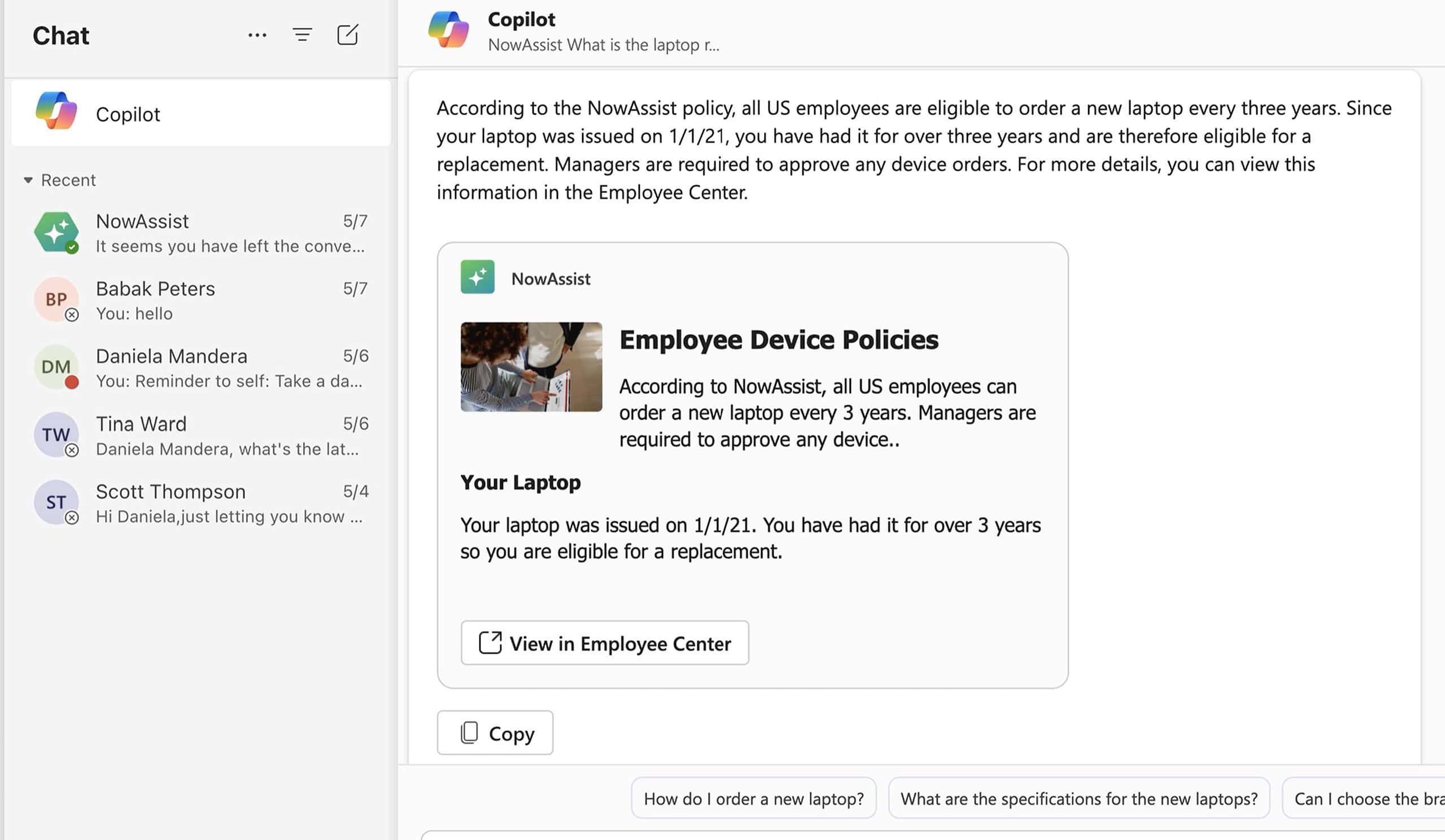

Azure AI Search is een tool waarmee u eenvoudig geavanceerde zoekfuncties en AI-aangedreven applicaties kunt creëren door taalmodellen te combineren met bedrijfsgegevens. Het helpt ontwikkelaars bij het bouwen van zoekfuncties voor mobiele apps of webapps, of het nu voor hun bedrijf is of voor de software die ze als service aanbieden.

Nog niet zo lang geleden zei Microsoft ook dat Cohere's nieuwe Command R+-model is nu beschikbaar als een van de honderden taalmodellen in Azure AI. Het model, dat zojuist vandaag is gelanceerd, heeft 104B-parameters en zou beter en goedkoper zijn dan GPT-4 Turbo.

Meer details over de verhoogde capaciteit kunt u vinden hier.