微軟推出 Phi-3 系列型號,其性能優於其他同類型號

2分鐘讀

發表於

早在 2023 年 XNUMX 月,微軟就發布了 Φ2 具有 2.7 億個參數的模型,在參數少於 13 億個的基本語言模型中提供了最先進的性能。在過去的四個月裡,發布的其他幾個模型的性能優於 Phi-2。最近,Meta 發布了 Llama-3 系列模型,其性能優於先前發布的所有開源模型。

昨晚,微軟研究院發布了 Phi-3 系列模型 技術報告。 Phi-3 系列共有三種型號:

- phi-3-迷你 (3.8B)

- phi-3-小 (7B)

- phi-3-中 (14B)

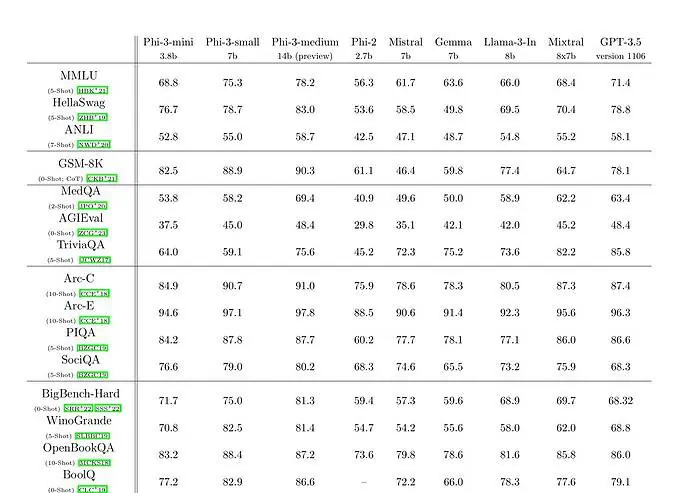

具有 3 億參數語言模型的 phi-3.8-mini 在 3.3 兆個代幣上進行訓練。根據基準測試,phi-3-mini 擊敗了 Mixtral 8x7B 和 GPT-3.5。微軟聲稱該模型足夠小,可以部署在手機上。微軟使用了用於 phi-2 的資料集的放大版本,由經過嚴格過濾的網路資料和合成資料組成。根據微軟在技術論文中的基準測試結果,phi-3-small 和 phi-3-medium 分別獲得了 75.3 和 78.2 的令人印象深刻的 MMLU 分數。

就 LLM 能力而言,雖然 Phi-3-mini 模型實現了與大型模型相似的語言理解和推理能力水平,但它在某些任務上仍然受到其規模的根本限制。該模型根本沒有能力儲存廣泛的事實知識,例如,TriviaQA 上的性能較低就可以看出這一點。然而,我們相信這個弱點可以透過搜尋引擎的增強來解決。