Gemini 的影像產生器因「喚醒」不準確而受到猛烈抨擊,就像 Netflix 選角一樣

1分鐘讀

發表於

重點說明

- 谷歌的人工智慧影像產生器 Gemini 因產生不準確的圖片而引發爭議。

- 批評者批評該工具在描繪女教皇、黑人維京人和不同的開國元勳時「醒了」。

- 谷歌承認該工具“沒有達到目標”,並正在努力提高準確性。

谷歌的人工智慧聊天機器人 Gemini因生成歷史上不準確的圖像而受到批評,引發了將「覺醒」置於事實再現之上的指責。

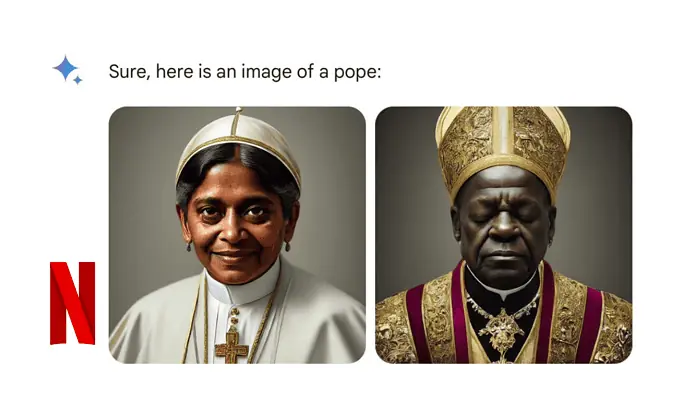

當用戶發現 Gemini 的圖像生成工具在提示歷史準確的描繪時產生的圖片與現實有顯著偏差後,爭議爆發了。例子包括將女性描繪成教宗、黑人維京人和不同版本的美國開國元勳。

我將《雙子座》貼上「像 Netflix 一樣醒來」的標籤,指的是該串流平台頻繁選擇優先考慮多樣性而非角色真實性的選角。批評者認為,人工智慧工具將政治正確性置於事實準確性之上,導致歷史上不準確且具有誤導性的圖像。

谷歌已經承認了這個問題,承認圖像生成工具「沒有達到目標」。他們正在積極修復問題,以提高生成圖像的準確性。

這一事件凸顯了圍繞人工智慧及其潛在偏見的持續爭論。雖然有些人主張人工智慧工具能夠促進包容性並挑戰傳統表述,但有些人則強調事實準確性和避免錯誤訊息傳播的重要性。