Gemini 的图像生成器因“唤醒”不准确而受到猛烈抨击,就像 Netflix 选角一样

1分钟读

发表于

重点说明

- 谷歌的人工智能图像生成器 Gemini 因生成不准确的图片而引发争议。

- 批评者批评该工具在描绘女教皇、黑人维京人和不同的开国元勋时“醒了”。

- 谷歌承认该工具“没有达到目标”,并正在努力提高准确性。

谷歌的人工智能聊天机器人 Gemini因生成历史上不准确的图像而受到批评,引发了将“觉醒”置于事实再现之上的指责。

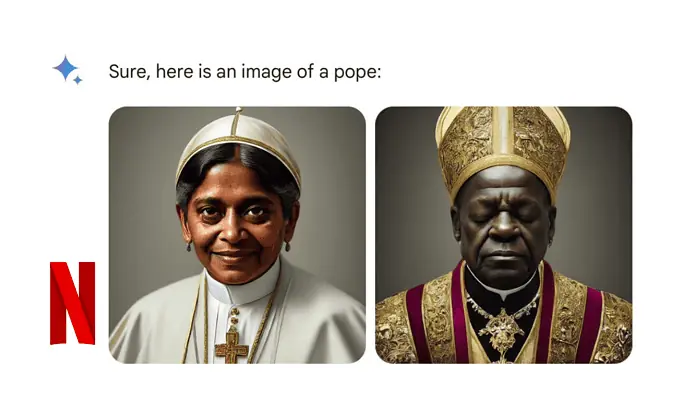

当用户发现 Gemini 的图像生成工具在提示历史准确的描绘时生成的图片与现实存在显着偏差后,争议爆发了。例子包括将女性描绘成教皇、黑人维京人和不同版本的美国开国元勋。

我将《双子座》贴上“像 Netflix 一样醒来”的标签,指的是该流媒体平台频繁选择优先考虑多样性而非角色真实性的选角。批评者认为,人工智能工具将政治正确性置于事实准确性之上,从而导致历史上不准确且具有误导性的图像。

谷歌已经承认了这个问题,承认图像生成工具“没有达到目标”。他们正在积极修复问题,以提高生成图像的准确性。

这一事件凸显了围绕人工智能及其潜在偏见的持续争论。虽然一些人主张人工智能工具能够促进包容性并挑战传统表述,但另一些人则强调事实准确性和避免错误信息传播的重要性。