Samsung наказує загальну заборону штучного інтелекту для співробітників через проблеми безпеки

3 хв. читати

Опубліковано

Прочитайте нашу сторінку розкриття інформації, щоб дізнатися, як ви можете допомогти MSPoweruser підтримувати редакційну команду Читати далі

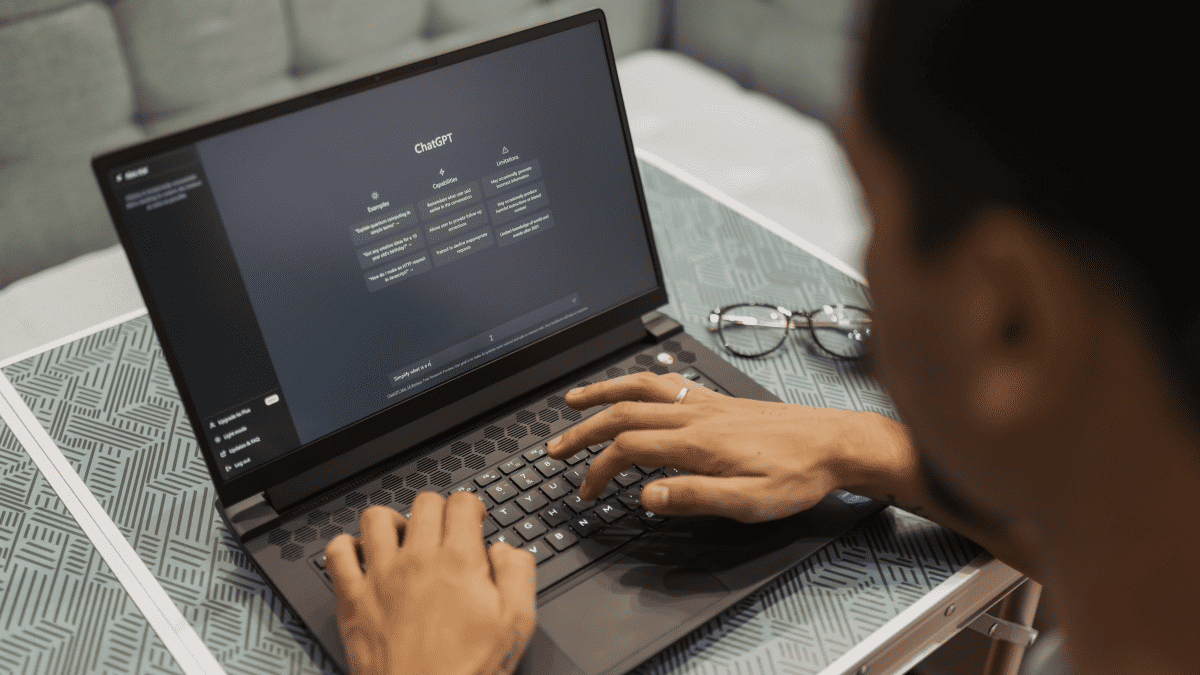

Samsung не хоче, щоб його персонал повністю довіряв генеруючому штучному інтелекту ChatGPT коли йдеться про конфіденційну інформацію компанії. Таким чином, південнокорейська компанія зараз забороняє використання генеративних служб ШІ серед своїх працівників.

«Ми просимо вас ретельно дотримуватися наших інструкцій з безпеки, і недотримання цього може призвести до порушення або компрометації інформації компанії, що призведе до дисциплінарних стягнень, аж до звільнення», — йдеться в меморандумі Samsung, ознайомленому з Bloomberg News.

Згідно зі звітом, у квітні компанія провела опитування, яке показало, що 65% респондентів вважають, що використання інструментів ШІ на робочому місці може призвести до можливих проблем з безпекою. Цікаво, що минулого місяця Samsung також виявила, що деякі з її інженерів «випадково» злили внутрішній вихідний код, коли вони завантажували його в ChatGPT у квітні.

У звіті йдеться про те, що Samsung опублікував меморандум, наголошуючи на проблемах безпеки. Він побоюється, що конфіденційна інформація, надіслана до інструментів ШІ, зберігається на зовнішніх серверах, які знаходяться поза контролем Samsung і можуть призвести до публічного витоку.

Меморандум попереджав співробітників певного підрозділу про використання генеративних інструментів штучного інтелекту та закликав їх дотримуватися політики компанії, підкреслюючи, що ті, хто відмовляється це робити, можуть бути покарані. Незважаючи на попередження, Samsung зазначив у пам’ятці для персоналу, що це буде тимчасово, поділяючи наміри «створити безпечне середовище» для використання таких технологій, як ChatGPT.

«Штаб-квартира переглядає заходи безпеки, щоб створити безпечне середовище для безпечного використання генеративного штучного інтелекту для підвищення продуктивності та ефективності співробітників», — йдеться в записці. «Однак, поки ці заходи не будуть підготовлені, ми тимчасово обмежуємо використання генеративного ШІ».

Samsung приєдналася до інших компаній (наприклад, JPMorgan Chase & Co., Bank of America Corp. і Citigroup Inc.), які вже заборонили використання генеративного штучного інтелекту у своїх відповідних місцях через ті ж проблеми. Тим не менш, крок таких компаній не є несподіванкою — особливо після нещодавньої помилки ChatGPT, яка тимчасово розкрила історію чату та, можливо, платіжну інформацію. І враховуючи, що OpenAI міг отримати доступ до інформації, яка надсилалася до його творіння ChatGPT, компанії мають повне право побоюватися, що їхні співробітники використовуватимуть такий інструмент ШІ.

Незважаючи на це, OpenAI завжди активно застерігав своїх користувачів не ділитися «будь-якою конфіденційною інформацією». як пояснені самим OpenAI, він «може використовувати Контент, який ви нам надаєте, для покращення наших Сервісів, наприклад, для навчання моделей, які використовують ChatGPT». Однак важливо зазначити, що ChatGPT уже має функцію анонімного режиму. Проте це може бути недостатньою гарантією для компаній, особливо тому, що проста проблема безпеки може спричинити величезну катастрофу для бізнесу.