Opera стає першим браузером, який інтегрує локальні LLM

1 хв. читати

Оновлено на

Прочитайте нашу сторінку розкриття інформації, щоб дізнатися, як ви можете допомогти MSPoweruser підтримувати редакційну команду Читати далі

Основні нотатки

- Тепер користувачі можуть безпосередньо керувати та отримувати доступ до потужних моделей штучного інтелекту на своїх пристроях, пропонуючи підвищену конфіденційність і швидкість порівняно з хмарним штучним інтелектом.

Опера сьогодні оголошений експериментальна підтримка 150 локальних великих мовних моделей (LLM) у своєму браузері розробника Opera One. Завдяки цій підтримці користувачі тепер можуть безпосередньо керувати та отримувати доступ до потужних моделей штучного інтелекту на своїх пристроях, пропонуючи підвищену конфіденційність і швидкість порівняно з хмарним штучним інтелектом.

Розширений вибір і конфіденційність з місцевими магістрами права

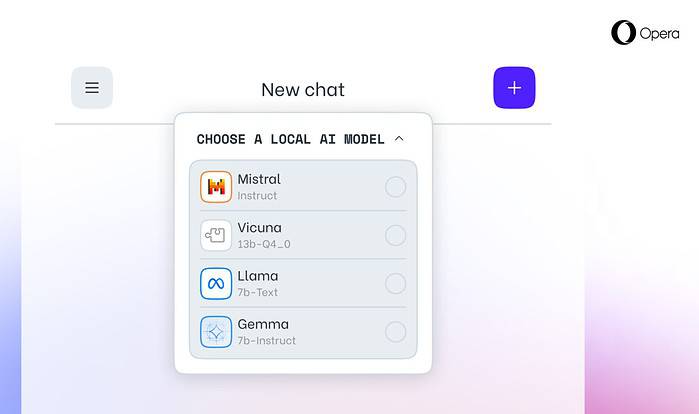

Інтеграція Opera включає такі популярні LLM, як Llama від Meta, Vicuna, Gemma від Google, Mixtral від Mistral AI та багато інших. Локальні LLM усувають необхідність обмінюватися даними з серверами, захищаючи конфіденційність користувачів. Програма AI Feature Drops від Opera надає розробникам ранній доступ до цих передових функцій.

Як отримати доступ до локальних LLM в Opera

Користувачі можуть відвідувати Сайт розробника Opera оновити до Opera One Developer, дозволяючи вибирати та завантажувати бажаний локальний LLM. Незважаючи на потребу в пам’яті (2–10 ГБ на модель), локальні LLM можуть запропонувати значне підвищення швидкості порівняно з хмарними альтернативами, залежно від апаратного забезпечення.

Відданість Opera інноваціям ШІ

«Такий спосіб представлення локальних LLM дозволяє Opera почати досліджувати шляхи створення досвіду та ноу-хау в швидкозростаючому локальному просторі штучного інтелекту», — сказав Крістіан Колондра, виконавчий віце-президент Opera з браузерів та ігор.