Microsoft представляє сімейство моделей Phi-3, які перевершують інші моделі свого класу

2 хв. читати

Опубліковано

Прочитайте нашу сторінку розкриття інформації, щоб дізнатися, як ви можете допомогти MSPoweruser підтримувати редакційну команду Читати далі

Ще в грудні 2023 року Microsoft випустила Фі-2 модель із 2.7 мільярда параметрів, яка забезпечила найсучаснішу продуктивність серед моделей базової мови з менш ніж 13 мільярдами параметрів. За останні чотири місяці кілька інших моделей, які були випущені, перевершили Phi-2. Нещодавно Meta випустила сімейство моделей Llama-3, які перевершили всі раніше випущені моделі з відкритим кодом.

Вчора ввечері Microsoft Research анонсувала сімейство моделей Phi-3 через технічний звіт. У сімействі Phi-3 є три моделі:

- фі-3-міні (3.8B)

- фі-3-малий (7Б)

- фі-3-середній (14B)

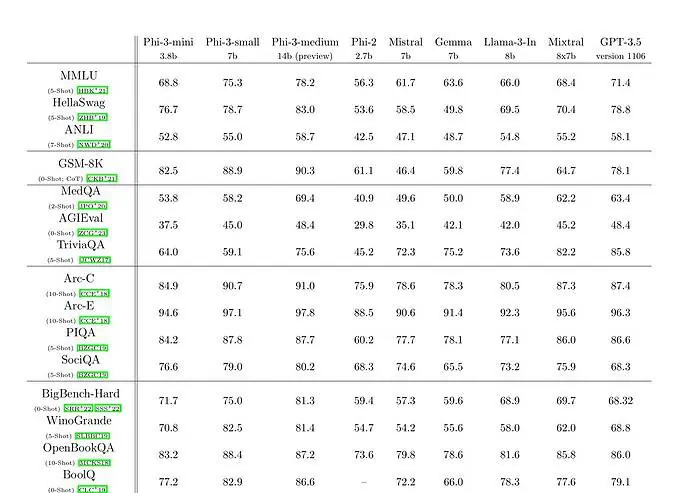

phi-3-mini з мовною моделлю з 3.8 мільярда параметрів навчається на 3.3 трильйона токенів. Згідно з тестами, phi-3-mini перевершує Mixtral 8x7B і GPT-3.5. Microsoft стверджує, що ця модель досить мала, щоб її можна було розгорнути на телефоні. Корпорація Майкрософт використала збільшену версію набору даних, який використовувався для phi-2, що складається з ретельно відфільтрованих веб-даних і синтетичних даних. Згідно з результатами порівняльного тесту Microsoft у Technical Paper, phi-3-small і phi-3-medium досягли вражаючого результату MMLU 75.3 і 78.2 відповідно.

З точки зору можливостей LLM, хоча модель Phi-3-mini досягає такого ж рівня розуміння мови та здатності міркувати, як і набагато більші моделі, вона все ще фундаментально обмежена своїм розміром для певних завдань. Модель просто не має можливості зберігати великі фактичні знання, що можна побачити, наприклад, у низькій продуктивності на TriviaQA. Однак ми вважаємо, що цю слабкість можна усунути шляхом доповнення за допомогою пошукової системи.