Microsoft เปิดตัวชุดเครื่องมือ 'PyRIT' เพื่อช่วยปกป้องระบบ Generative AI

2 นาที. อ่าน

เผยแพร่เมื่อ

อ่านหน้าการเปิดเผยข้อมูลของเราเพื่อดูว่าคุณจะช่วย MSPoweruser รักษาทีมบรรณาธิการได้อย่างไร อ่านเพิ่มเติม

หมายเหตุสำคัญ

-

บริษัทซอฟต์แวร์ยักษ์ใหญ่เปิดตัวเฟรมเวิร์กโอเพ่นซอร์สเพื่อให้ผู้เชี่ยวชาญด้านความปลอดภัยสามารถค้นหาช่องโหว่ในโมเดล AI ได้ในเชิงรุก

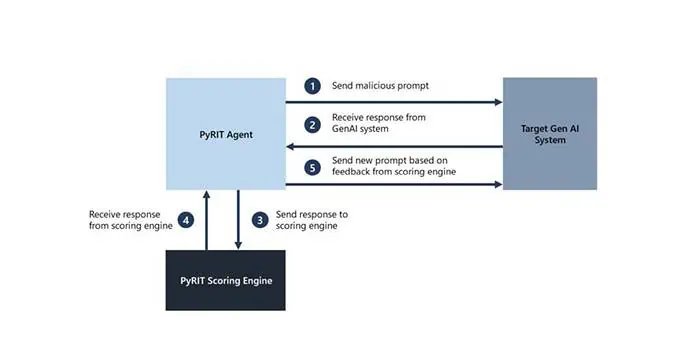

Microsoft วันนี้ ประกาศ การเปิดตัว PyRIT (Python Risk Identification Toolkit) ซึ่งเป็นเฟรมเวิร์กการทำงานอัตโนมัติแบบโอเพ่นซอร์สที่ช่วยให้ทีมรักษาความปลอดภัยสามารถระบุความเสี่ยงภายในระบบ AI เชิงสร้างสรรค์ ความเคลื่อนไหวดังกล่าวตอกย้ำความมุ่งมั่นอย่างลึกซึ้งของ Microsoft ในการพัฒนา AI อย่างมีความรับผิดชอบ และสร้างเครื่องมือที่ปลอดภัยสำหรับภูมิทัศน์ AI เชิงสร้างสรรค์ที่ขยายตัวอย่างรวดเร็ว

AI Red Teaming Automation: ความจำเป็น

Red teaming ซึ่งเป็นกระบวนการจำลองการโจมตีเพื่อทดสอบการป้องกัน มีความสำคัญอย่างยิ่งต่อ Generative AI อย่างไรก็ตาม ระบบเหล่านี้มีความซับซ้อนและมีจุดล้มเหลวหลายจุด ไม่เหมือนซอฟต์แวร์แบบเดิม ประสบการณ์ที่กว้างขวางของ Microsoft ในด้าน AI red teaming นำไปสู่การสร้าง PyRIT ซึ่งจัดการกับความท้าทายเฉพาะที่เกิดจาก generative AI

“แม้ว่าระบบอัตโนมัติจะไม่สามารถแทนที่ทีมงานสีแดงที่เป็นมนุษย์ได้อย่างสมบูรณ์ แต่ก็เป็นสิ่งจำเป็นสำหรับการปรับขนาดความพยายามและเน้นย้ำถึงส่วนที่ต้องมีการตรวจสอบเชิงลึก” Microsoft กล่าว

PyrRIT: คุณสมบัติหลักและคุณประโยชน์

- ปรับตัว: ทำงานร่วมกับโมเดล AI เจนเนอเรชั่นต่างๆ และสามารถขยายเพื่อรองรับอินพุตประเภทใหม่ๆ (เช่น รูปภาพ วิดีโอ)

- ชุดข้อมูลที่เน้นความเสี่ยง: เปิดใช้งานการทดสอบทั้งปัญหาด้านความปลอดภัยและอคติหรือความไม่ถูกต้องที่อาจเกิดขึ้น

- เครื่องมือการให้คะแนนที่ยืดหยุ่น: อนุญาตให้ให้คะแนนเอาต์พุต AI โดยใช้การเรียนรู้ของเครื่องหรือ LLM โดยตรงสำหรับการทดสอบตัวเอง

- กลยุทธ์การโจมตีแบบหลายเทิร์น: จำลองการโจมตีต่อเนื่องและสมจริงยิ่งขึ้นสำหรับการทดสอบเชิงลึก

- ความสามารถของหน่วยความจำ: อำนวยความสะดวกในการวิเคราะห์และช่วยให้มีการโต้ตอบที่ยาวนานและซับซ้อนยิ่งขึ้น

ผลกระทบทั่วทั้งอุตสาหกรรม

การเปิดตัวของ PyRIT จะสร้างกระแสในอุตสาหกรรมความปลอดภัยของ AI Microsoft สนับสนุนให้องค์กรต่างๆ ทั่วทั้งภาคส่วนใช้ PyRIT ในการดำเนินการรักษาความปลอดภัย AI เชิงสร้างสรรค์ บริษัทยังขอเชิญชวนให้เกิดความร่วมมือ โดยเน้นว่าความพยายามร่วมกันเป็นสิ่งสำคัญสำหรับการสร้างการป้องกันที่แข็งแกร่งต่อความเสี่ยงด้าน AI ที่เกิดขึ้น

สิ่งสำคัญที่ควรทราบคือ PyRIT ไม่ใช่สิ่งทดแทน Red teaming ของระบบ generative AI แบบแมนนวล แต่จะเสริมความเชี่ยวชาญด้านโดเมนที่มีอยู่ของทีม AI Red และทำให้งานที่น่าเบื่อสำหรับพวกเขาเป็นแบบอัตโนมัติ

คุณสามารถเริ่มต้นกับโครงการ PyrIT โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม.