Inflytandet av AI och Deepfakes på verkligheten och framtiden

5 min. läsa

Uppdaterad den

Läs vår informationssida för att ta reda på hur du kan hjälpa MSPoweruser upprätthålla redaktionen Läs mer

I samarbete med ExpressVPN

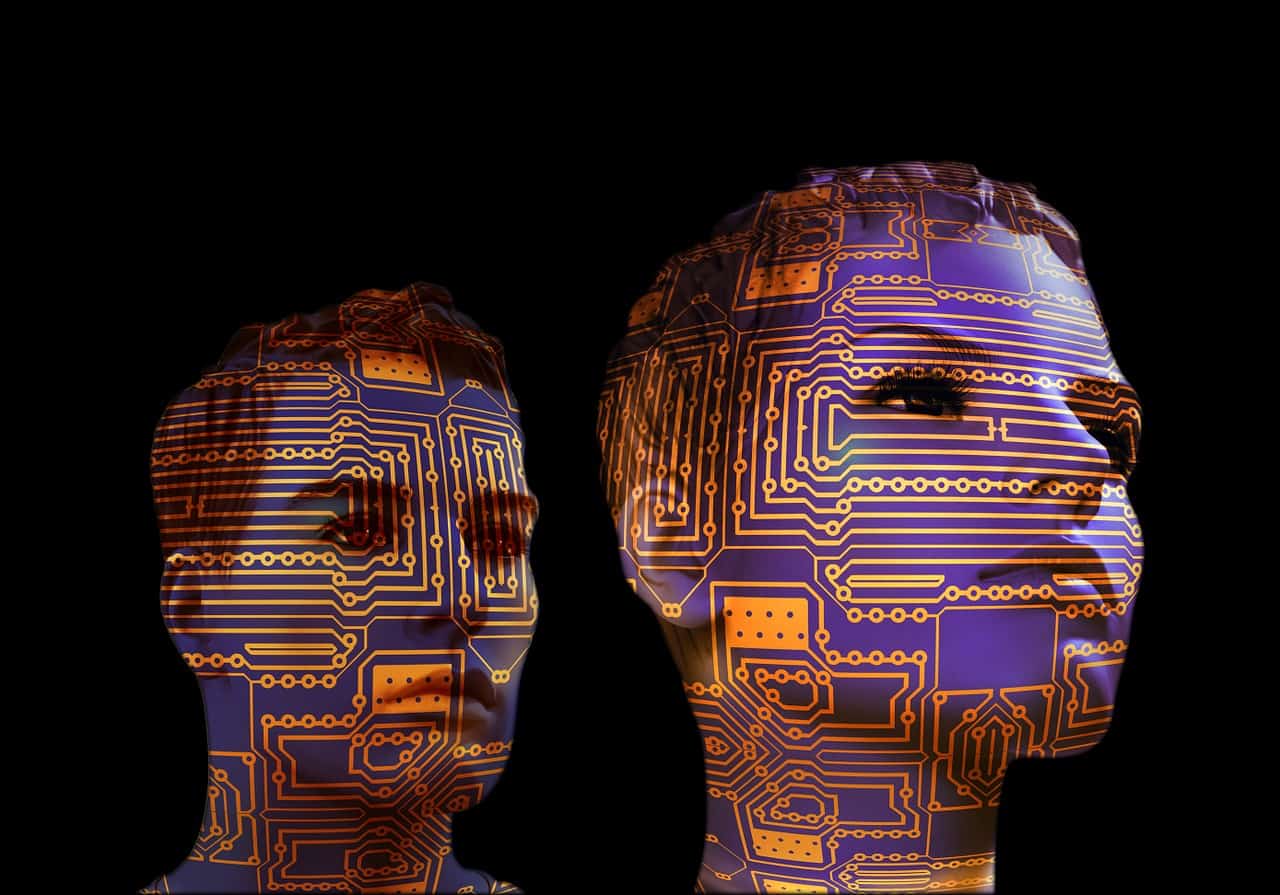

De senaste framstegen inom artificiell intelligens gör betydande förändringar i nuvarande mäns liv. Idag kan vi se hur AI utan ansträngning kan utföra kodning, essäskrivning och – framför allt – innehållsgenerering på några sekunder. Samma imponerande egenskaper är dock AI:s egen förbannelse. Enligt VPN-leverantörer, många använder AI för att generera syntetiska medier för desinformation, och deepfakes börjar nu spridas som en löpeld över hela världen.

Experter har experimenterat med AI i decennier, men Microsofts senaste stora push för tekniken väckte branschens intresse för att investera mer i sådana skapelser. Direkt efter avtäckningen av dess ChatGPT-driven Bing sökmotor, slog Google tillbaka med hjälp av Bard. Till skillnad från sin konkurrent implementerar Google fortfarande en strikt gräns för Bard-teståtkomst, med experter som spekulerar i att det beror på företagets rädsla för vad AI kan göra under fel händer.

Detta gäller i fallet med andra AI-tekniska produkter under utveckling. Till exempel kan Microsofts VALL-E-språkmodell, som för närvarande inte är offentligt tillgänglig, imitera en persons röst och känslor för att syntetisera personliga tal. Den kräver bara en tre sekunder lång inspelning som sin akustiska prompt men kan producera ett annat meddelande med den ursprungliga högtalarens röst.

Även om allmänheten fortfarande inte kan komma åt de nämnda skapelserna ovan, har de redan motsvarigheter som erbjuds av små teknikföretag. Detta har gjort det möjligt för inte bara vanliga användare utan även illvilliga aktörer att använda verktygen på vilket sätt de vill. Med detta är det inte längre förvånande att det nyligen dykt upp olika rapporter om människor som blivit lurade och lurade med hjälp av AI.

Dessa rapporter betonade specifikt användningen av AI-genererade röster som härmar deras offer. I en berättelse som delas med Business Insider den här månaden ska en mamma ha fått ett samtal från någon som påstår sig vara en kidnappare och krävde en lösensumma på 50,000 15 dollar för sin 100-åriga dotter. Mamman beskrev samtalet och sa att det var "XNUMX%" hennes dotters röst.

"Det var helt och hållet hennes röst. Det var hennes böjning. Det var så hon skulle ha gråtit. Jag tvivlade aldrig en sekund på att det var hon”, sa mamman, som senare upptäckte att samtalet var ett bedrägeri och att hennes dotter faktiskt var med sin man.

Samma incident med AI-röst upplevdes av ett par från Kanada, som tyvärr förlorade $21,000 XNUMX från en bedragare i telefonen. Enligt The Washington Post, poserade bedragaren som en advokat och parets son med hjälp av en AI-genererad röst och sa att pengarna skulle användas för juridiska avgifter efter att ha hävdat att sonen dödade en diplomat i en bilolycka.

Förutom röster kan andra former av AI-producerade generativa medier också lura vem som helst – till exempel falska bilder och djupfalska videor. Även om det inte finns några aktuella rapporter som visar att bedragare använder dem för ekonomisk vinning, kan deras effekt vara utbredd för allmänheten. Nyligen cirkulerade några AI-genererade bilder av kända personligheter på webben. Några inkluderar bilder som visar påven Franciskus i en fashionabel pufferjacka, tidigare president Donald Trump arresteras och Elon Musks håller handen på sin rival och GM-chefen Mary Barra under en dejt. Under tiden, i mars 2022, dök en djupt falsk video av den ukrainska presidenten Volodymyr Zelensky upp och bad ukrainska medborgare att kapitulera till Ryssland.

Även om materialet snabbt identifierades som falskt, lurade deras närvaro onekligen allmänheten och orsakade tillfällig förvirring för många. Till och med modell och författare Chrissy Teigen föll offer för bilderna av påven. Ändå kan effekten av sådana syntetiska medier bli allvarligare när AI fortsätter att utvecklas, särskilt i dessa tider med fler teknikföretag som spenderar miljarder dollar för att skapa den perfekta AI-skapelsen. När den tiden kommer kan AI utnyttjas för att förvränga verkligheten som alla känner till, vilket inte är omöjligt. Ännu mer, det kan till och med användas för att kontrollera och påverka allmänheten, vilket resulterar i olika politiska, sociala och moraliska frågor över hela världen.

Detta är uppenbart i en deepfake-video under mellanårsvalet 2018 som visar hur Barack Obama förtalar Donald Trump. Innehållet var ursprungligen avsett att varna onlinevärlden för farorna med falska nyheter på webben, men det återhämtade sig negativt. Detta väckte ilska bland flera Trump-anhängare och skadade oavsiktligt bilden av individer som användes i materialet.

Föreställ dig nu effekten av sådana generativa medier om de var specifikt utformade för det påverka och manipulera åsikter och främja propaganda till allmänheten. Resultaten kan bli drastiska. Detta kan specifikt vara sant i länder där media och information censureras av restriktiva regeringar, såsom Vitryssland, Kina, Egypten, Ryssland, Iran, Nordkorea, Turkmenistan, Förenade Arabemiraten, Uganda, Irak, Turkiet, Oman och andra övervägande islamiska länder . Vissa tar till att använda VPN för att komma åt geografiskt låst innehåll, webbplatser och tjänster för att hålla sig uppdaterade. Ändå är VPN-åtkomst inte helt möjlig på dessa platser eftersom de har kringgående av internetcensur och till och med blockerade webbplatser relaterade till VPN-tjänster. Med detta kan du föreställa dig framtiden för sådana områden med begränsad tillgång till internationella nyheter och deras regering har makten över vilket onlineinnehåll som ska tillåtas. Lägg sedan till möjligheten för en mer felfri innehållsgenererande AI i framtiden, så borde allmänheten få svårare att urskilja vad som är sant och vad som inte är det.

Branschgrupper och AI-teknikföretag är redan på väg att skissera policyer som kommer att vägleda användningen av AI-verktyg. Partnership on AI, till exempel, ger rekommendationer för institutioner och individer som bygger syntetiska medieverktyg eller helt enkelt för dem som distribuerar sådant material. Privata företag och ideella organisationer är dock inte de enda som behövs här. Lagstiftare måste också skapa en konkret uppsättning regler som AI-byggare och slutanvändare kommer att tvingas följa. Men kommer dessa framtida lagar att vara tillräckligt effektiva för att utnyttja kraften i AI och förhindra människor från att utnyttja den? Det borde vi snart se.