Microsoft och NVIDIA tillkännager den största och mest kraftfulla språkmodellen som utbildats hittills

1 min. läsa

Publicerad den

Läs vår informationssida för att ta reda på hur du kan hjälpa MSPoweruser upprätthålla redaktionen Läs mer

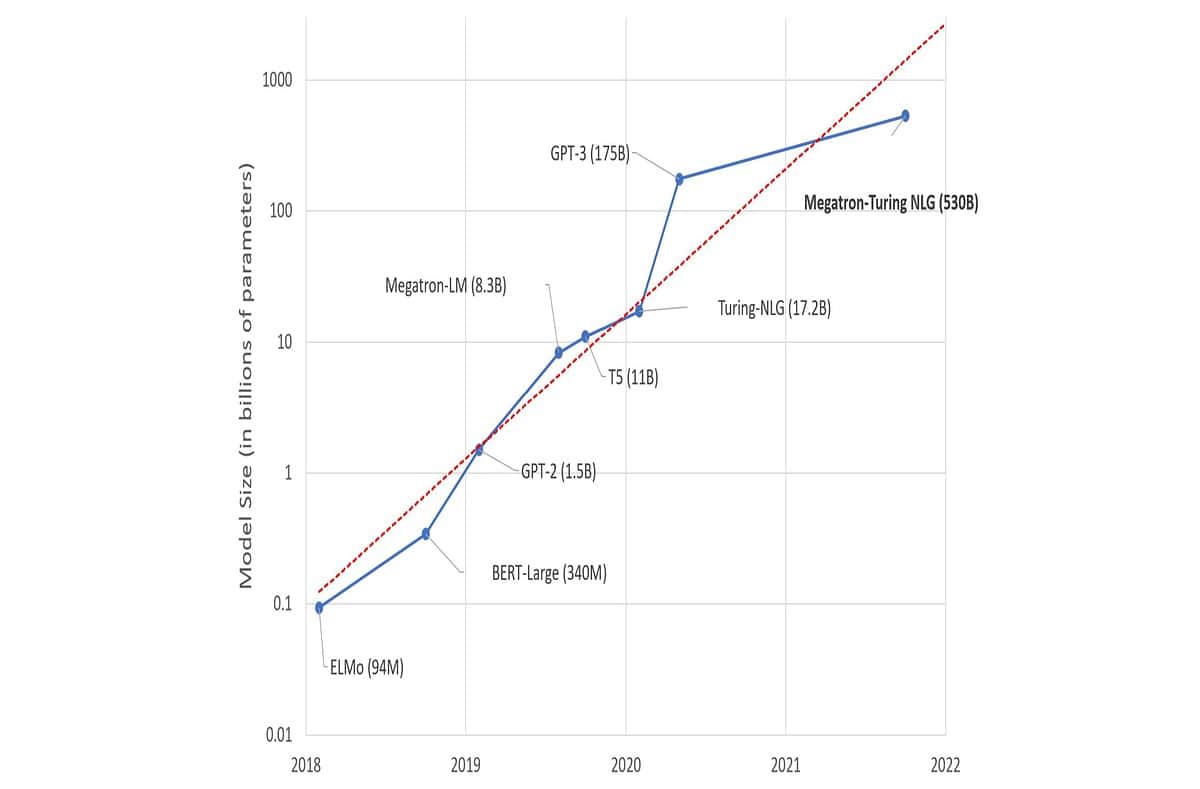

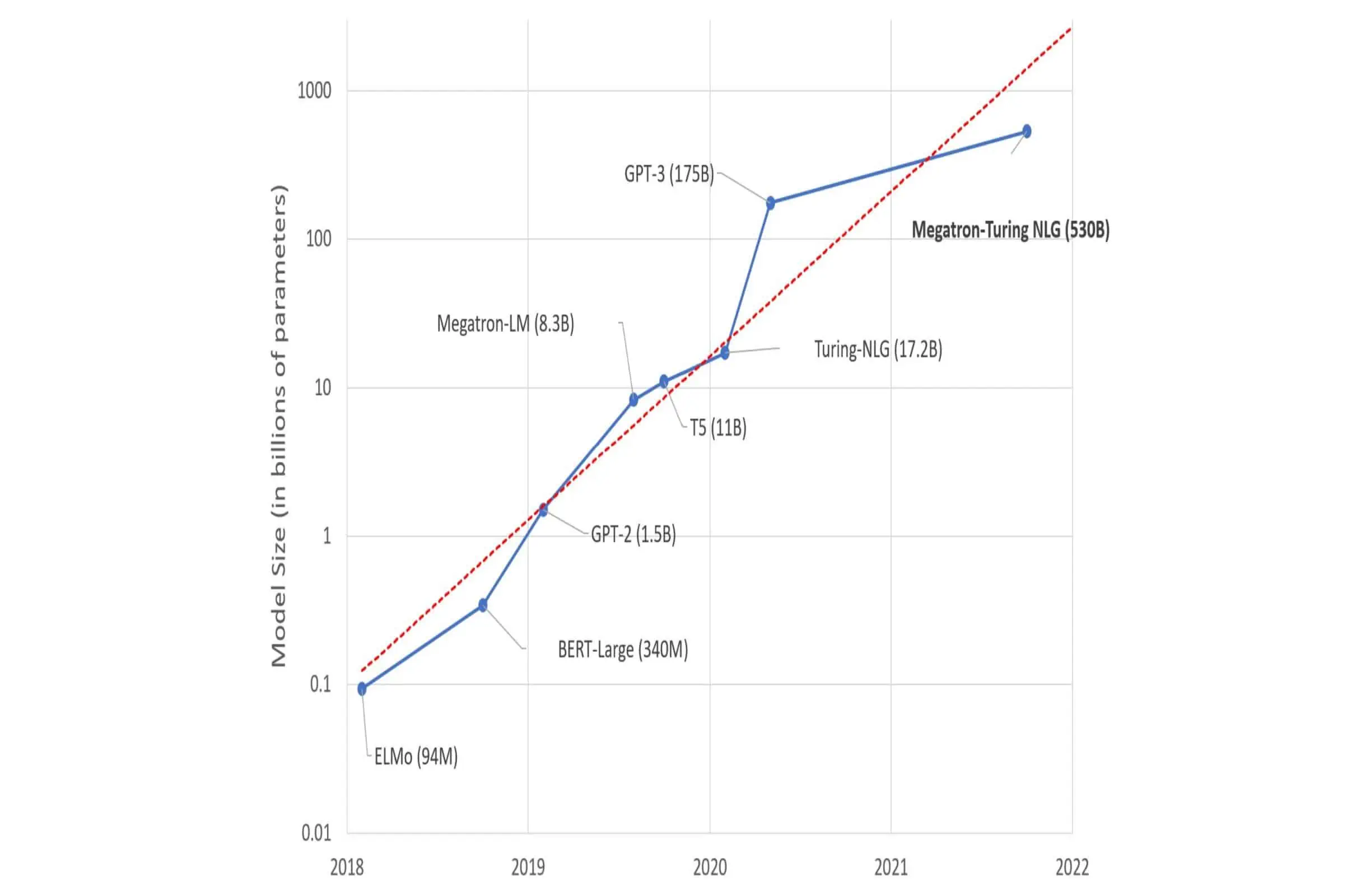

Microsoft och NVIDIA tillkännagav idag den DeepSpeed- och Megatron-drivna Megatron-Turing Natural Language Generation-modellen (MT-NLG), den största och mest kraftfulla monolitiska transformatorspråkmodellen som tränats hittills. Denna modell inkluderar 530 miljarder parametrar, 3 gånger antalet parametrar jämfört med den befintliga största modellen, GPT-3. Att träna en så stor modell innebär olika utmaningar. NVIDIA och Microsoft arbetade med många innovationer och genombrott längs alla AI-axlar.

Till exempel, genom att arbeta nära tillsammans, uppnådde NVIDIA och Microsoft en oöverträffad träningseffektivitet genom att konvergera en toppmodern GPU-accelererad träningsinfrastruktur med en spjutspets distribuerad inlärningsmjukvara. Vi byggde högkvalitativa, naturliga språkträningskorpora med hundratals miljarder tokens, och samutvecklade träningsrecept för att förbättra optimeringseffektiviteten och stabiliteten.

Du kan lära dig mer om detta projekt från länkarna nedan.