Kako se Appleov odprtokodni model OpenELM primerja z Microsoftovim Phi-3 glede parametrov?

Naključje?

2 min. prebrati

Objavljeno dne

Preberite našo stran za razkritje, če želite izvedeti, kako lahko pomagate MSPoweruser vzdrževati uredniško skupino Preberi več

Ključne opombe

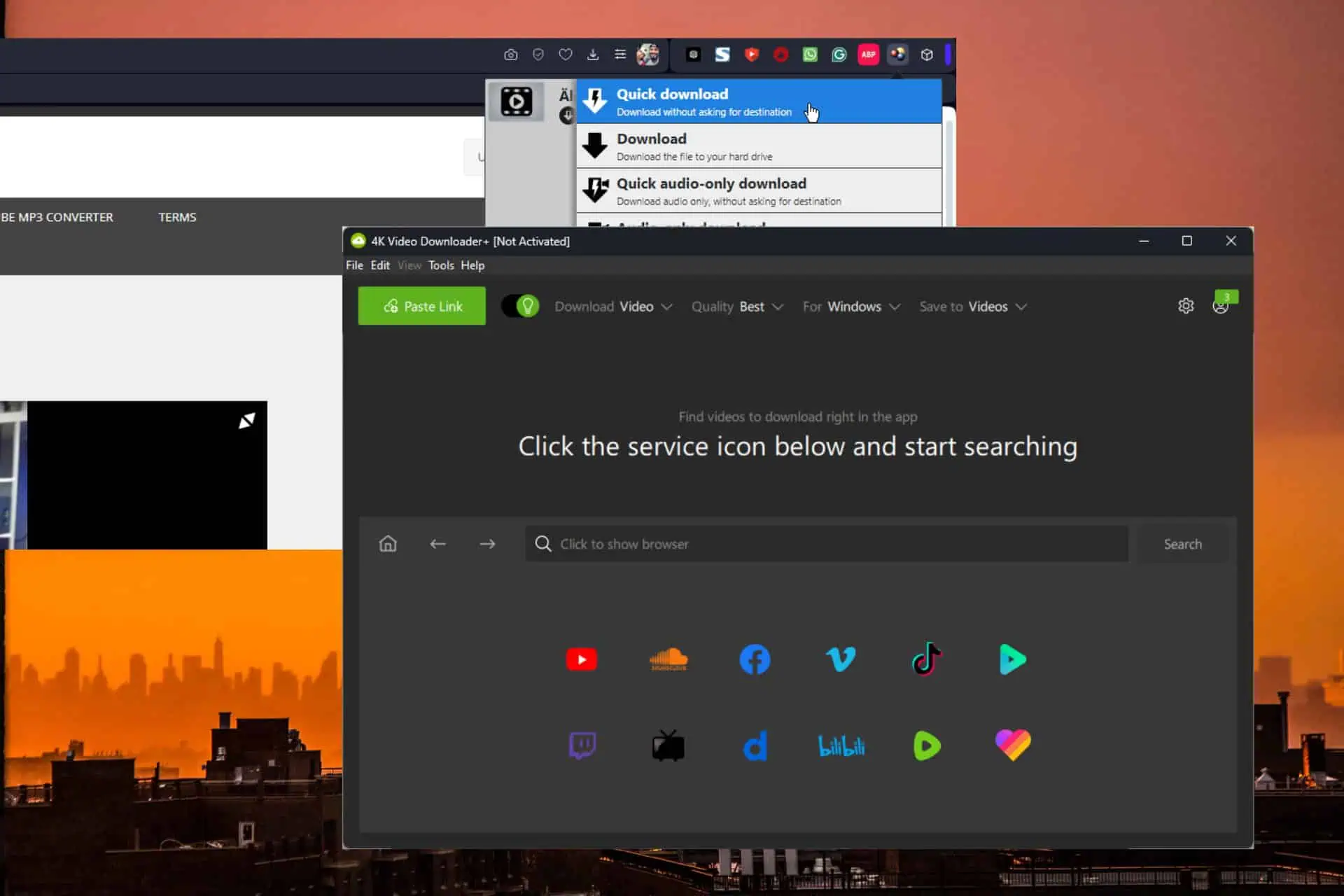

- Apple je izdal OpenELM na HuggingFace z osmimi različicami.

- Vsak model ima različne parametre: 270 milijonov, 450 milijonov, 1.1 milijarde in 3 milijarde.

- Microsoftov model Phi-3 pa vključuje različice s 3.8 milijarde, 7 milijardami in 14 milijardami parametrov.

Kmalu po tem, ko je Microsoft predstavil Družina Phi-3, nabor majhnih odprtokodnih modelov, zasnovanih za lažjo uporabo, se je Apple pridružil vlaku. Proizvajalci iPhona so (tiho) lansirali OpenELM, svoj najnovejši odprtokodni model AI.

OpenELM, okrajšava za Open-source Efficient Language Models, je na voljo v osmih različicah predhodno usposobljeni in uglašen z navodili dobi štiri. Applovi raziskovalci je dejal da model uporablja strategijo skaliranja po slojih za učinkovito porazdelitev parametrov znotraj vsake plasti modela transformatorja, te modele pa lahko uporabite na HuggingFace.

"Na primer, s proračunom parametrov v višini približno ene milijarde parametrov, OpenELM izkazuje 2.36-odstotno izboljšanje natančnosti v primerjavi z OLMo, medtem ko zahteva 2× manj žetonov pred usposabljanjem," piše v dokumentaciji.

Kar zadeva velikost, ima vsak model različne parametre: 270 milijonov, 450 milijonov, 1.1 milijarde in 3 milijarde. In čeprav to ni vedno najboljši merilni standard, so parametri v modelih AI vedno začetek njihove primerjave.

Odkrito povedano, OpenELM ni tako impresiven (glede parametrov) kot drugi odprtokodni modeli: Lama 3, ki poganja Meta AI, prihaja z največjim številom parametrov 70 milijard, Mixtral, ki ga podpira Microsoft, pa je lansiral svoj Model 8x22B s parametri 176B.

Phi-3-mini, najmanjša različica Microsoftovega modela Phi-3, ima 3.8 milijarde parametrov in je bil treniral en teden z uporabo grafičnih procesorjev Nvidia H100. Za primerjavo, srednja različica ima 14 milijard parametrov, majhna različica pa 7 milijard parametrov.