Microsoft predstavlja družino modelov Phi-3, ki prekašajo druge modele svojega razreda

2 min. prebrati

Objavljeno dne

Preberite našo stran za razkritje, če želite izvedeti, kako lahko pomagate MSPoweruser vzdrževati uredniško skupino Preberi več

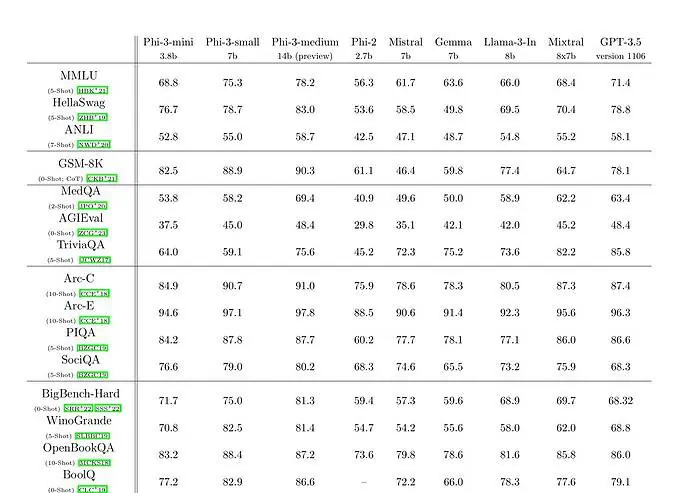

Decembra 2023 je Microsoft izdal Phi-2 model z 2.7 milijarde parametrov, ki zagotavlja najsodobnejšo zmogljivost med osnovnimi jezikovnimi modeli z manj kot 13 milijardami parametrov. V zadnjih štirih mesecih je več drugih modelov, ki so bili izdani, preseglo Phi-2. Pred kratkim je Meta izdala družino modelov Llama-3, ki je presegla vse prej izdane odprtokodne modele.

Včeraj zvečer je Microsoft Research objavil družino modelov Phi-3 prek tehnično poročilo. V družini Phi-3 so trije modeli:

- phi-3-mini (3.8B)

- fi-3-majhen (7B)

- fi-3-medij (14B)

Phi-3-mini s 3.8 milijarde jezikovnim modelom parametrov je usposobljen na 3.3 bilijona žetonov. Glede na merila uspešnosti phi-3-mini premaga Mixtral 8x7B in GPT-3.5. Microsoft trdi, da je ta model dovolj majhen, da ga lahko namestite na telefon. Microsoft je uporabil povečano različico nabora podatkov, ki je bil uporabljen za phi-2, sestavljen iz močno filtriranih spletnih podatkov in sintetičnih podatkov. Glede na Microsoftove primerjalne rezultate v tehničnem dokumentu sta phi-3-small in phi-3-medium dosegla impresivno oceno MMLU 75.3 oziroma 78.2.

Kar zadeva zmožnosti LLM, medtem ko model Phi-3-mini dosega podobno raven razumevanja jezika in zmožnosti razmišljanja kot pri veliko večjih modelih, je še vedno bistveno omejen s svojo velikostjo za nekatere naloge. Model preprosto nima zmožnosti shranjevanja obsežnega dejanskega znanja, kar je mogoče videti na primer pri nizki zmogljivosti na TriviaQA. Vendar menimo, da je to slabost mogoče odpraviti z razširitvijo z iskalnikom.