Wpływ sztucznej inteligencji i deepfake'ów na rzeczywistość i przyszłość

5 minuta. czytać

Zaktualizowano na

Przeczytaj naszą stronę z informacjami, aby dowiedzieć się, jak możesz pomóc MSPoweruser w utrzymaniu zespołu redakcyjnego Czytaj więcej

We współpracy z ExpressVPN

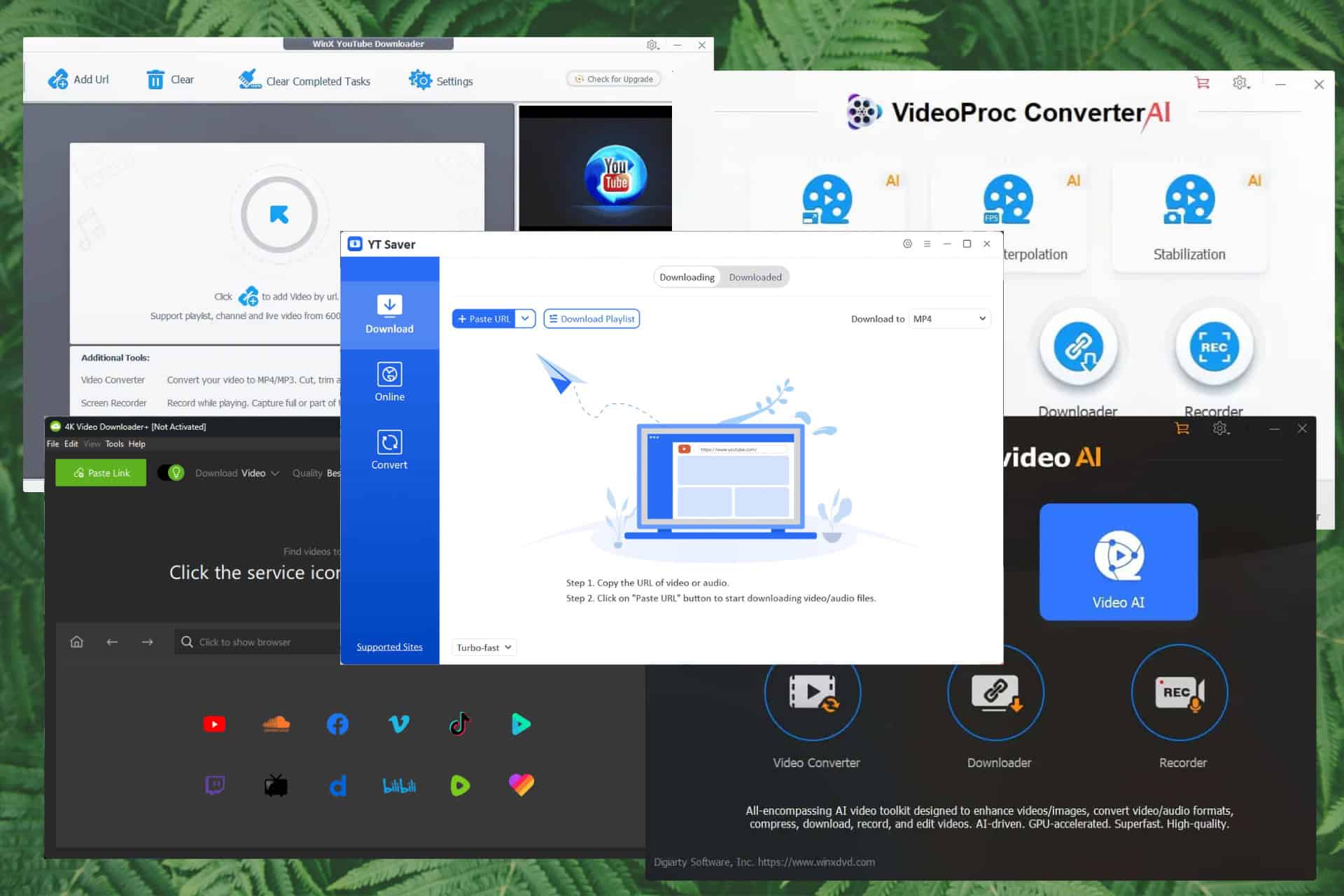

Ostatnie postępy w dziedzinie sztucznej inteligencji znacząco wprowadzają istotne zmiany w życiu współczesnych mężczyzn. Dziś możemy zobaczyć, jak sztuczna inteligencja może bez wysiłku kodować, pisać eseje, a przede wszystkim generować treści w ciągu kilku sekund. Te same imponujące możliwości są jednak przekleństwem sztucznej inteligencji. Zgodnie z Dostawcy VPN, wielu używa sztucznej inteligencji do generowania syntetycznych mediów do dezinformacji, a deepfake’i zaczynają rozprzestrzeniać się na całym świecie jak pożar.

Eksperci eksperymentują ze sztuczną inteligencją od dziesięcioleci, ale niedawny duży nacisk Microsoftu na technologię wzbudził zainteresowanie branży większymi inwestycjami w takie kreacje. Tuż po odsłonięciu jej Bing z obsługą ChatGPT wyszukiwarka, Google wycofał się z użycia Bard. Jednak w przeciwieństwie do swojego konkurenta, Google nadal wprowadza ścisły limit dostępu do testów Barda, a eksperci spekulują, że wynika to z obawy firmy przed tym, co sztuczna inteligencja może zrobić w niepowołanych rękach.

Dzieje się tak w przypadku innych opracowywanych produktów technologii AI. Na przykład model językowy VALL-E firmy Microsoft, który jest obecnie publicznie niedostępny, może naśladować głos i emocje osoby w celu syntezy spersonalizowanych przemówień. Wymaga jedynie trzysekundowego nagrania jako monitu akustycznego, ale może wytworzyć inną wiadomość, używając głosu oryginalnego mówcy.

Chociaż ogół społeczeństwa nadal nie ma dostępu do wspomnianych powyżej kreacji, mają one już odpowiedniki oferowane przez małe firmy technologiczne. Umożliwiło to nie tylko zwykłym użytkownikom, ale także szkodliwym podmiotom korzystanie z narzędzi w dowolny sposób. W związku z tym nie jest już zaskakujące, że ostatnio pojawiały się różne doniesienia o ludziach, którzy zostali oszukani i oszukani przy pomocy sztucznej inteligencji.

Raporty te szczególnie podkreślały wykorzystanie głosów generowanych przez sztuczną inteligencję naśladujących ich ofiary. W historii udostępnionej Insider Biznes W tym miesiącu podobno matka otrzymała telefon od kogoś, kto twierdzi, że jest porywaczem, żądając 50,000 15 dolarów okupu za jej 100-letnią córkę. Opisując odebrany telefon, matka powiedziała, że to „XNUMX%” głos jej córki.

„To był całkowicie jej głos. To była jej odmiana. Tak by płakała. Ani przez sekundę nie wątpiłam, że to ona” – powiedziała matka, która później odkryła, że telefon był oszustwem i że jej córka rzeczywiście była z jego mężem.

Ten sam incydent z głosem AI miał miejsce w przypadku pary z Kanady, która niestety straciła 21,000 XNUMX $ od oszusta przez telefon. Według The Washington Post, oszust udawał prawnika i syna pary, używając głosu generowanego przez sztuczną inteligencję i powiedział, że pieniądze zostaną wykorzystane na opłaty prawne po tym, jak twierdził, że syn zabił dyplomatę w wypadku samochodowym.

Oprócz głosów, inne formy mediów generatywnych tworzonych przez sztuczną inteligencję mogą również oszukać każdego — na przykład fałszywe obrazy i głębokie fałszywe filmy. Chociaż nie ma obecnie raportów pokazujących, że oszuści wykorzystują je w celu uzyskania korzyści finansowych, ich wpływ może być powszechny dla ogółu społeczeństwa. Ostatnio w sieci pojawiły się wygenerowane przez sztuczną inteligencję obrazy znanych osobistości. Niektóre z nich obejmują zdjęcia przedstawiające papieża Franciszka w modnej puchowej kurtce, aresztowania byłego prezydenta Donalda Trumpa oraz Elona Muska trzymającego za rękę swoją rywalkę i dyrektor generalną GM Mary Barra podczas randki. W międzyczasie, w marcu 2022 r., pojawiło się fałszywe wideo przedstawiające prezydenta Ukrainy Wołodymyra Zełenskiego, wzywającego obywateli Ukrainy do poddania się Rosji.

Chociaż materiały zostały szybko zidentyfikowane jako fałszywe, ich obecność niezaprzeczalnie oszukała opinię publiczną i spowodowała tymczasowe zamieszanie u wielu. Nawet model i autor Chrissy Teigen padł ofiarą wizerunków papieża. Jednak wpływ takich syntetycznych mediów może być poważniejszy w miarę rozwoju sztucznej inteligencji, zwłaszcza w czasach, gdy coraz więcej firm technologicznych wydaje miliardy dolarów na stworzenie idealnego tworu AI. Kiedy nadejdzie ten czas, sztuczna inteligencja może zostać wykorzystana do przekręcenia znanej wszystkim rzeczywistości, co nie jest niemożliwe. Co więcej, można go nawet wykorzystać do kontrolowania i wywierania wpływu na opinię publiczną, co skutkuje różnymi problemami politycznymi, społecznymi i moralnymi na całym świecie.

Widać to wyraźnie w fałszywym wideo podczas wyborów śródokresowych w 2018 r., na którym Barack Obama oczernia Donalda Trumpa. Treść miała pierwotnie ostrzec świat online przed niebezpieczeństwami związanymi z fałszywymi wiadomościami w sieci, ale odbiła się niekorzystnie. Wywołało to wściekłość wśród kilku zwolenników Trumpa i nieumyślnie zaszkodziło wizerunkowi osób wykorzystanych w materiale.

Teraz wyobraź sobie efekt takich generatywnych mediów, gdyby zostały specjalnie do tego zaprojektowane wpływać i manipulować opiniami i propagować propagandę wśród społeczeństwa. Skutki mogą być drastyczne. Może to być szczególnie prawdziwe w krajach, w których media i informacje są cenzurowane przez restrykcyjne rządy, takich jak Białoruś, Chiny, Egipt, Rosja, Iran, Korea Północna, Turkmenistan, Zjednoczone Emiraty Arabskie, Uganda, Irak, Turcja, Oman i inne kraje z przewagą islamu . Niektórzy uciekają się do korzystania z VPN, aby uzyskać dostęp do treści, stron internetowych i usług zablokowanych geograficznie, aby być na bieżąco. Jednak dostęp VPN nie jest całkowicie możliwy w tych miejscach, ponieważ mają one obejście cenzury internetowej, a nawet zablokowane strony internetowe związane z usługami VPN. Dzięki temu możesz sobie wyobrazić przyszłość takich obszarów z ograniczonym dostępem do międzynarodowych wiadomości, a ich rząd ma moc zezwalania na treści online. Następnie dodaj możliwość bardziej bezbłędnej sztucznej inteligencji do generowania treści w przyszłości, a społeczeństwo powinno mieć większe trudności z rozróżnieniem, co jest prawdą, a co nie.

Grupy branżowe i firmy zajmujące się technologią sztucznej inteligencji już teraz opracowują zasady, które będą kierować korzystaniem z narzędzi sztucznej inteligencji. Na przykład Partnership on AI dostarcza rekomendacji dla instytucji i osób budujących narzędzia do mediów syntetycznych lub po prostu dla tych, którzy takie materiały rozpowszechniają. Jednak nie tylko prywatne firmy i organizacje non-profit są tutaj potrzebne. Ustawodawcy muszą również stworzyć konkretny zestaw zasad, do przestrzegania których będą zmuszeni konstruktorzy sztucznej inteligencji i użytkownicy końcowi. Niemniej jednak, czy te przyszłe prawa będą wystarczająco skuteczne, aby wykorzystać moc sztucznej inteligencji i uniemożliwić ludziom jej wykorzystywanie? Wkrótce powinniśmy to zobaczyć.