Usługa Azure AI Search zwiększa teraz pojemność magazynu i rozmiar indeksu wektorowego. Oto, co się zmieniło

Ta aktualizacja znacznie obniża koszty.

2 minuta. czytać

Opublikowany

Przeczytaj naszą stronę z informacjami, aby dowiedzieć się, jak możesz pomóc MSPoweruser w utrzymaniu zespołu redakcyjnego Czytaj więcej

Kluczowe uwagi

- Aplikacje RAG zostaną udostępnione w 2024 r. i będą wymagały ekonomicznego pobierania.

- Usługa Azure AI Search usprawnia wyszukiwanie w pamięci masowej i wektorach, zachowując wydajność.

- Uaktualnienia zapewniają lepszą wydajność i skalowalność.

Microsoft właśnie Niedawno ogłosił, że zwiększa pojemność magazynu i rozmiar indeksu wektorowego usługi Azure AI Search, popularnego narzędzia dla deweloperów opartego na sztucznej inteligencji.

Ogłoszenie nadeszło w chwili, gdy aplikacje RAG zostaną udostępnione w 2024 r., dlatego ludzie potrzebują ekonomicznego wyszukiwania. Obecnie w niektórych regionach nowe usługi warstw Basic i Standard oferują więcej przestrzeni dyskowej i mocy obliczeniowej, szczególnie w przypadku wyszukiwania wektorów, tekstu i metadanych. Ta aktualizacja znacznie obniża koszty – cena za wektor spada o około 85%, a ogólne koszty przechowywania zmniejszają się nawet o 75% lub więcej.

Te ulepszenia oznaczają również, że możesz przechowywać więcej danych na partycję, mieć większe indeksy wektorowe i cieszyć się większą wydajnością w przypadku zadań takich jak indeksowanie i wyszukiwanie.

Firma usprawnia także działanie wyszukiwania wektorowego i oszczędza miejsce na dysku. Teraz możesz używać technik takich jak kwantyzacja i nadpróbkowanie oraz dostosowywać ustawienia, aby zmniejszyć wykorzystanie pamięci nawet o 75%. Ponadto ustawienie właściwości „Przechowywane” w polach wektorowych może jeszcze bardziej zmniejszyć obciążenie pamięci

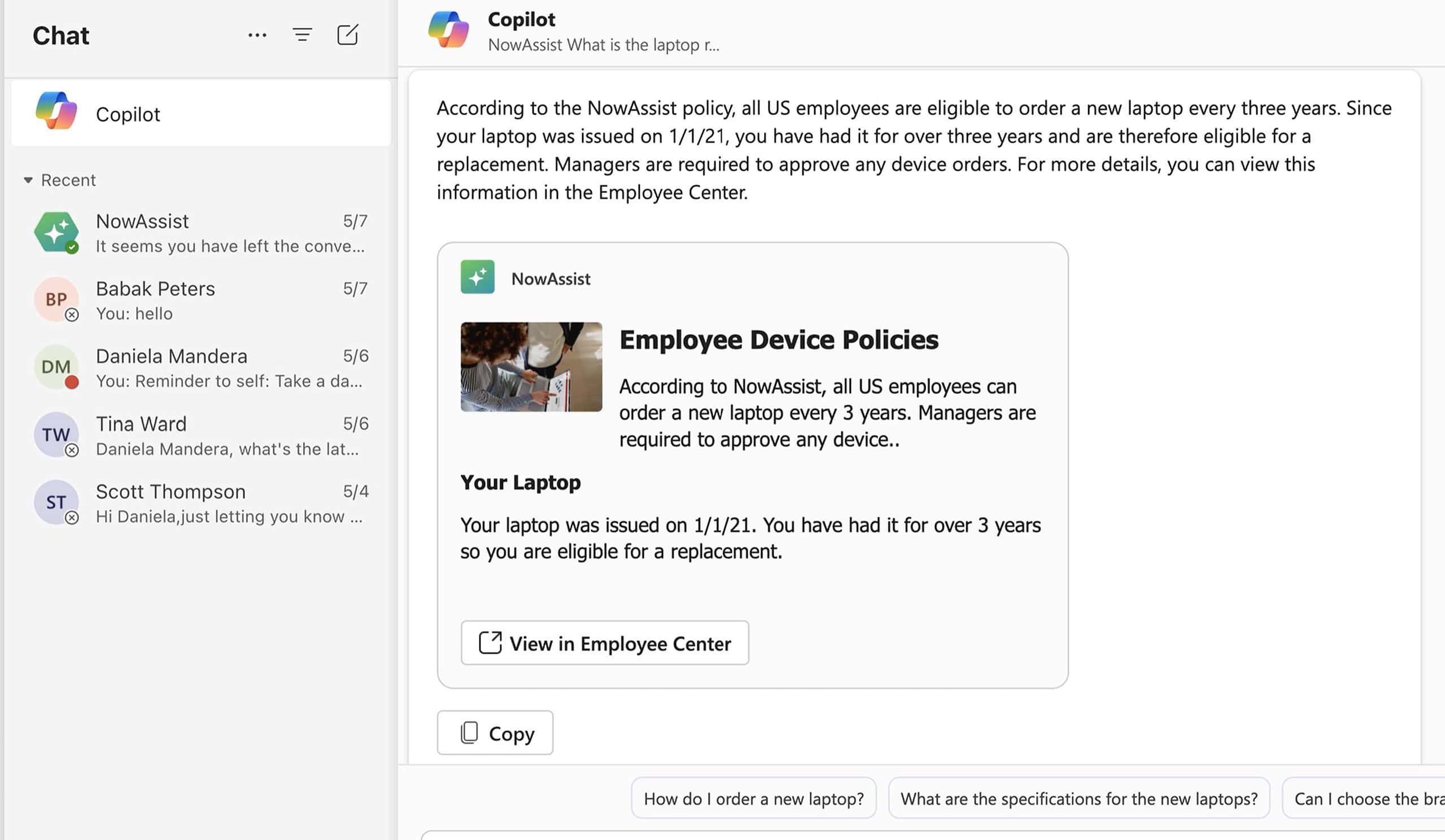

Azure AI Search to narzędzie, które ułatwia tworzenie zaawansowanych funkcji wyszukiwania i aplikacji opartych na sztucznej inteligencji poprzez łączenie modeli językowych z danymi biznesowymi. Pomaga programistom tworzyć funkcje wyszukiwania dla aplikacji mobilnych i internetowych, zarówno dla ich firmy, jak i oprogramowania, które oferują jako usługę.

Nie tak dawno temu Microsoft powiedział także, że nowy model Command R+ firmy Cohere jest teraz dostępne jako jeden z setek modeli językowych w Azure AI. Model, który właśnie dzisiaj trafił na rynek, ma parametry 104B i twierdzi się, że jest lepszy i tańszy od GPT-4 Turbo.

Więcej szczegółów na temat zwiększonej pojemności można znaleźć tutaj.