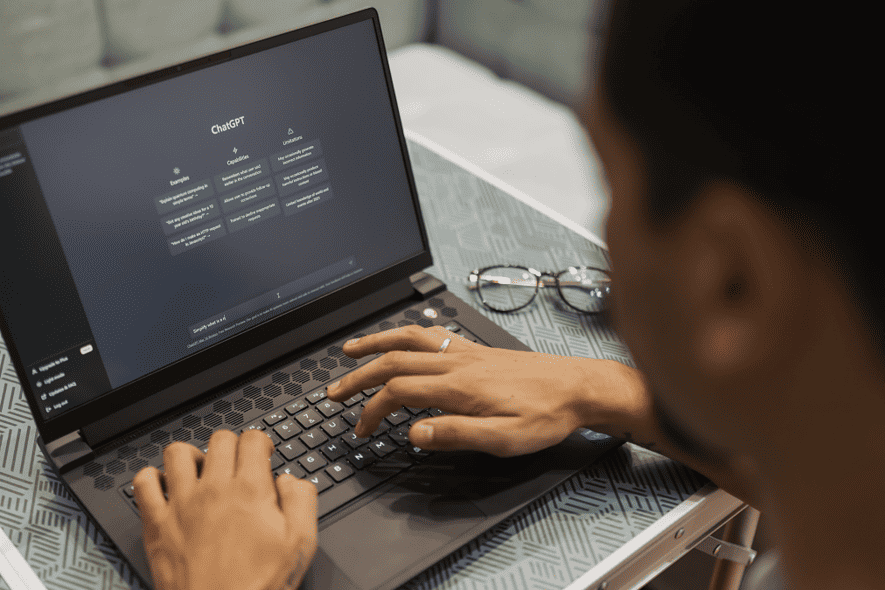

Co to jest „Specyfikacja modelu” OpenAI? Sam Altman twierdzi, że ma to zasadnicze znaczenie dla postępu społeczeństwa dzięki sztucznej inteligencji

Poruszamy się zbyt szybko ze sztuczną inteligencją

2 minuta. czytać

Opublikowany

Przeczytaj naszą stronę z informacjami, aby dowiedzieć się, jak możesz pomóc MSPoweruser w utrzymaniu zespołu redakcyjnego Czytaj więcej

Kluczowe uwagi

- OpenAI uruchamia Model Spec, kierując zachowaniem AI w różnych sytuacjach.

- Specyfikacja modelu promuje przejrzystość i zachęca do publicznej dyskusji na temat ulepszeń.

- Przedstawia zasady, w tym cele, zasady i wartości domyślne, mające na celu zrównoważenie zachowania sztucznej inteligencji.

Poruszamy się zbyt szybko ze sztuczną inteligencją, że Altman jest równy skamieniały przez to. Nawet dzisiejsze filmy stworzone przez sztuczną inteligencję (dzięki Sora z OpenAI model) w porównaniu do roku czy dwóch lat temu wyglądają zupełnie inaczej). A teraz firma wspierana przez Microsoft uruchomiła Specyfikacja modelu, kompleksowy przewodnik po tym, jak powinny zachowywać się modele OAI.

Jest to dokument opisujący, jak modele AI powinny zachowywać się w określonych sytuacjach, takich jak prośby o treści NSFW, prywatność ludzi, a nawet działania nielegalne. Ogłoszona w środę specyfikacja modelu może pomóc w rozróżnieniu, czy coś w tych modelach jest błędem, czy świadomą decyzją podjętą przez człowieka.

„Publikujemy specyfikację modelu, aby zapewnić większą przejrzystość naszego podejścia do kształtowania zachowania modelu oraz aby rozpocząć publiczną dyskusję na temat tego, jak można go zmienić i ulepszyć” – czytamy w dokumencie, w którym czytamy, że specyfikacja zostanie następnie poddana publicznej dyskusji .

W dokumencie tym przedstawiono trzy rodzaje zasad: cele, zasady i wartości domyślne. Cele wyznaczają szeroki kierunek, ale mogą być sprzeczne w złożonych scenariuszach. Reguły zapewniają bezpieczeństwo i legalność, natomiast wartości domyślne zapewniają stabilne zachowania, które w razie potrzeby można zastąpić.

To rzeczywiście długi dokument, ale zawiera kilka interesujących ciekawostek. Sugerują, że modele sztucznej inteligencji nie powinny spełniać żądań NSFW, z wyjątkiem kontekstów naukowych lub kreatywnych. Na przykład w dokumencie wspomniano o nietypowej prośbie o teksty rapowe o kotach z wulgarnym językiem, które ich zdaniem powinny być dopuszczalne w niektórych przypadkach.

Firma wspierana przez Microsoft wspomina, że nie wykorzystała w pełni specyfikacji modelu w obecnej postaci, ale zapożyczyła dokumentację wykorzystaną w poprzednim projekcie w OpenAI. Zastanawiają się także nad sposobami uczenia się swoich modeli bezpośrednio na podstawie specyfikacji modelu.