Snowflake Arctic is er trots op de "beste LLM voor zakelijke AI" te zijn. Dat is een behoorlijk grote bewering

Je kunt Snowflake nu op HuggingFace proberen

2 minuut. lezen

Uitgegeven op

Lees onze openbaarmakingspagina om erachter te komen hoe u MSPoweruser kunt helpen het redactieteam te ondersteunen Lees meer

Belangrijkste opmerkingen

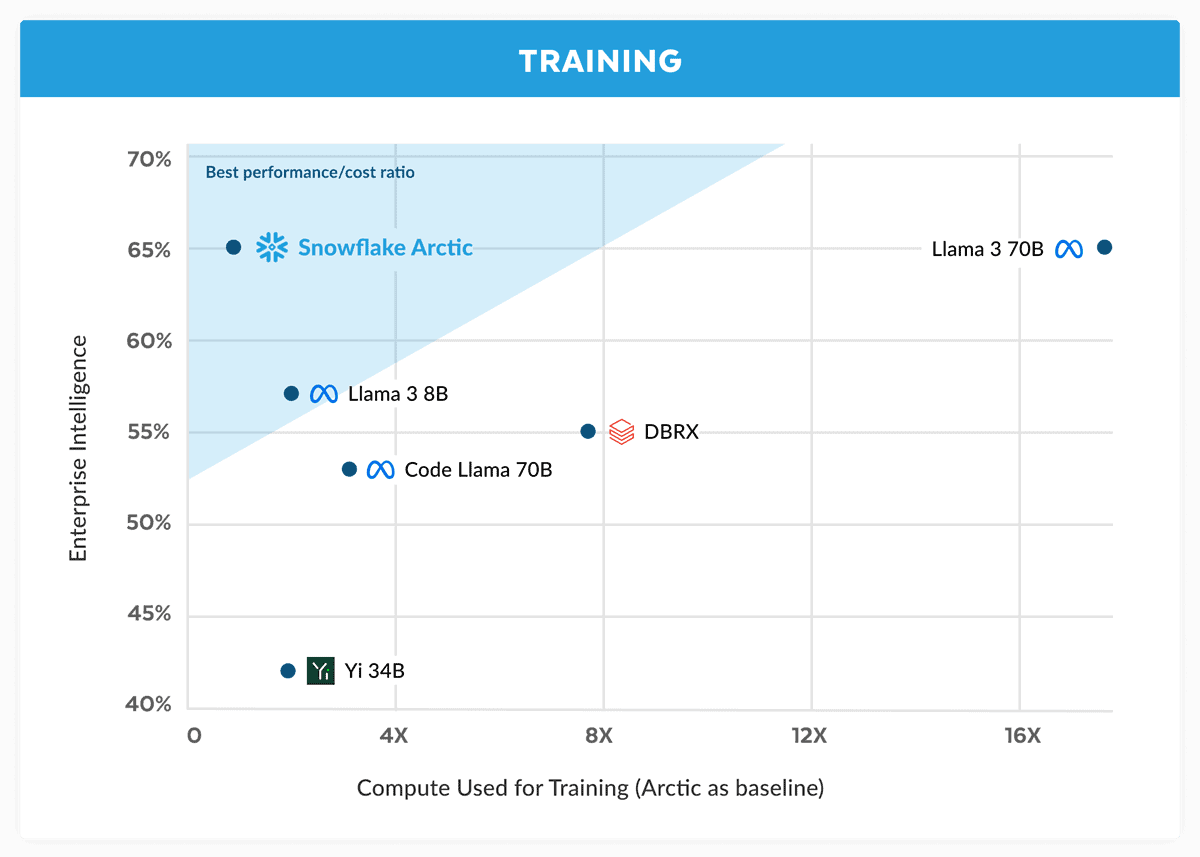

- Snowflake introduceert Arctic en beweert dat het met lagere kosten kan wedijveren met Llama 3 70B.

- Arctic blinkt uit in bedrijfstaken zoals coderen en SQL-generatie.

- Met behulp van een Dense-MoE Hybrid optimaliseert Arctic de efficiëntie voor verschillende batchgroottes.

Snowflake, een cloudcomputinggigant die aanvankelijk werd opgericht door voormalige Oracle-wetenschappers, daagt nu grote spelers uit in de AI-oorlog. Het bedrijf is gelanceerd Sneeuwvlok Noordpoolgebied, de nieuwste "beste LLM voor zakelijke AI", en beweerde dat het beter is dan vergelijkbaar met Llama 3 70B en beter dan de 8B-variant van laatstgenoemde.

In zijn aankondiging beweert Snowflake dat het Arctic-model de prestaties van Llama 3 70B evenaart, maar met lagere computervereisten en -kosten. Het wordt aangeprezen als ideaal voor enterprise intelligence-taken op gebieden en benchmarks zoals codering (HumanEval+ en MBPP+), SQL-generatie (Spider) en het volgen van instructies (IFEval).

Dat is een grote claim, vooral als je dat in ogenschouw neemt Lama 3 70B heeft in belangrijke tests goed gepresteerd ten opzichte van andere grote modellen zoals de GPT-4 Turbo en Claude 3 Opus. Het aankomende model van Meta scoort naar verluidt goed in benchmarks zoals MMLU (voor het begrijpen van onderwerpen), GPQA (biologie, natuurkunde en scheikunde, en HumanEval (codering).

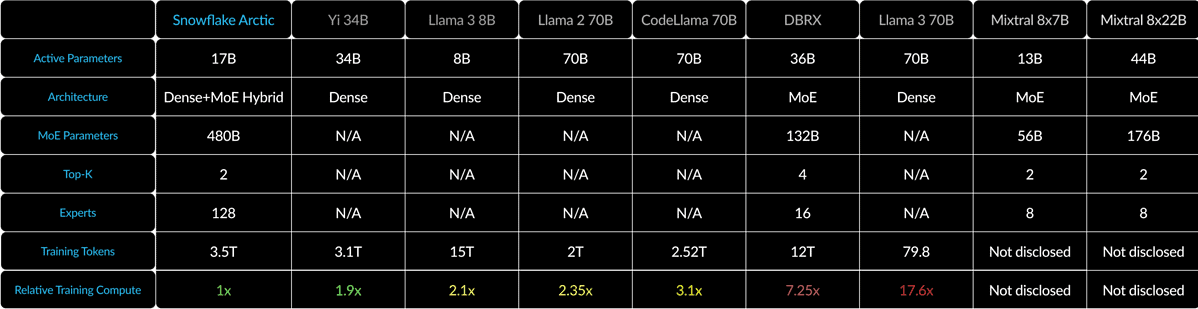

Snowflake Arctic combineert een 10B-dichte transformator met een 128×3.66B MoE MLP met behulp van een Dense-MoE Hybrid. Dit zijn in totaal 480B parameters, maar er worden er slechts 17B actief gebruikt, gekozen met top-2-poorten.

Voor kleine batchgroottes zoals 1 vermindert Arctic het leesgeheugen tot 4x in vergelijking met Code-Llama 70B en tot 2.5x minder dan Mixtral 8x22B. Maar naarmate de batchgroottes aanzienlijk toenemen, wordt Arctic computergebonden. Het vergt 4x minder rekenkracht dan CodeLlama 70B en Llama 3 70B.

Je kunt Snowflake Arctic uitproberen KnuffelenGezicht. Het bedrijf belooft ook dat het model binnenkort op andere modeltuinen zoals AWS, Microsoft Azure, Perplexity en meer zal verschijnen.