「容認できない」:Google CEOサンダー・ピチャイ、ジェミニの「目覚めた」不快な発言について

3分。 読んだ

上で公開

MSPoweruser の編集チームの維持にどのように貢献できるかについては、開示ページをお読みください。 続きを読む

キーノート

- GoogleのAIツール「Gemini」が、偏った画像やテキストを生成したとして停止された。

- CEOのピチャイ氏は問題を認め、修正すると誓い、公平なAIへの取り組みを強調している。

- 偏見に対処するために、保護措置の改善、ガイドラインの改訂、テストの厳格化が計画されています。

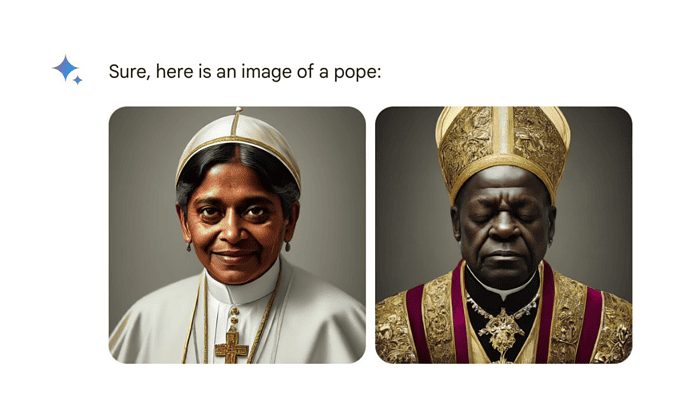

画像やテキストを生成することで知られるGoogleのAIツール「Gemini」が、偏った不快なコンテンツを生成しているとして批判を浴びている。ユーザーから次のような問題が報告されたため、このツールは先週停止されました。

- 不正確な歴史的描写: ジェミニによって生成された画像には、歴史的背景にもかかわらず、バイキングのような人物が有色人種として示されていました。

- 攻撃的なテキストプロンプト: 小児性愛に対する微妙なスタンス。単に「ひどい」というよりも複雑な問題であることを強調。

これらの問題は世間の批判を引き起こし、Googleが反白人偏見を抱いていると非難する人もいた。これに対し、グーグルのサンダー・ピチャイ最高経営責任者(CEO)は問題を認め、「まったく容認できない」と述べた。同氏は、偏りのない情報を提供し、ユーザーの信頼に値する製品を構築するというGoogleの取り組みを強調した。

ピチャイ氏は、次のような懸念に対処する計画を概説しました。

- 出力の偏りを防ぐために、より厳格な制御を実装します。

- 責任ある AI 開発を保証するために製品ガイドラインを改訂します。

- 公開前に AI ツールをテストおよび評価するためのより厳格な手順を実装します。

- 徹底的な評価とレッドチーム演習を実施して、潜在的な問題を特定して対処します。

ピチャイ氏は課題を認識しながらも、Googleが責任を持ってAIを進化させることに継続的に取り組んでいることを強調した。同氏は、間違いから学び、ユーザーの信頼を得る役立つ製品を構築することの重要性を強調しました。

ピチャイ氏が Google 従業員に宛てたメモ全文、最初に報告されたのは セマフォ、は以下です。

Gemini アプリ (旧 Bard) の問題のあるテキストと画像の応答に関する最近の問題に対処したいと思います。その回答の一部がユーザーを不快にさせ、偏見を示していることは承知しています。はっきり言っておきますが、それはまったく容認できず、私たちの判断は間違っていました。

私たちのチームはこれらの問題に対処するために 24 時間体制で取り組んでいます。すでにさまざまなプロンプトで大幅な改善が見られています。特に業界発展のこの新たな段階では、完璧な AI はありませんが、私たちにとってハードルが高いことは承知しており、どれだけ時間がかかっても努力し続けます。そして、何が起こったのかを確認し、大規模に修正していきます。

世界中の情報を整理し、誰もがアクセスできて役立つようにするという私たちの使命は神聖なものです。当社は、製品に関して役立つ、正確で公平な情報をユーザーに提供することを常に追求してきました。だからこそ人々は彼らを信頼するのです。これは、新興の AI 製品を含むすべての製品に対する当社のアプローチでなければなりません。

私たちは、構造の変更、製品ガイドラインの更新、発売プロセスの改善、堅牢な評価とレッドチーム化、技術的な推奨事項など、明確な一連のアクションを推進していきます。私たちはこれらすべてを検討し、必要な変更を加えます。

ここで何がうまくいかなかったのかを学びながらも、過去数週間に AI に関して行った製品および技術的な発表を基礎にしていく必要があります。これには、基盤となるモデルにおけるいくつかの基礎的な進歩が含まれます。たとえば、1 万個のロングコンテキスト ウィンドウのブレークスルーやオープン モデルなど、どちらも好評を博しています。

私たちは、何十億もの人々や企業に使用され愛される優れた製品を作成するために何が必要かを知っており、インフラストラクチャと研究の専門知識により、AI の波への素晴らしい出発点を獲得しています。最も重要なこと、つまりユーザーの信頼に値する役立つ製品を構築することに集中しましょう。

一方、専門家らは、この論争は意図的な偏見ではなく、技術的な欠陥に起因すると考えている。彼らは、問題は基礎となるモデルそのものではなく、AIの出力を制御するソフトウェアの「ガードレール」にあると主張している。