A Microsoft Azure AI bemutatja a „Prompt Shields”-et az LLM-manipuláció leküzdésére

2 perc olvas

Publikálva

Olvassa el közzétételi oldalunkat, hogy megtudja, hogyan segítheti az MSPowerusert a szerkesztői csapat fenntartásában Tovább

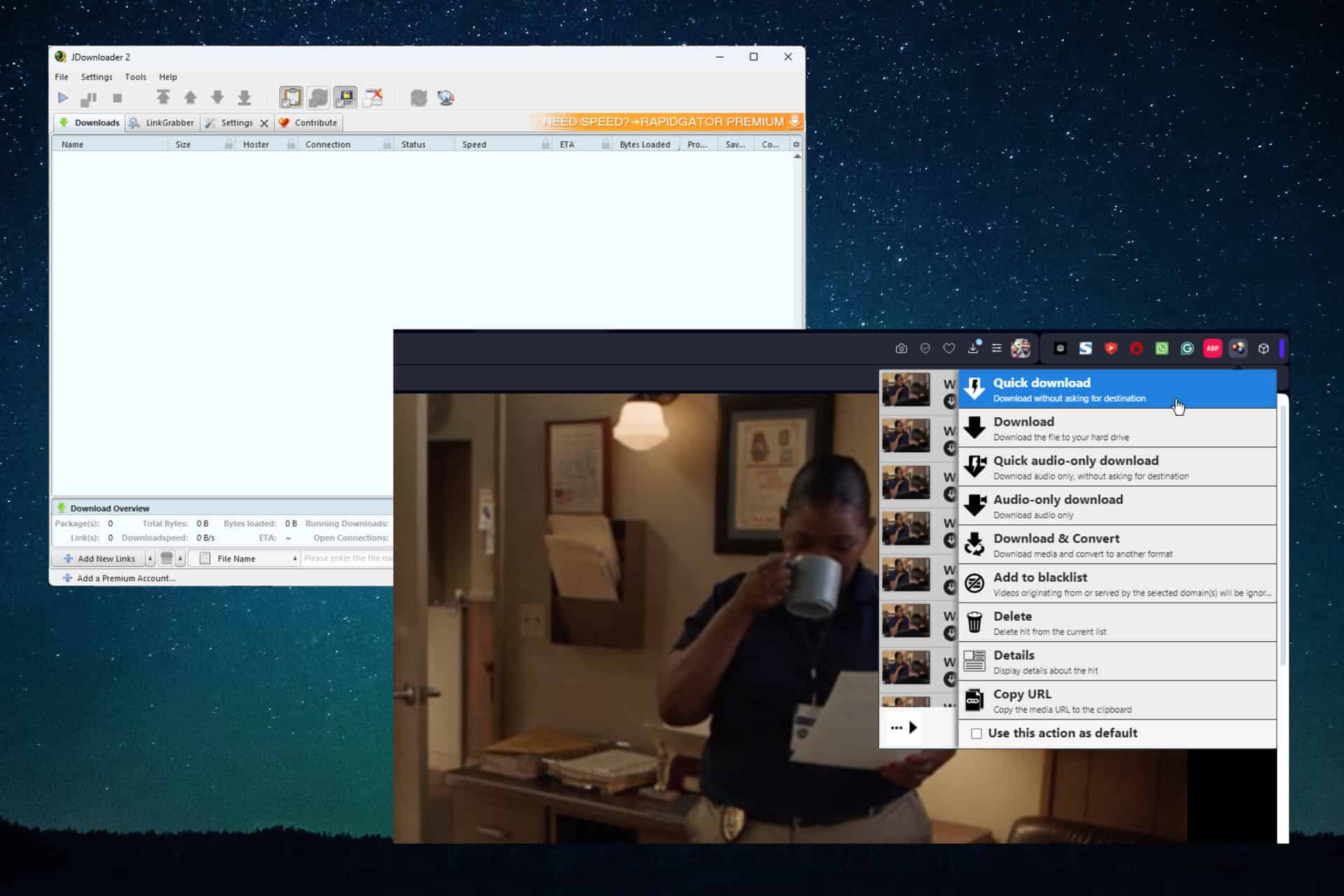

A Microsoft ma bejelentés jelentős biztonsági fejlesztés az Azure OpenAI Service és Azure AI Content Safety platformjaihoz. A „Prompt Shields” névre keresztelt új funkció erőteljes védelmet kínál a nagy nyelvi modelleket (LLM) megcélzó, egyre kifinomultabb támadások ellen.

A Prompt Shields védelmet nyújt a következők ellen:

- Közvetlen támadások: Más néven jailbreak támadások, ezek a kísérletek kifejezetten utasítják az LLM-et, hogy figyelmen kívül hagyja a biztonsági protokollokat, vagy végezzen rosszindulatú műveleteket.

- Közvetett támadások: Ezek a támadások finoman káros utasításokat ágyaznak be a látszólag normális szövegekbe, hogy az LLM-t nemkívánatos viselkedésre csalják meg.

A Prompt Shields integrálva van az Azure OpenAI Service tartalomszűrőivel, és az Azure AI Content Safety szolgáltatásban érhető el. A fejlett gépi tanulási algoritmusoknak és a természetes nyelvi feldolgozásnak köszönhetően a Prompt Shields képes azonosítani és semlegesíteni a potenciális fenyegetéseket a felhasználói utasításokban és a harmadik féltől származó adatokban.

Reflektorfény: újszerű védelmi technika

A Microsoft bevezette a „Spotlighting”-ot is, egy speciális azonnali mérnöki megközelítést, amelyet a közvetett támadások megakadályozására terveztek. A reflektorfénybe helyezési technikák, például az elhatárolás és az adatjelölés, segítenek az LLM-eknek egyértelműen megkülönböztetni a jogos utasításokat a potenciálisan káros beágyazott parancsoktól.

Elérhetőség

A Prompt Shields jelenleg nyilvános előnézetben van az Azure AI Content Safety részeként, és április 1-jén lesz elérhető az Azure OpenAI szolgáltatásban. A közeljövőben tervezik az Azure AI Stúdióba való integrációt.