Az Opera az első böngésző, amely integrálja a helyi LLM-eket

1 perc olvas

Frissítve

Olvassa el közzétételi oldalunkat, hogy megtudja, hogyan segítheti az MSPowerusert a szerkesztői csapat fenntartásában Tovább

Főbb megjegyzések

- A felhasználók mostantól közvetlenül kezelhetik és elérhetik eszközeiken a hatékony AI-modelleket, amelyek a felhőalapú mesterségesintelligencia-technológiához képest nagyobb adatvédelmet és sebességet kínálnak.

Opera ma bejelentés kísérleti támogatás 150 helyi nagynyelvi modellhez (LLM) az Opera One fejlesztői böngészőjében. Ezzel a támogatással a felhasználók közvetlenül kezelhetik és elérhetik eszközeiken a hatékony AI-modelleket, amelyek a felhőalapú mesterségesintelligencia-technológiához képest fokozott adatvédelmet és sebességet kínálnak.

Bővített választék és adatvédelem a helyi LLM-ekkel

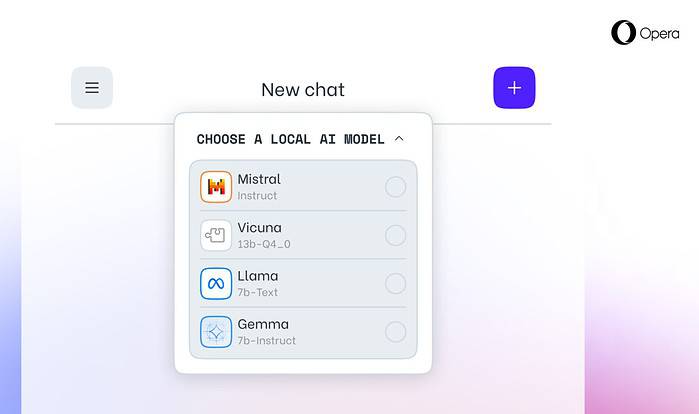

Az Opera integrációja olyan népszerű LLM-eket tartalmaz, mint a Meta's Llama, Vicuna, a Google Gemma, a Mistral AI's Mixtral és még sok más. A helyi LLM-ek szükségtelenné teszik az adatok szerverekkel való megosztását, így védik a felhasználók adatait. Az Opera AI Feature Drops Programja lehetővé teszi a fejlesztők számára a korai hozzáférést ezekhez az élvonalbeli szolgáltatásokhoz.

Hogyan lehet elérni a helyi LLM-eket az Operában

A felhasználók meglátogathatják Az Opera fejlesztői oldala frissíteni az Opera One Developer verzióra, lehetővé téve a preferált helyi LLM kiválasztását és letöltését. Miközben tárhelyet igényelnek (modellenként 2-10 GB), a helyi LLM-ek jelentős sebességnövekedést kínálhatnak a felhőalapú alternatívákhoz képest, hardvertől függően.

Az Opera elkötelezettsége az AI innováció iránt

„A helyi LLM-ek ily módon történő bevezetése lehetővé teszi az Opera számára, hogy elkezdje felfedezni a tapasztalatok és know-how építésének módjait a gyorsan fejlődő helyi mesterséges intelligencia terén” – mondta Krystian Kolondra, az Opera böngészők és játékokért felelős alelnöke.