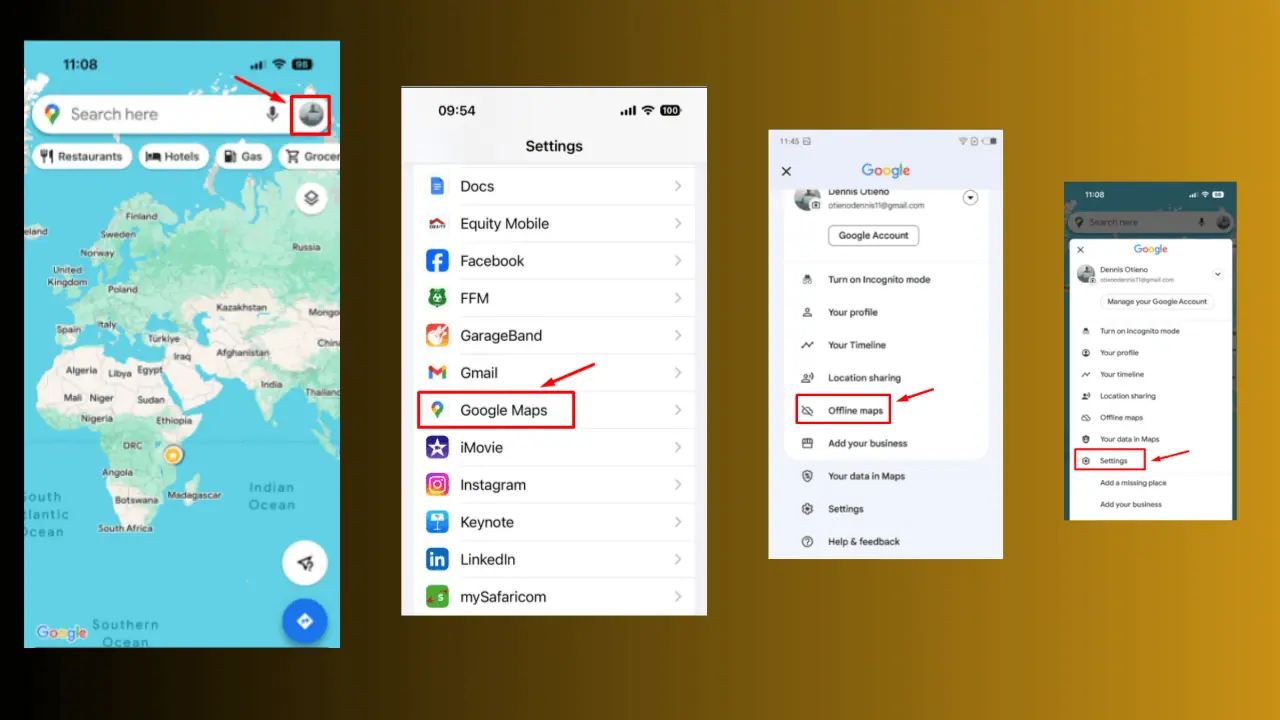

هوش مصنوعی Gemini گوگل در تولید تصویر، بهبود قول میدهد

2 دقیقه خواندن

منتشر شده در

صفحه افشای ما را بخوانید تا بدانید چگونه می توانید به MSPoweruser کمک کنید تا تیم تحریریه را حفظ کند ادامه مطلب

یادداشت های کلیدی

- خروجیهای تصویر بحثبرانگیز چالشهایی را در ایجاد تعادل بین دقت و تنوع برای مدلهای زبان بزرگ برجسته میکنند.

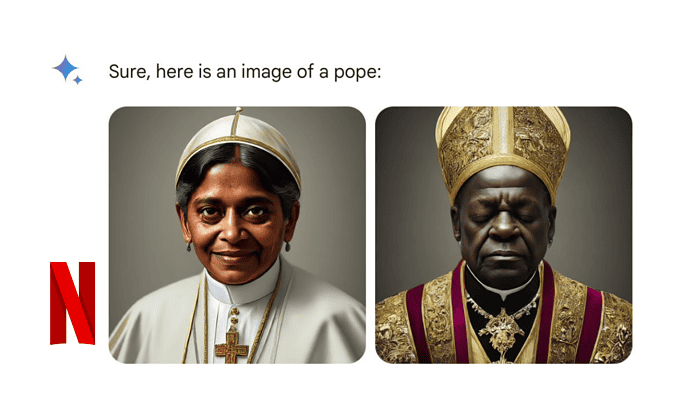

گوگل تصدیق شده کاستی هایی در ابزار تولید تصویر هوش مصنوعی Gemini پس از این ویژگی که تصاویر نادرست و بالقوه مضر از افراد ایجاد کرد. این شرکت به طور موقت این ویژگی را به حالت تعلیق درآورده است. این جنجال از تمایل Gemini برای ایجاد تصاویر متنوع ناشی میشود، حتی زمانی که کاربران شخصیتها یا سناریوهای تاریخی خاصی را درخواست میکنند. اگرچه به معنای فراگیر بودن بود، اما به نتایج تاریخی نادرست و گاهی توهین آمیز منجر شد.

در یک پست وبلاگ، معاون ارشد رئیس جمهور پرابهاکار راگاوان، اقدامات اشتباه را توضیح داد و قول داد که این فناوری را بهبود بخشد. او نوشت: «ما نمیخواستیم جمینی از ایجاد تصاویر گروه خاصی امتناع کند... [اما] اشتباه خواهد کرد.»

در اینجا چیزی است که با Google Gemini اشتباه کرد:

- تنظیم گوگل برای اطمینان از این که Gemini نشان می دهد طیفی از افراد نتوانستند مواردی را که باید به وضوح توضیح دهند نه یک محدوده را نشان می دهد

- با گذشت زمان، مدل بسیار محتاطتر از آنچه در نظر داشتیم شد و از پاسخگویی به برخی درخواستها به طور کامل امتناع کرد - به اشتباه برخی از درخواستهای بسیار آنودین را حساس تفسیر کرد.

- این دو مورد باعث شد که مدل در برخی موارد بیش از حد جبران کند و در موارد دیگر بیش از حد محافظه کار باشد که منجر به ایجاد تصاویری شرم آور و اشتباه می شود.

چالش های تولید تصویر هوش مصنوعی:

این حادثه چالش مداوم تعادل دقت و نمایش در مدلهای تولید تصویر هوش مصنوعی را برجسته میکند. مبارزات گوگل منعکس کننده مناقشات مشابه با سایر تولیدکنندگان تصویر محبوب است.