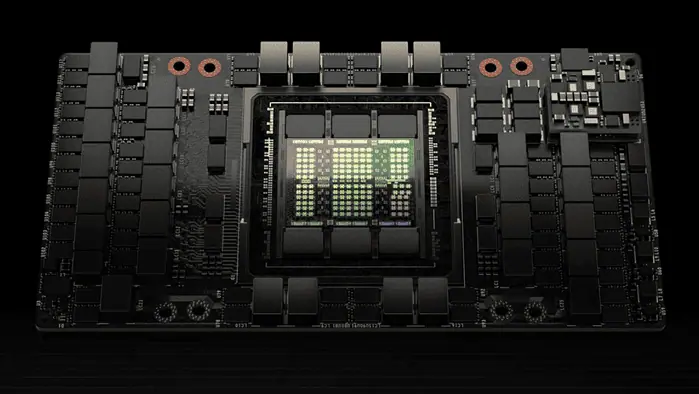

Microsoft trænede kun Phi-3 Mini i en uge med Nvidias AI-venlige H100 GPU'er

Phi-3's Mini-version er den eneste model, der er tilgængelig i øjeblikket

2 min. Læs

Udgivet den

Læs vores oplysningsside for at finde ud af, hvordan du kan hjælpe MSPoweruser med at opretholde redaktionen Læs mere

Nøgle noter

- Microsoft lancerede Phi-3-modeller, ledet af Phi-3 Mini med 3.8B parametre,

- Modellen blev trænet på 3.3 billioner tokens på syv dage ved hjælp af 512 NVIDIA H100 GPU'er.

- Phi-3-familien inkluderer også små og mellemstore varianter, der overgår tidligere modeller som Phi-2.

Microsoft lancerede Phi-3 familie af modeller, en af de bedste små modeller på markedet i øjeblikket. Og nu, Nvidia sagde og beskrev, hvordan Redmond-virksomheden brugte sine H100 GPU'er til at træne disse modeller, eller mere specifikt, Mini, 3.8B-versionen.

"Modellen har 3.8 milliarder parametre og blev trænet på 3.3 billioner tokens på kun syv dage på 512 NVIDIA H100 Tensor Core GPU'er," sagde teknologiproducenten tirsdag.

Familien af Phi-3 kommer med tre varianter: Phi-3 Mini (3.8B), Phi-3 Small (7B) og Phi-3 Medium (14B). Det er en kæmpe forbedring i forhold til tidligere Phi-2 der blev lanceret med kun 2.7B parametre for måneder siden.

Phi-3 Mini kommer mere specifikt også med to muligheder afhængigt af understøttende tokens: 4K og 128K. Du kan prøve sidstnævnte på Nvidias AI-center som en Nvidia NIM-tjeneste for udviklere og køre modellen lokalt ved hjælp af Windows DirectML eller TensorRT-LLM.

"Phi-3-modeller klarer sig væsentligt bedre end sprogmodeller af samme og større størrelser på vigtige benchmarks (se benchmark-tal nedenfor, højere er bedre)," Microsoft sagde ved lanceringen af modellerne, prale af, at de små og mellemstore versioner kan udkonkurrere større modeller som GPT-3.5T.

Mini-versionen er, hvad der er tilgængeligt på markedet i øjeblikket, men Microsoft lovede, at alle de to andre modeller vil være tilgængelige inden længe. Du kan også prøve Phi-3 Mini på Azure AI og Hugging Face.