Microsoft Azure AI odhaluje „Prompt Shields“ pro boj s manipulací LLM

2 min. číst

Publikované dne

Přečtěte si naši informační stránku a zjistěte, jak můžete pomoci MSPoweruser udržet redakční tým Dozvědět se více

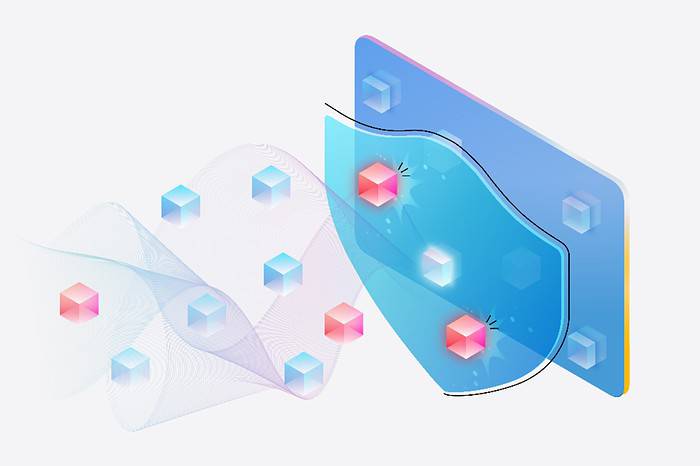

Microsoft dnes oznámila, významné vylepšení zabezpečení pro platformy Azure OpenAI Service a Azure AI Content Safety. Nová funkce nazvaná „Prompt Shields“ nabízí robustní obranu proti stále sofistikovanějším útokům zaměřeným na velké jazykové modely (LLM).

Prompt Shields chrání před:

- Přímé útoky: Tyto pokusy, známé také jako útoky z vězení, výslovně instruují LLM, aby ignorovala bezpečnostní protokoly nebo provedla škodlivé akce.

- Nepřímé útoky: Tyto útoky nenápadně vkládají škodlivé instrukce do zdánlivě normálního textu s cílem přimět LLM k nežádoucímu chování.

Prompt Shields je integrován s filtry obsahu služby Azure OpenAI a jsou k dispozici v Azure AI Content Safety. Díky pokročilým algoritmům strojového učení a zpracování přirozeného jazyka dokáže Prompt Shields identifikovat a neutralizovat potenciální hrozby v uživatelských výzvách a datech třetích stran.

Spotlighting: Nová obranná technika

Společnost Microsoft také představila „Spotlighting“, což je specializovaný rychlý inženýrský přístup určený k maření nepřímých útoků. Techniky bodového osvětlení, jako je vymezování a označování dat, pomáhají LLM jasně rozlišovat mezi legitimními pokyny a potenciálně škodlivými vloženými příkazy.

Dostupnost

Prompt Shields je aktuálně ve verzi Public Preview jako součást Azure AI Content Safety a bude k dispozici v rámci Azure OpenAI Service 1. dubna. V blízké budoucnosti se plánuje integrace do Azure AI Studio.