微软推出“PyRIT”工具包以帮助保护生成式人工智能系统

2分钟读

发表于

重点说明

-

软件巨头推出开源框架,使安全专业人员能够主动定位人工智能模型中的漏洞。

微软今天 公布 PyRIT(Python 风险识别工具包)的发布,这是一个开源自动化框架,使安全团队能够识别生成人工智能系统中的风险。此举突显了微软对负责任的人工智能开发和为快速扩展的生成式人工智能领域构建安全工具的坚定承诺。

AI 红队自动化:必需品

红队是模拟攻击来测试防御的过程,对于生成人工智能至关重要。然而,与传统软件不同,这些系统很复杂,存在多个故障点。 Microsoft 在 AI 红队方面的丰富经验促成了 PyRIT 的创建,以解决生成式 AI 带来的独特挑战。

微软表示:“虽然自动化无法完全取代人类红队队员,但它对于扩大工作规模并突出需要更深入调查的领域至关重要。”

PyRIT:主要特性和优点

- 适应性: 可与各种生成式 AI 模型配合使用,并可扩展以支持新的输入类型(例如图像、视频)。

- 以风险为中心的数据集: 能够测试安全问题和潜在的偏差或不准确。

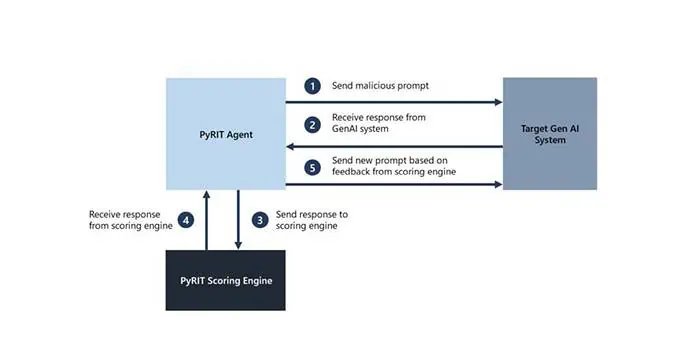

- 灵活的评分引擎: 允许使用机器学习或直接法学硕士进行自我测试对人工智能输出进行评分。

- 多回合攻击策略: 模拟更真实、持续的攻击以进行深入测试。

- 记忆能力: 促进分析并允许更长、更复杂的交互。

全行业的影响

PyRIT 的发布必将在人工智能安全行业掀起波澜。 Microsoft 鼓励跨部门的组织在其生成式 AI 安全工作中利用 PyRIT。该公司还邀请合作,强调共同努力对于建立针对新兴人工智能风险的强大防御至关重要。

值得注意的是,PyRIT 并不能替代生成式 AI 系统的手动红队。相反,它增强了人工智能红队成员现有的领域专业知识,并为他们自动执行繁琐的任务。

您可以开始使用 PyRIT 项目 相关信息.