Microsoft 推出 Phi-3 系列型号,其性能优于同类其他型号

2分钟读

发表于

早在 2023 年 XNUMX 月,微软就发布了 Φ2 具有 2.7 亿个参数的模型,在参数少于 13 亿个的基本语言模型中提供了最先进的性能。在过去的四个月里,发布的其他几个模型的性能优于 Phi-2。最近,Meta 发布了 Llama-3 系列模型,其性能优于之前发布的所有开源模型。

昨晚,微软研究院发布了 Phi-3 系列模型 技术报告。 Phi-3 系列共有三种型号:

- phi-3-迷你 (3.8B)

- phi-3-小 (7B)

- phi-3-中 (14B)

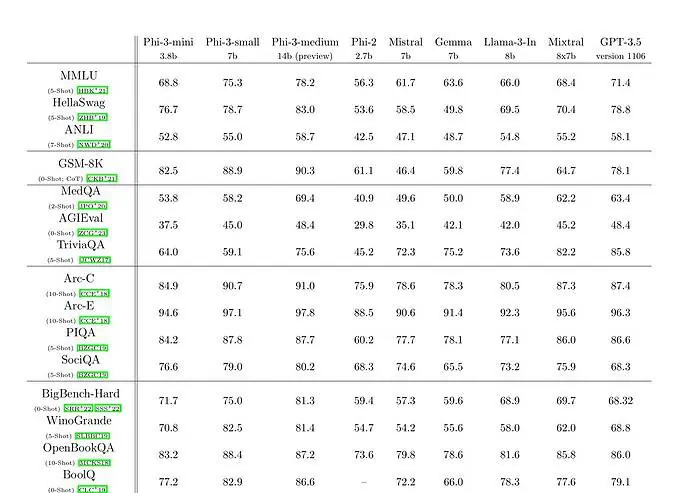

具有 3 亿参数语言模型的 phi-3.8-mini 在 3.3 万亿个代币上进行训练。根据基准测试,phi-3-mini 击败了 Mixtral 8x7B 和 GPT-3.5。微软声称该模型足够小,可以部署在手机上。微软使用了用于 phi-2 的数据集的放大版本,由经过严格过滤的网络数据和合成数据组成。根据微软在技术论文中的基准测试结果,phi-3-small 和 phi-3-medium 分别获得了 75.3 和 78.2 的令人印象深刻的 MMLU 分数。

就 LLM 能力而言,虽然 Phi-3-mini 模型实现了与大型模型相似的语言理解和推理能力水平,但它在某些任务上仍然受到其规模的根本限制。该模型根本没有能力存储广泛的事实知识,例如,TriviaQA 上的性能较低就可以看出这一点。然而,我们相信这个弱点可以通过搜索引擎的增强来解决。