谷歌的 Gemini AI 在图像生成方面遭遇挫折,誓言改进

2分钟读

更新

重点说明

- 有争议的图像输出凸显了平衡大型语言模型的准确性和多样性方面的挑战。

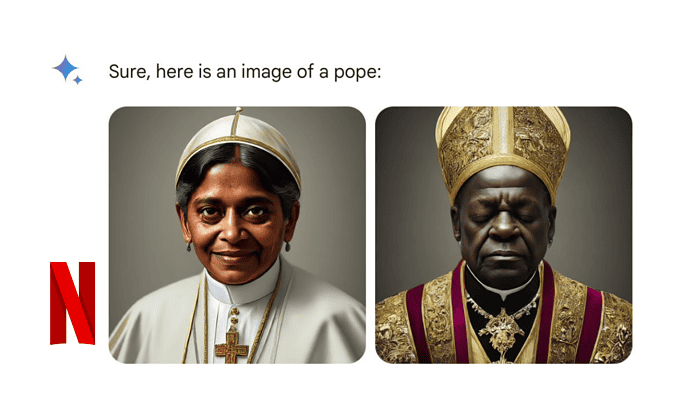

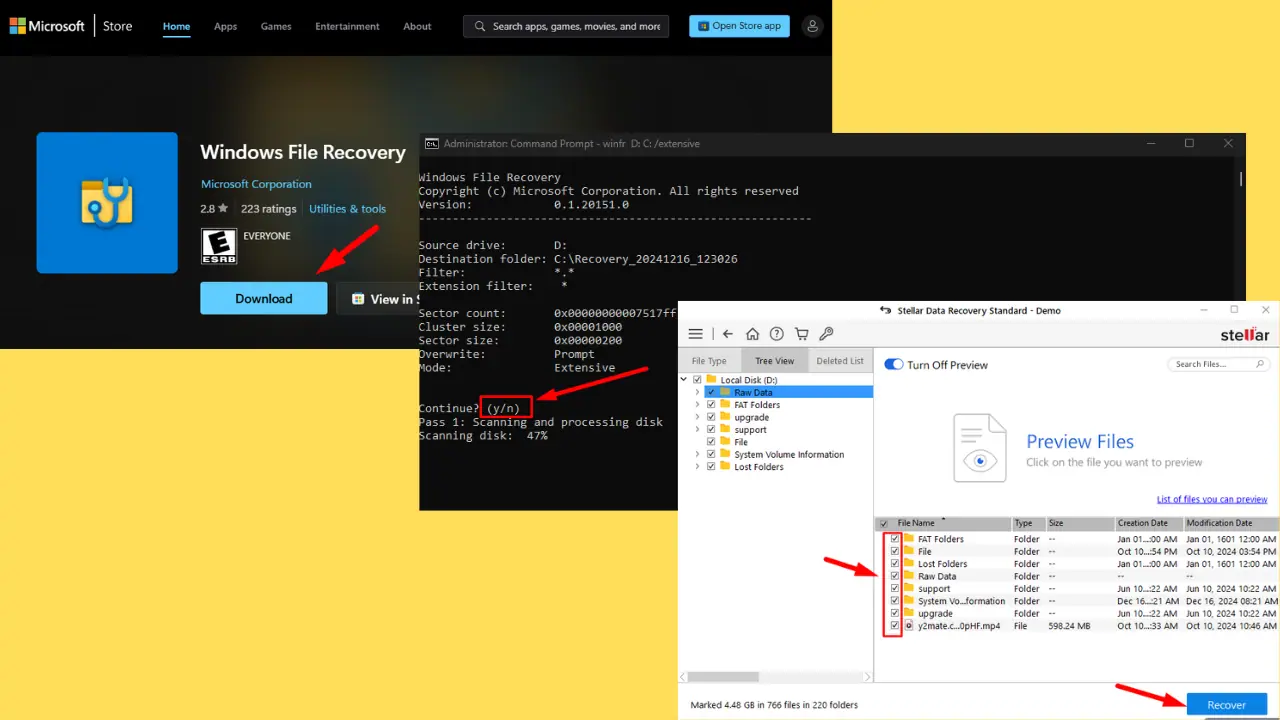

Google 承认 该公司在其 Gemini AI 图像生成工具中发现了一些缺陷,该功能生成的人物图像不准确且可能有害。该公司已暂时停止该功能,同时修复相关问题。争议源于 Gemini 倾向于创建多样化图像,即使用户要求特定的历史人物或场景。尽管本意是包容性的,但这导致了历史不准确,有时甚至令人反感的结果。

在一篇博文中,高级副总裁 Prabhakar Raghavan 解释了这些失误,并誓言要改进这项技术。 “我们不希望双子座拒绝创造任何特定群体的形象……[但]它会犯错误,”他写道。

以下是 Google Gemini 的问题所在:

- 谷歌为确保双子座显示一系列人而进行的调整未能解释应该清楚地说明的情况 而不去 显示一个范围。

- 随着时间的推移,该模型变得比我们预想的更加谨慎,并且完全拒绝回答某些提示——错误地将一些非常镇痛的提示解释为敏感。

- 这两件事导致模型在某些情况下过度补偿,而在另一些情况下过度保守,导致图像令人尴尬和错误。

AI 图像生成的挑战:

这一事件突显了人工智能图像生成模型中平衡准确性和表示性所面临的持续挑战。谷歌的困境反映了其他流行图像生成器的类似争议。

用户论坛

1消息