Snowflake Arctic пишається як «найкращий магістр права для корпоративного ШІ». Це досить велика претензія

Ви можете спробувати Snowflake на HuggingFace зараз

2 хв. читати

Опубліковано

Прочитайте нашу сторінку розкриття інформації, щоб дізнатися, як ви можете допомогти MSPoweruser підтримувати редакційну команду Читати далі

Основні нотатки

- Snowflake представляє Arctic, стверджуючи, що він конкурує з Llama 3 70B за нижчою ціною.

- Arctic чудово справляється з такими корпоративними завданнями, як кодування та генерація SQL.

- Використовуючи гібрид Dense-MoE, Arctic оптимізує ефективність для різних розмірів партій.

Snowflake, гігант хмарних обчислень, спочатку створений колишніми вченими Oracle, тепер кидає виклик великим гравцям у війні ШІ. Компанія запущена Сніжинка Арктика, свого останнього «найкращого LLM для корпоративного ШІ», і стверджував, що він кращий, ніж нарівні з Llama 3 70B, і кращим, ніж варіант 8B останнього.

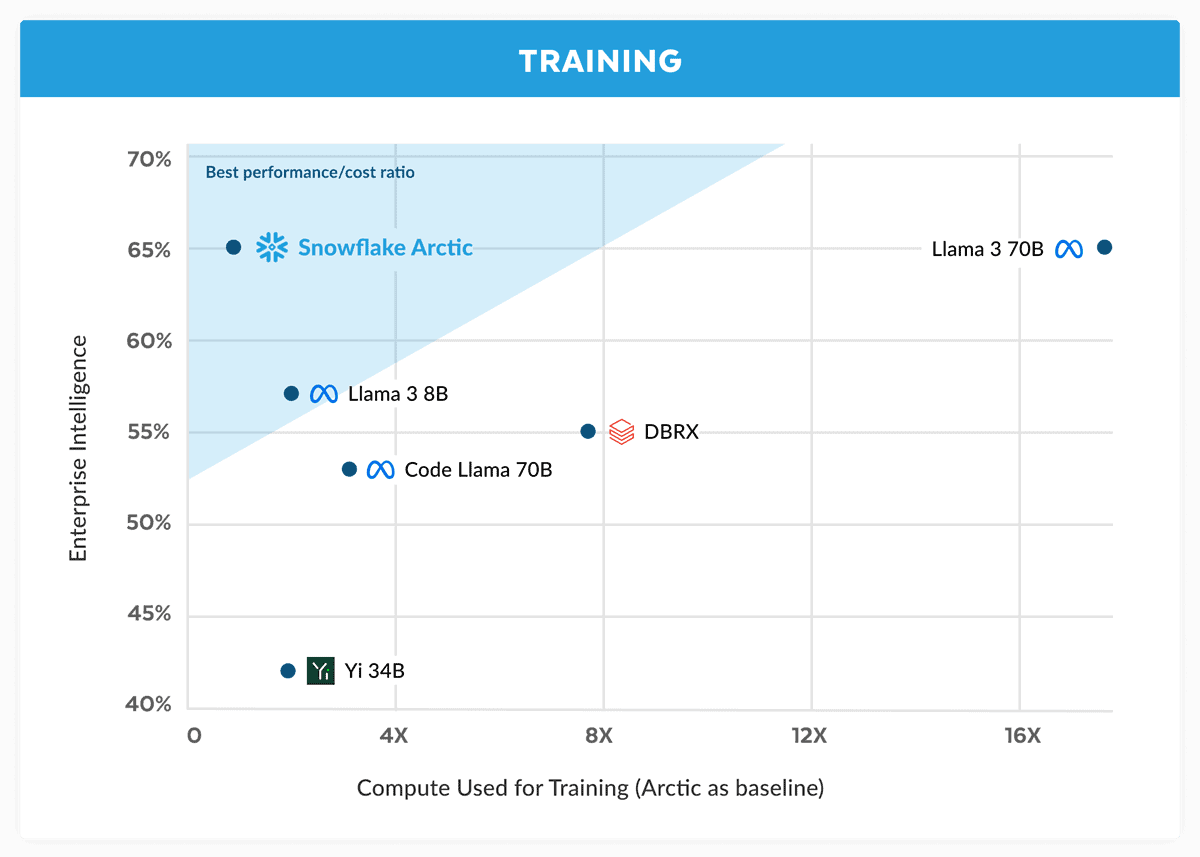

У своєму анонсі Snowflake стверджує, що модель Arctic відповідає продуктивності Llama 3 70B, але з нижчими вимогами до обчислень і меншими витратами. Він рекламується як ідеальний для завдань корпоративного інтелекту в таких областях і тестах, як кодування (HumanEval+ і MBPP+), генерація SQL (Spider) і виконання інструкцій (IFEval).

Це велика претензія, особливо враховуючи це Лама 3 70B у важливих тестах демонструє хороші результати проти інших основних моделей, таких як GPT-4 Turbo та Claude 3 Opus. Повідомляється, що майбутня модель Meta має хороші результати в таких тестах, як MMLU (для розуміння предметів), GPQA (біологія, фізика та хімія та HumanEval (кодування).

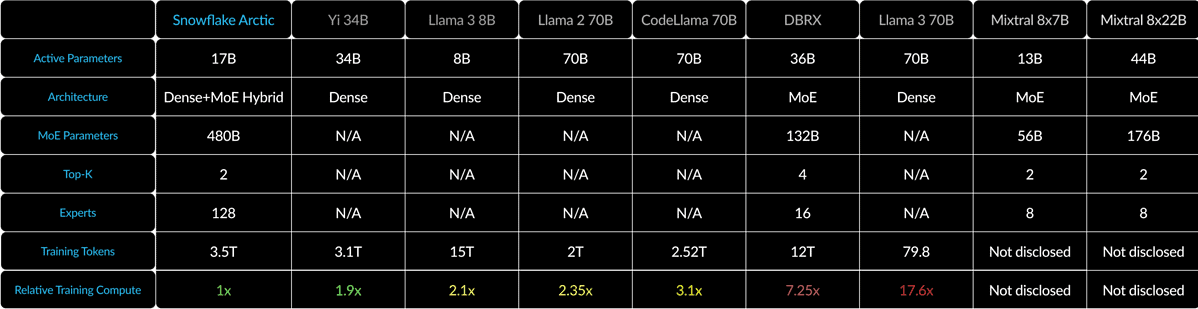

Snowflake Arctic поєднує щільний трансформатор 10B з MLP 128×3.66B MoE за допомогою гібриду Dense-MoE. Загалом це 480B параметрів, але тільки 17B активно використовуються, вибрані за допомогою топ-2 стробування.

Для невеликих розмірів пакетів, як-от 1, Arctic зменшує читання пам’яті до 4 разів порівняно з Code-Llama 70B і до 2.5 разів менше, ніж Mixtral 8x22B. Але, оскільки розміри пакетів значно збільшуються, Arctic стає обмеженим обчисленнями. Він потребує в 4 рази менше обчислень, ніж CodeLlama 70B і Llama 3 70B.

Ви можете приміряти Snowflake Arctic HuggingFace. Компанія також обіцяє, що модель незабаром з’явиться в інших моделях, таких як AWS, Microsoft Azure, Perplexity тощо.