Microsoft Research представляє Splitwise, нову техніку для підвищення ефективності GPU для великих мовних моделей

2 хв. читати

Опубліковано

Прочитайте нашу сторінку розкриття інформації, щоб дізнатися, як ви можете допомогти MSPoweruser підтримувати редакційну команду Читати далі

Основні нотатки

- Splitwise — це прорив у ефективності та стійкості висновків LLM.

- Розділивши фази підказок і маркерів, Splitwise розкриває новий потенціал у використанні GPU та дозволяє хмарним провайдерам обслуговувати більше запитів швидше за той самий бюджет.

Великі мовні моделі (LLM) трансформують сфери обробки природної мови та штучного інтелекту, уможливлюючи такі програми, як генерація коду, розмовні агенти та резюмування тексту. Однак ці моделі також створюють значні проблеми для хмарних провайдерів, яким потрібно розгортати все більше і більше графічних процесорів (GPU), щоб задовольнити зростаючий попит на висновки LLM.

Проблема полягає в тому, що графічні процесори не тільки дорогі, але й енергоємні, а здатність забезпечити електроенергію, необхідну для їх роботи, обмежена. У результаті хмарні провайдери часто стикаються з дилемою: відхилити запити користувачів або збільшити свої операційні витрати та вплив на навколишнє середовище.

Щоб вирішити цю проблему, дослідники Microsoft Azure розробили нову техніку під назвою Спільно, який має на меті зробити висновок LLM більш ефективним і стійким шляхом поділу обчислень на дві окремі фази та розподілу їх між різними машинами. Детально про цю техніку ви можете прочитати в їх «Splitwise: Ефективний генеративний висновок LLM з використанням фазового розбиття" Науково-дослідна робота.

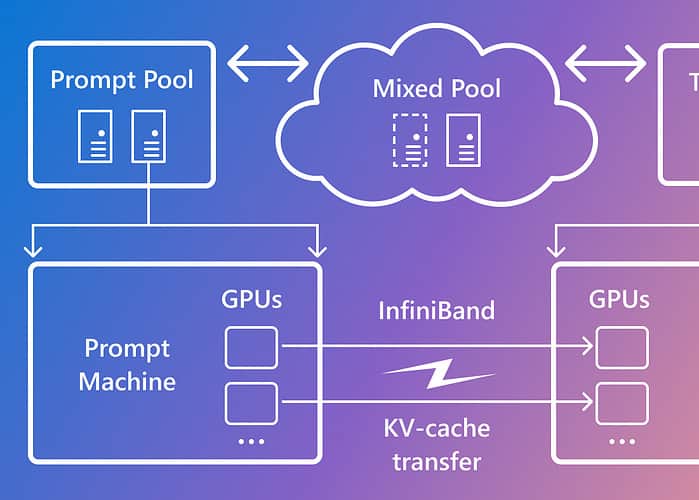

Splitwise базується на спостереженні, що висновок LLM складається з двох фаз з різними характеристиками: фази підказки та фази генерації маркерів. На етапі підказки модель обробляє введені користувачем або підказки паралельно, використовуючи велику кількість обчислень GPU. На етапі генерації маркерів модель генерує кожен вихідний маркер послідовно, використовуючи велику пропускну здатність пам’яті GPU. На додаток до розділення двох фаз висновку LLM на два окремих машинних пулу, Microsoft використала третій машинний пул для змішаного пакетування між фазами підказок і маркерів, розмір яких динамічно змінювався на основі обчислювальних вимог у реальному часі.

Використовуючи Splitwise, Microsoft вдалося досягти наступного:

- У 1.4 раза вища пропускна здатність за 20% нижчої вартості, ніж поточні конструкції.

- У 2.35 рази більше пропускної здатності за тих самих витрат і бюджету електроенергії.

Splitwise — це прорив у ефективності та стійкості висновків LLM. Розділивши фази підказок і маркерів, Splitwise розкриває новий потенціал у використанні GPU та дозволяє хмарним провайдерам обслуговувати більше запитів швидше за той самий бюджет. Splitwise тепер є частиною vLLM і також може бути реалізований з іншими фреймворками. Дослідники з Microsoft Azure планують продовжувати свою роботу над підвищенням ефективності та стійкості висновків LLM, а також передбачають індивідуальні пули машин, що забезпечують максимальну пропускну здатність, зниження витрат та енергоефективність.