Microsoft і NVIDIA анонсують найбільшу та найпотужнішу мовну модель, яку навчали на сьогоднішній день

1 хв. читати

Опубліковано

Прочитайте нашу сторінку розкриття інформації, щоб дізнатися, як ви можете допомогти MSPoweruser підтримувати редакційну команду Читати далі

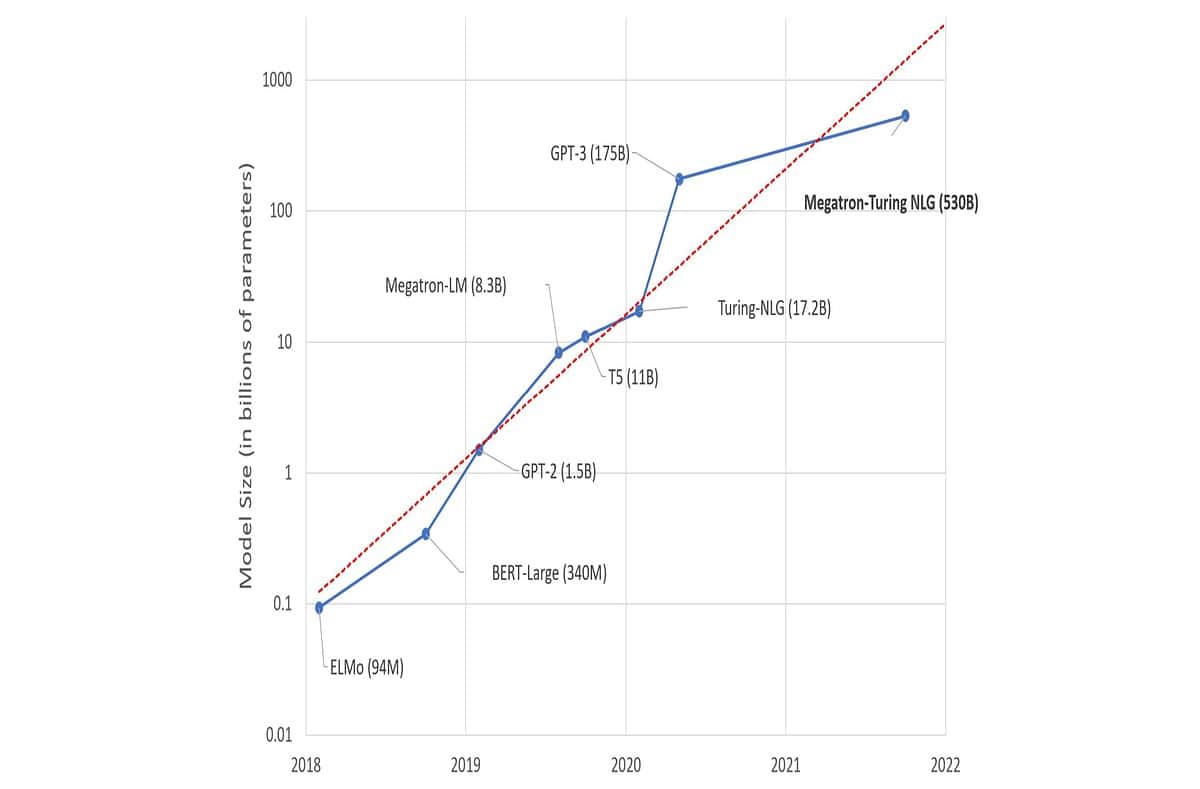

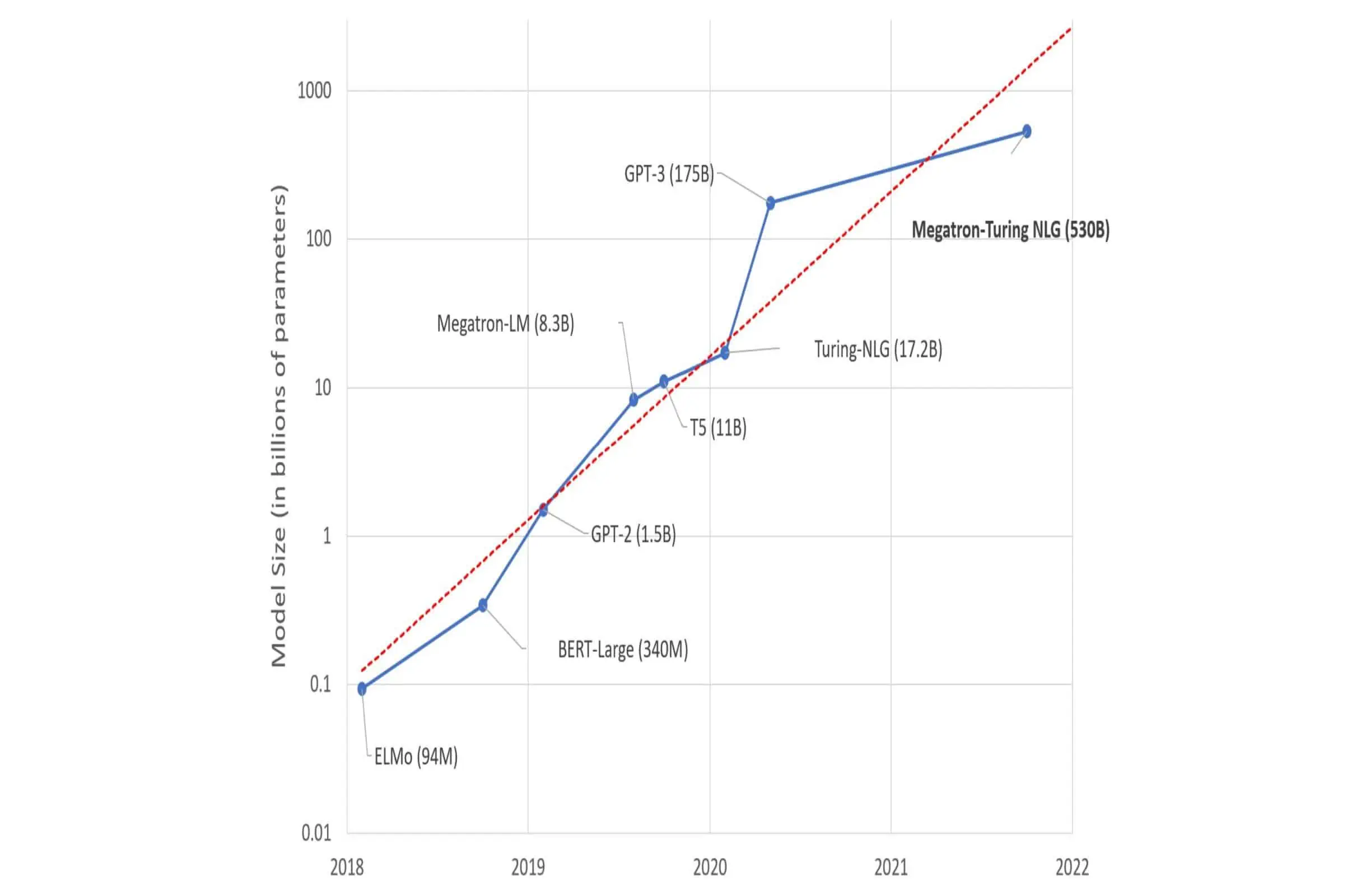

Microsoft і NVIDIA сьогодні анонсували модель генерації природної мови Megatron-Turing (MT-NLG) на базі DeepSpeed і Megatron, найбільшу та найпотужнішу монолітну модель мови-трансформера, яку навчали на сьогоднішній день. Ця модель включає 530 мільярдів параметрів, що в 3 рази більше, ніж у існуючій найбільшій моделі GPT-3. Навчання такої великої моделі пов’язане з різними проблемами. NVIDIA і Microsoft працювали над багатьма інноваціями та проривами на всіх осях ШІ.

Наприклад, тісно співпрацюючи, NVIDIA і Microsoft досягли безпрецедентної ефективності навчання, об’єднавши найсучаснішу інфраструктуру навчання з прискореним графічним процесором з передовим стеком програмного забезпечення для розподіленого навчання. Ми створили високоякісні навчальні корпуси природних мов із сотнями мільярдів токенів і спільно розробили навчальні рецепти для підвищення ефективності та стабільності оптимізації.

Ви можете дізнатися більше про цей проект за посиланнями нижче.