Microsoft Research, Büyük Dil Modelleri için GPU verimliliğini artırmaya yönelik yeni bir teknik olan Splitwise'ı tanıtıyor

2 dk. okuman

Yayınlandı

MSPoweruser'ın editör ekibini ayakta tutmasına nasıl yardımcı olabileceğinizi öğrenmek için açıklama sayfamızı okuyun. Daha fazla

Önemli notlar

- Splitwise, LLM çıkarım verimliliği ve sürdürülebilirliğinde bir atılımdır.

- Splitwise, istem ve belirteç aşamalarını ayırarak GPU kullanımında yeni potansiyelin kilidini açar ve bulut sağlayıcılarının aynı güç bütçesi altında daha fazla sorguyu daha hızlı sunmasına olanak tanır.

Büyük dil modelleri (LLM'ler), doğal dil işleme ve yapay zeka alanlarını dönüştürerek kod oluşturma, konuşma aracıları ve metin özetleme gibi uygulamaları mümkün kılıyor. Ancak bu modeller, LLM çıkarımına yönelik artan talebi karşılamak için giderek daha fazla grafik işlem birimi (GPU) dağıtması gereken bulut sağlayıcıları için de önemli zorluklar yaratıyor.

Sorun, GPU'ların yalnızca pahalı olması değil, aynı zamanda çok fazla enerji tüketmesi ve bunları çalıştırmak için gereken elektriği sağlama kapasitesinin sınırlı olmasıdır. Sonuç olarak, bulut sağlayıcıları sıklıkla kullanıcı sorgularını reddetme ya da operasyonel maliyetlerini ve çevresel etkilerini artırma ikilemiyle karşı karşıya kalıyor.

Bu sorunu çözmek için Microsoft Azure'daki araştırmacılar, adı verilen yeni bir teknik geliştirdiler. SplitwiseHesaplamayı iki farklı aşamaya bölerek ve bunları farklı makinelere tahsis ederek LLM çıkarımını daha verimli ve sürdürülebilir hale getirmeyi amaçlamaktadır. Bu teknik hakkında ayrıntılı olarak onların “Splitwise: Faz Bölmeyi Kullanarak Verimli Üretken LLM Çıkarımı" Araştırma kağıdı.

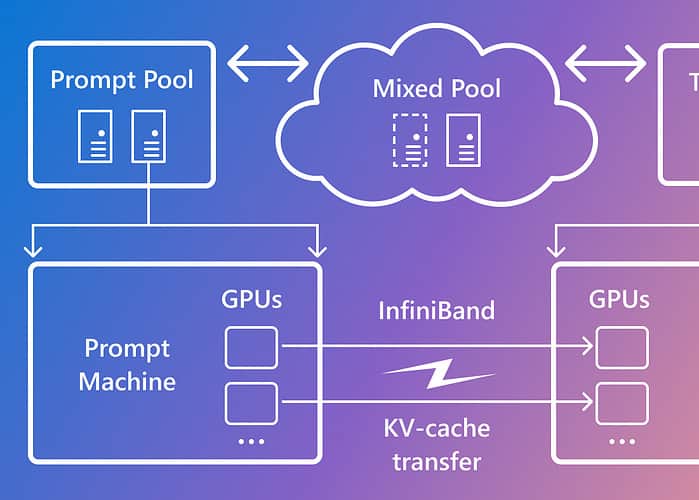

Splitwise, LLM çıkarımının farklı özelliklere sahip iki aşamadan oluştuğu gözlemine dayanmaktadır: istem aşaması ve jeton oluşturma aşaması. Bilgi istemi aşamasında model, çok sayıda GPU hesaplaması kullanarak kullanıcı girişini veya istemini paralel olarak işler. Belirteç oluşturma aşamasında model, büyük miktarda GPU bellek bant genişliği kullanarak her çıkış belirtecini sırayla üretir. Microsoft, iki LLM çıkarım aşamasını iki farklı makine havuzuna ayırmanın yanı sıra, bilgi istemi ve belirteç aşamaları boyunca karma toplu işlem için gerçek zamanlı hesaplama taleplerine göre dinamik olarak boyutlandırılan üçüncü bir makine havuzu kullandı.

Microsoft, Splitwise'ı kullanarak aşağıdakileri başardı:

- Mevcut tasarımlara göre %1.4 daha düşük maliyetle 20 kat daha yüksek verim.

- Aynı maliyet ve güç bütçeleriyle 2.35 kat daha fazla verim.

Splitwise, LLM çıkarım verimliliği ve sürdürülebilirliğinde bir atılımdır. Splitwise, istem ve belirteç aşamalarını ayırarak GPU kullanımında yeni potansiyelin kilidini açar ve bulut sağlayıcılarının aynı güç bütçesi altında daha fazla sorguyu daha hızlı sunmasına olanak tanır. Splitwise artık vLLM'nin bir parçası ve diğer çerçevelerle de uygulanabiliyor. Microsoft Azure'daki araştırmacılar, LLM çıkarımını daha verimli ve sürdürülebilir hale getirmek için çalışmalarına devam etmeyi planlıyor ve özel makine havuzlarının maksimum verim, azaltılmış maliyetler ve güç verimliliği sağlayacağını öngörüyor.