Microsoft เปิดตัวโมเดลตระกูล Phi-3 ที่มีประสิทธิภาพเหนือกว่ารุ่นอื่นๆ ในระดับเดียวกัน

2 นาที. อ่าน

เผยแพร่เมื่อ

อ่านหน้าการเปิดเผยข้อมูลของเราเพื่อดูว่าคุณจะช่วย MSPoweruser รักษาทีมบรรณาธิการได้อย่างไร อ่านเพิ่มเติม

ย้อนกลับไปในเดือนธันวาคม 2023 Microsoft เปิดตัว พี-2 โมเดลที่มีพารามิเตอร์ 2.7 พันล้านพารามิเตอร์ที่ให้ประสิทธิภาพที่ล้ำสมัยในบรรดาโมเดลภาษาพื้นฐานที่มีพารามิเตอร์น้อยกว่า 13 พันล้านพารามิเตอร์ ในช่วงสี่เดือนที่ผ่านมา รุ่นอื่นๆ อีกหลายรุ่นที่เปิดตัวมีประสิทธิภาพเหนือกว่า Phi-2 เมื่อเร็ว ๆ นี้ Meta ได้เปิดตัวโมเดลตระกูล Llama-3 ซึ่งมีประสิทธิภาพเหนือกว่าโมเดลโอเพ่นซอร์สที่เปิดตัวก่อนหน้านี้ทั้งหมด

เมื่อคืนนี้ Microsoft Research ได้ประกาศเปิดตัวโมเดลตระกูล Phi-3 ผ่าน รายงานทางเทคนิค- ตระกูล Phi-3 มีสามรุ่น:

- พี-3-มินิ (3.8B)

- พี-3-เล็ก (7B)

- พี-3-มีเดียม (14B)

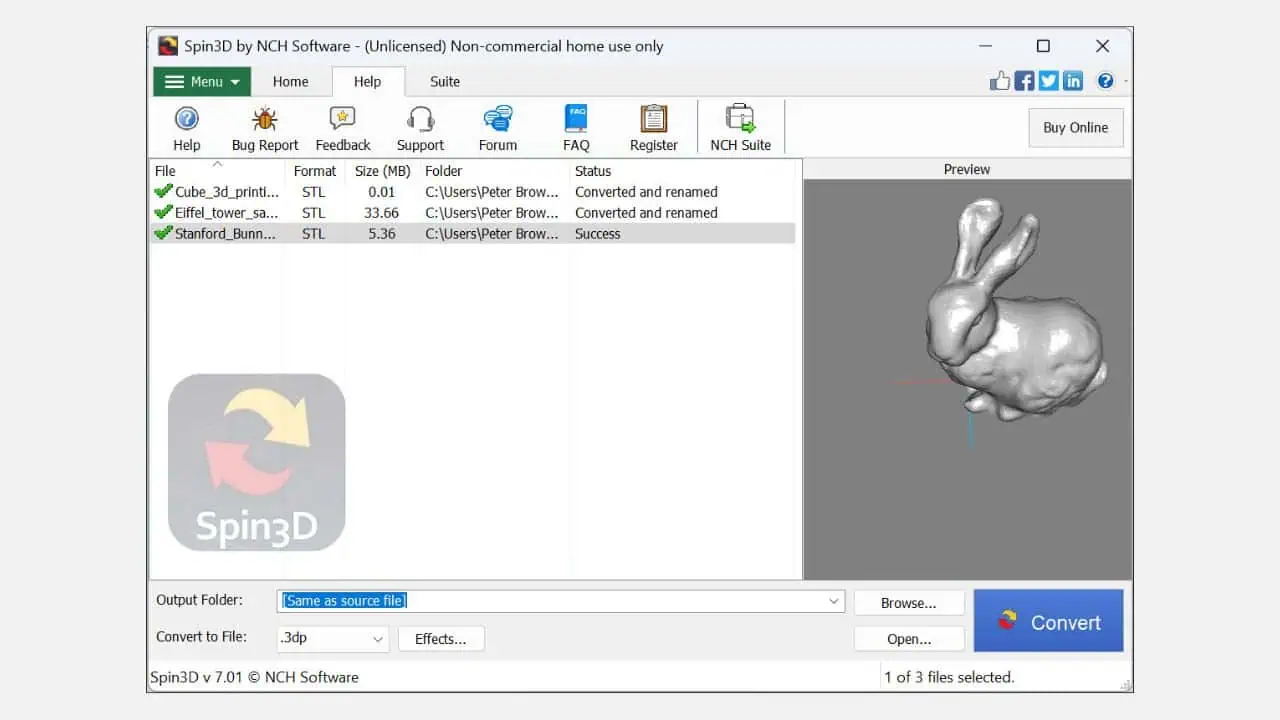

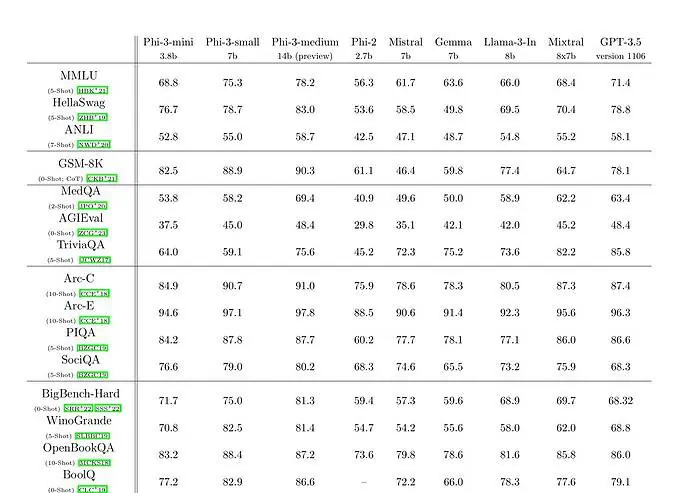

phi-3-mini ที่มีโมเดลภาษาพารามิเตอร์ 3.8 พันล้านได้รับการฝึกฝนบนโทเค็น 3.3 ล้านล้าน ตามเกณฑ์มาตรฐาน phi-3-mini เต้น Mixtral 8x7B และ GPT-3.5 Microsoft อ้างว่ารุ่นนี้มีขนาดเล็กพอที่จะติดตั้งบนโทรศัพท์ได้ Microsoft ใช้ชุดข้อมูลเวอร์ชันขยายขนาดซึ่งใช้สำหรับ phi-2 ซึ่งประกอบด้วยข้อมูลเว็บที่มีการกรองอย่างหนักและข้อมูลสังเคราะห์ จากผลการวัดประสิทธิภาพในเอกสารทางเทคนิคของ Microsoft พบว่า phi-3-small และ phi-3-medium ได้รับคะแนน MMLU ที่น่าประทับใจที่ 75.3 และ 78.2 ตามลำดับ

ในแง่ของความสามารถของ LLM แม้ว่าโมเดล Phi-3-mini จะมีความเข้าใจภาษาและความสามารถในการให้เหตุผลในระดับที่ใกล้เคียงกันกับโมเดลที่มีขนาดใหญ่กว่ามาก แต่ก็ยังถูกจำกัดโดยพื้นฐานด้วยขนาดของมันสำหรับงานบางอย่าง โมเดลไม่มีความสามารถในการจัดเก็บความรู้ข้อเท็จจริงที่กว้างขวาง ซึ่งสามารถเห็นได้ เช่น มีประสิทธิภาพต่ำบน TriviaQA อย่างไรก็ตาม เราเชื่อว่าจุดอ่อนนี้สามารถแก้ไขได้ด้วยการเสริมด้วยเครื่องมือค้นหา