Googles Gemini AI snubblar på bildgenerering, lovar förbättring

2 min. läsa

Publicerad den

Läs vår informationssida för att ta reda på hur du kan hjälpa MSPoweruser upprätthålla redaktionen Läs mer

Viktiga anteckningar

- Kontroversiella bilder visar utmaningar när det gäller att balansera noggrannhet och mångfald för stora språkmodeller.

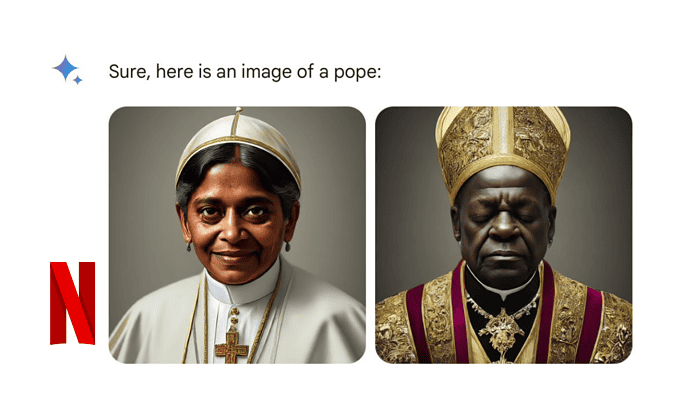

Google medgav brister i dess Gemini AI bildgenereringsverktyg efter att funktionen producerade felaktiga och potentiellt skadliga bilder av människor. Företaget har tillfälligt stängt av funktionen medan de arbetar på en fix. Kontroversen härrörde från Tvillingarnas tendens att skapa olika bilder, även när användare efterfrågade specifika historiska figurer eller scenarier. Även om det var tänkt att vara inkluderande ledde detta till historiskt felaktiga och ibland stötande resultat.

I ett blogginlägg förklarade Senior Vice President Prabhakar Raghavan misstagen och lovade att förbättra tekniken. "Vi ville inte att Tvillingarna skulle vägra att skapa bilder av någon speciell grupp ... [men] den kommer att göra misstag", skrev han.

Här är vad som gick fel med Google Gemini:

- Googles inställning för att säkerställa att Gemini visade en rad människor misslyckades med att ta hänsyn till fall som borde tydligt inte visa ett intervall.

- Med tiden blev modellen mycket mer försiktig än vi tänkt oss och vägrade att svara på vissa uppmaningar helt och hållet - och felaktigt tolkade vissa väldigt ointressanta uppmaningar som känsliga.

- Dessa två saker ledde till att modellen överkompenserade i vissa fall och var överkonservativ i andra, vilket ledde till bilder som var pinsamma och felaktiga.

Utmaningar med AI-bildgenerering:

Denna incident belyser den pågående utmaningen med att balansera noggrannhet och representation i AI-bildgenereringsmodeller. Googles kamp speglar liknande kontroverser med andra populära bildgeneratorer.