Google introducerar "nära mig" och "scenutforskning" för multisearch-teknik

3 min. läsa

Publicerad den

Läs vår informationssida för att ta reda på hur du kan hjälpa MSPoweruser upprätthålla redaktionen Läs mer

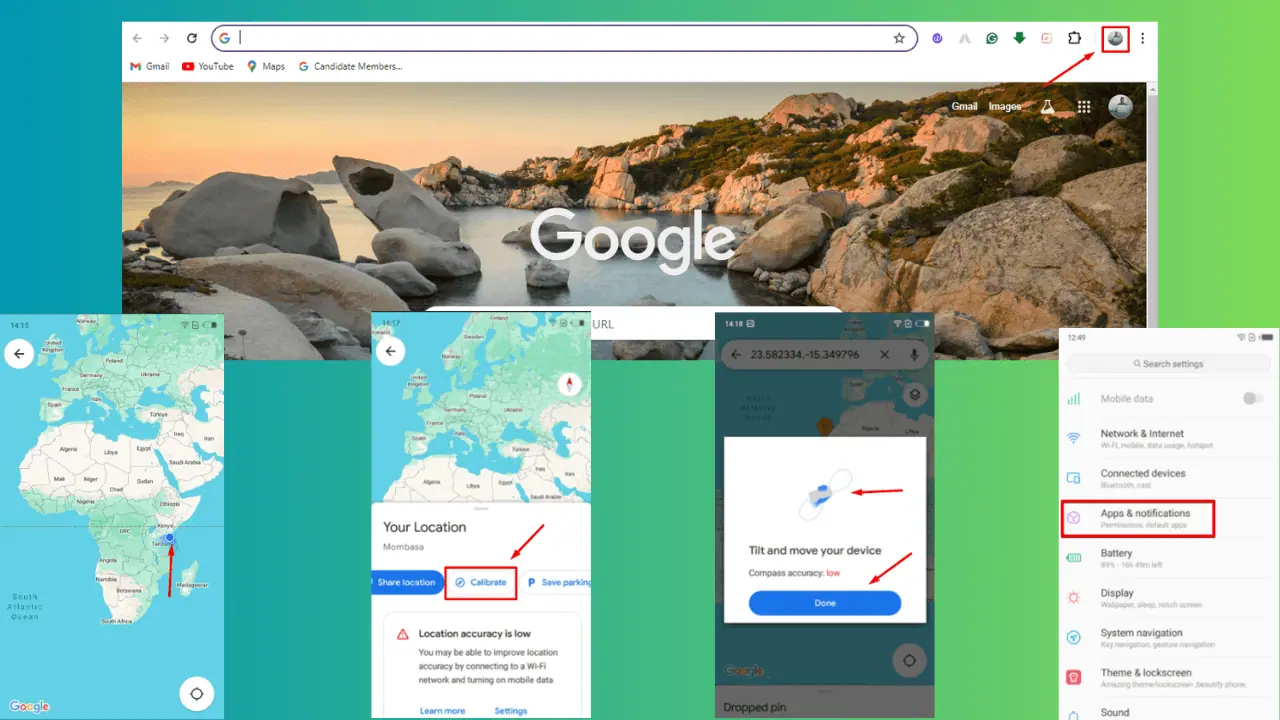

Förra månaden såg vi Google lansera multisökfunktion i Lens, som främst är avsedd att hjälpa användare i deras shoppingaktiviteter och att hitta särskilda föremål på marknaden genom samtidig användning av bild- och ordinmatningar. Nu har Google större ambitioner för tekniken genom att presentera mer avancerade funktioner som alla kan använda. På onsdag, Google Senior Vice President Prabhakar Raghavan avslöjade de kommande funktionerna inom Googles multisearch-teknik – "nära mig" och "scenutforskning".

Funktionen "nära mig", som planeras att släppas globalt senare i år på engelska först och sedan på andra språk över tiden, kommer att fungera precis som den grundläggande multisökningen där användare skulle behöva en blandning av bilder och ord i sin sökinmatning. Men istället för att fokusera orden på bildens fysiska utseende, kommer denna nya funktion att markera platsen för sökningen genom att använda frasen "nära mig." Om du gör det visar du de närmaste företagen som erbjuder produkten du letar efter.

"Säg till exempel att du ser en färgglad maträtt på nätet som du skulle vilja prova - men du vet inte vad den innehåller eller vad den heter", förklarar Raghavan. "När du använder multisökning för att hitta det nära dig, Google skannar miljontals bilder och recensioner som publicerats på webbsidor och från vår community av Maps-bidragsgivare för att hitta resultat om närliggande platser som erbjuder rätten så att du kan njuta av den själv.”

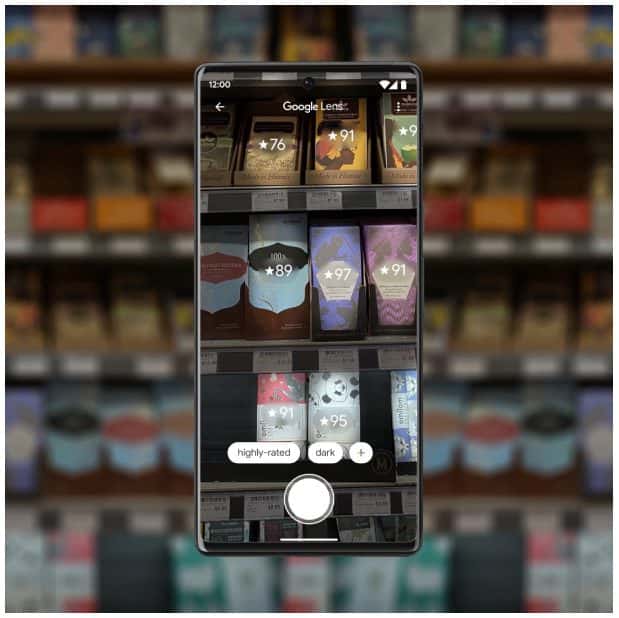

Funktionen "scenutforskning" har å andra sidan en mer lovande förmåga genom att tillåta användare att ta emot information om flera objekt inom kameraramen. Enligt Raghavan kommer detta att göra det möjligt för dig att panorera multisearch-kameran och omedelbart få information om föremålen som fångats på scenen.

"Föreställ dig att du försöker välja ut den perfekta godiskakan för din vän som är lite av en chokladkännare," utvecklar Raghavan. "Du vet att de älskar mörk choklad men ogillar nötter, och du vill ge dem något av kvalitet. Med scenutforskning kommer du att kunna skanna hela hyllan med telefonens kamera och se användbara insikter framför dig. Scenutforskning är ett kraftfullt genombrott i våra enheters förmåga att förstå världen som vi gör – så att du enkelt kan hitta det du letar efter – och vi ser fram emot att ta det till multisökning i framtiden.”

Med dessa nya funktioner som kan förbättra multisökningsförmågan hos Google Lens kan Google ytterligare öka syftet med bildigenkänningstekniken och göra den mer praktisk för dagligt bruk. För närvarande noterar Raghavan att Google Lens-användare gör sökningar mer än 8 miljarder gånger per månad. Men med de nya förbättringarna som kommer kan siffrorna öka dramatiskt, med tekniken som får mer erkännande från allmänheten.