Bing kan snart ha möjlighet att använda bilder, videor och andra datatyper som svar

3 min. läsa

Publicerad den

Läs vår informationssida för att ta reda på hur du kan hjälpa MSPoweruser upprätthålla redaktionen Läs mer

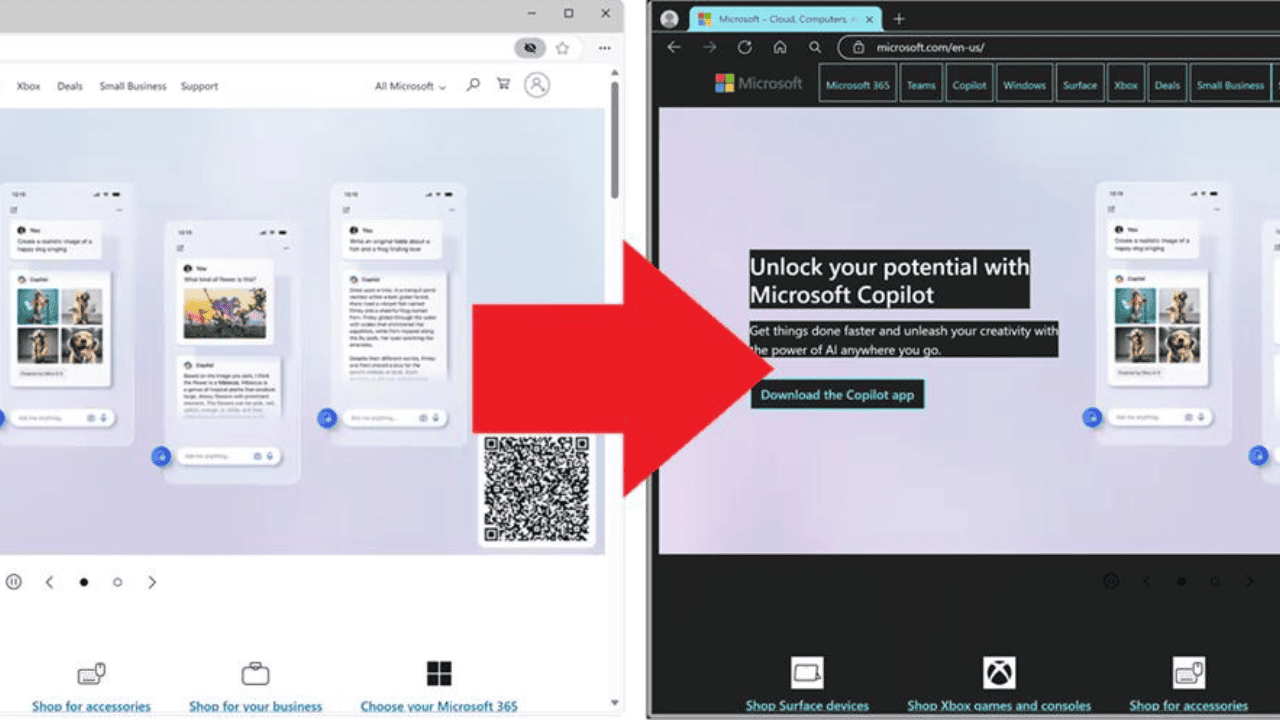

Smakämnen nya ChatGPT-drivna Bing förbättras kontinuerligt och Microsoft kan komma att påbörja sin största utveckling nästa vecka. Andreas Braun, Microsoft Germany CTO, meddelade nyligen att GPT-4 kommer nästa vecka. Vid sidan av detta antydde chefen "multimodala modeller som kommer att erbjuda helt andra möjligheter."

Microsoft har redan investerat miljarder dollar i sina AI-initiativ, särskilt i att obevekligt förbättra Bing för att bättre kunna konkurrera med Google. Nu bekräftade mjukvarujätten ankomsten av GPT-4 nästa vecka, som förväntas injiceras i dess sökmotor och chatbot.

Före lanseringen av ChatGPT Bing fanns det rykten om Bing med GPT-4. Microsoft har dock istället använt GPT-3.5-modellen vid sidan av sin egenutvecklade teknik Prometheus, vilket gör att Bing kan generera uppdaterad data. Överraskande nog, även om nya Bing fortfarande inte är tillgänglig för alla, har företaget redan planer på att ge sökmotorn ett betydande uppsving via den kommande GPT-4.

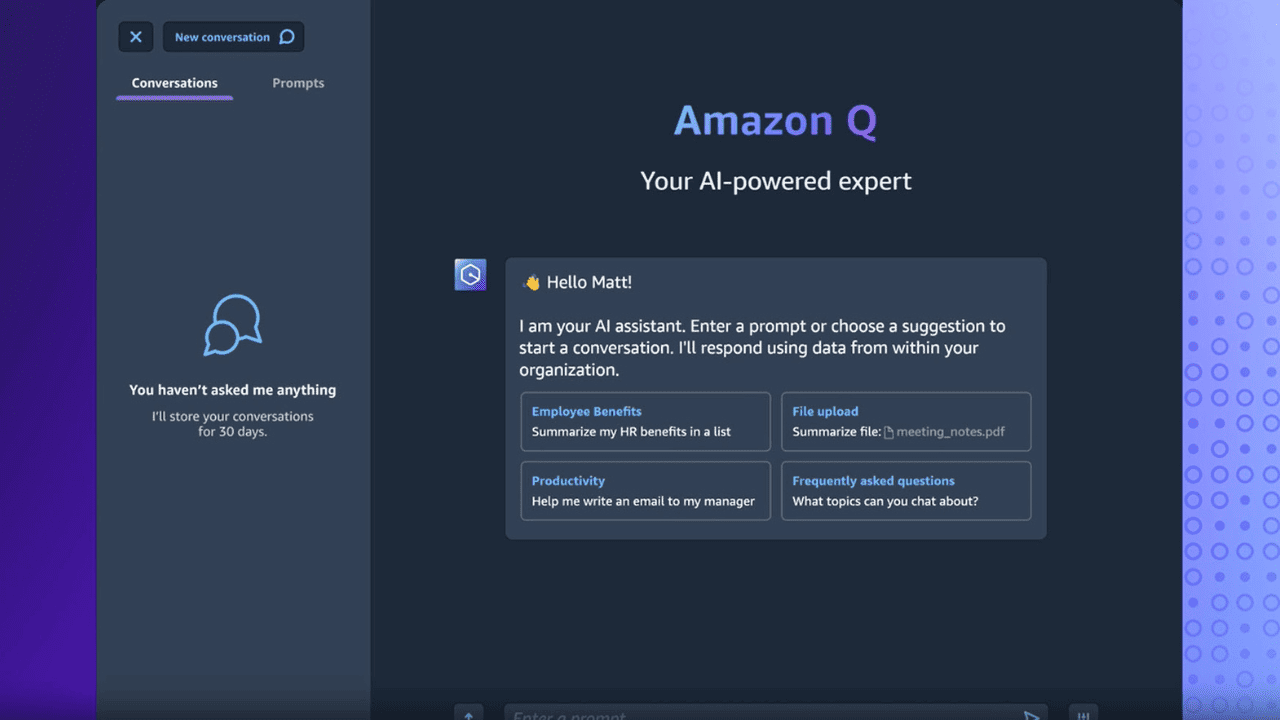

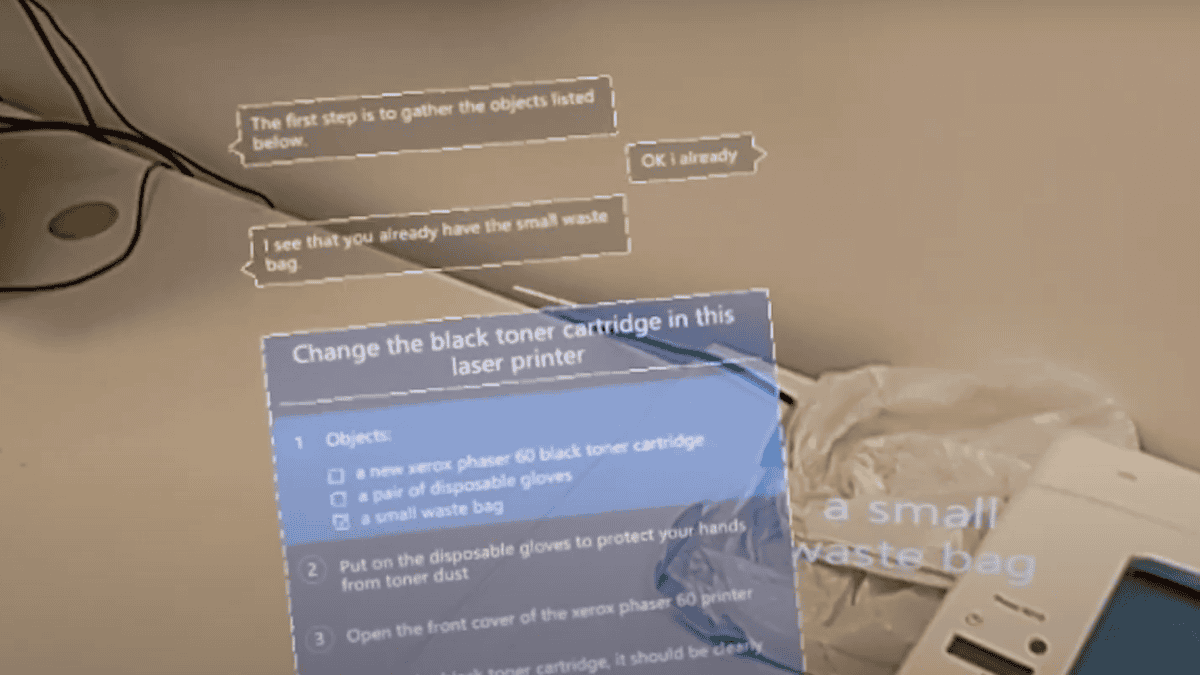

OpenAI:s nya och kommande stora språkmodell förväntas tillåta Bing chatbot att generera snabbare resultat, vilket kan vara till stor hjälp eftersom den nuvarande versionen vanligtvis tar några sekunder att börja generera svar. Icke desto mindre, bortsett från hastighet, kan en multimodal kapacitet vara det största som den nya LLM-introduktionen kan ge.

På Microsofts AI in Focus – Digital Kickoff-event delade Braun med sig av några detaljer om vad man kan förvänta sig av en ny LLM. (via Heise)

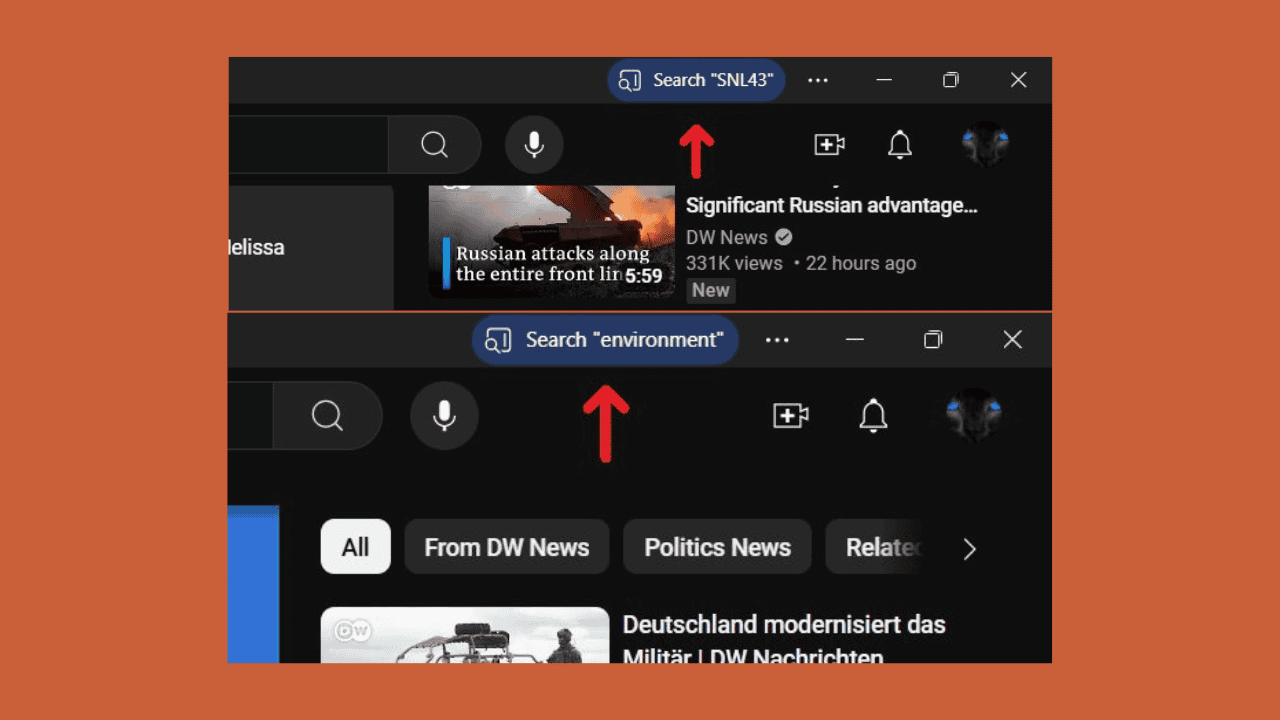

"Vi kommer att introducera GPT-4 nästa vecka, där kommer vi att ha multimodala modeller som kommer att erbjuda helt andra möjligheter - till exempel videor", säger Braun, som beskrev LLM som en "game changer."

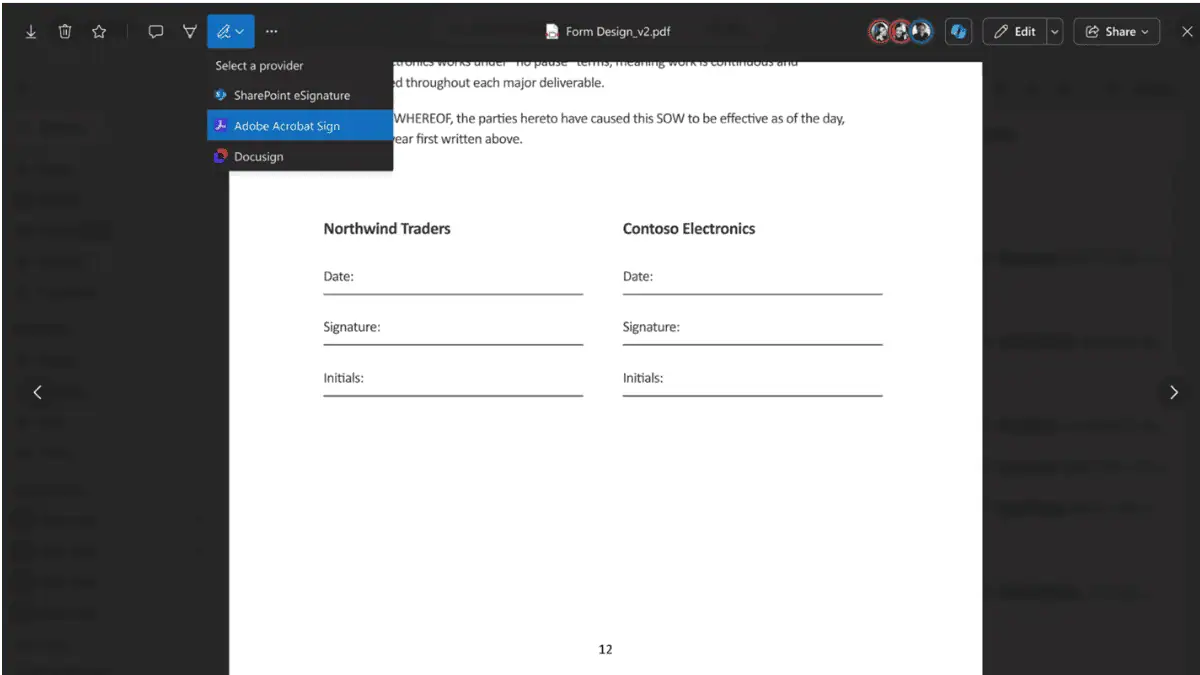

Dessutom bekräftade Braun att Microsoft har planer på att "göra modellerna heltäckande" med hjälp av multimodalitetskapaciteten. När det väl har injicerats bör detta tillåta Bing att tillhandahålla en mängd olika data när de svarar på frågor, vilket innebär att den också kan bearbeta videor, bilder och andra datatyper. Detta bör resultera i bättre svar, vilket gör Bing till en mer effektiv sökassistent för alla.

Å andra sidan är det viktigt att notera att Bing inte är först inom multimodalitet. Nyligen, du.com rullade ut sin multimodala chattsökningsfunktion, så att användare kan tillhandahålla text- och röstinmatningar och ta emot svar utöver konversationstexter. Sökmotorn kämpar dock fortfarande för att få uppmärksamhet från allmänheten. Samtidigt, trots att det ännu inte är fullt tillgängligt för alla, har Bing redan en ständigt växande väntelista. Injiceringen av en multimodal kapacitet i den kommer säkerligen att påverka dess rivaler, såsom You.com. Ändå är det fortfarande tidigt att säga hur stor denna effekt kommer att bli eftersom Brauns tillkännagivande bara bekräftar mycket få detaljer.