Microsoft Orca-Math je majhen jezikovni model, ki lahko prekaša GPT-3.5 in Gemini Pro pri reševanju matematičnih problemov

2 min. prebrati

Objavljeno dne

Preberite našo stran za razkritje, če želite izvedeti, kako lahko pomagate MSPoweruser vzdrževati uredniško skupino Preberi več

Ključne opombe

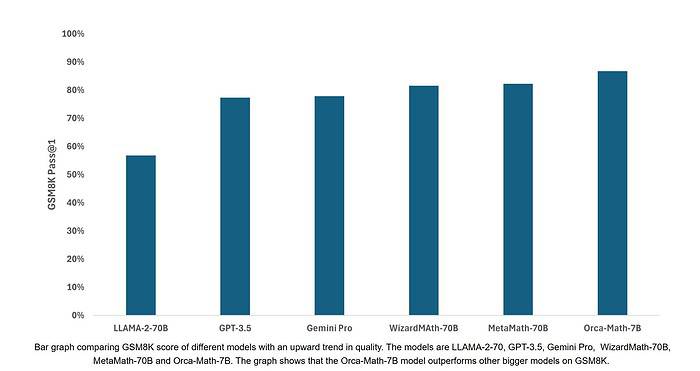

- Glede na merila uspešnosti je Orca-Math dosegel 86.81 % na GSM8k pass@1.

- Ta številka premaga Metin LLAMA-2-70, Googlov Gemini Pro, OpenAI GPT-3.5 in celo modele, specifične za matematiko, kot sta MetaMath-70B in WizardMa8th-70B.

Microsoft Research danes razglasitve Orca-Math, majhen jezikovni model (SLM), ki lahko pri reševanju matematičnih problemov prekaša veliko večje modele, kot sta Gemini Pro in GPT-3.5. Orca-Math ponazarja, kako se lahko specializirani SLM odlikujejo na določenih področjih in celo prekašajo večje modele. Pomembno je omeniti, da ta model ni bil ustvarjen iz nič s strani Microsofta, namesto tega je bil ta model ustvarjen s fino nastavitvijo modela Mistral 7B.

Glede na merila uspešnosti je Orca-Math dosegel 86.81 % na GSM8k pass@1. Ta številka premaga Metin LLAMA-2-70, Googlov Gemini Pro, OpenAI GPT-3.5 in celo modele, specifične za matematiko, kot sta MetaMath-70B in WizardMa8th-70B. Pomembno je omeniti, da je osnovni model Mistral-7B, na podlagi katerega je bila zgrajena Orca-Math, dosegel le 37.83% na GSM8K.

Microsoft Research je uspel doseči to impresivno zmogljivost z upoštevanjem spodnjih tehnik:

- Visokokakovostni sintetični podatki: Orca-Math je bil usposobljen na naboru podatkov 200,000 matematičnih nalog, natančno izdelan z uporabo več agentov (AutoGen). Čeprav je ta nabor podatkov manjši od nekaterih drugih naborov matematičnih podatkov, je omogočil hitrejše in stroškovno učinkovitejše usposabljanje.

- Iterativni učni proces: Poleg tradicionalne nadzorovane natančne nastavitve je bil Orca-Math podvržen ponavljajočemu se procesu učenja. Vadil je reševanje problemov in se nenehno izboljševal na podlagi povratnih informacij iz signala »učitelja«.

»Naše ugotovitve kažejo, da so manjši modeli dragoceni v specializiranih nastavitvah, kjer se lahko kosajo z zmogljivostjo veliko večjih modelov, vendar z omejenim obsegom. Z usposabljanjem Orca-Math na majhnem naboru podatkov 200,000 matematičnih problemov smo dosegli ravni zmogljivosti, ki tekmujejo ali presegajo tiste veliko večjih modelov,« je zapisala skupina Microsoft Research.