Microsoft Azure AI odhaľuje „Prompt Shields“ na boj proti manipulácii LLM

2 min. čítať

Publikované dňa

Prečítajte si našu informačnú stránku a zistite, ako môžete pomôcť MSPoweruser udržať redakčný tím Čítaj viac

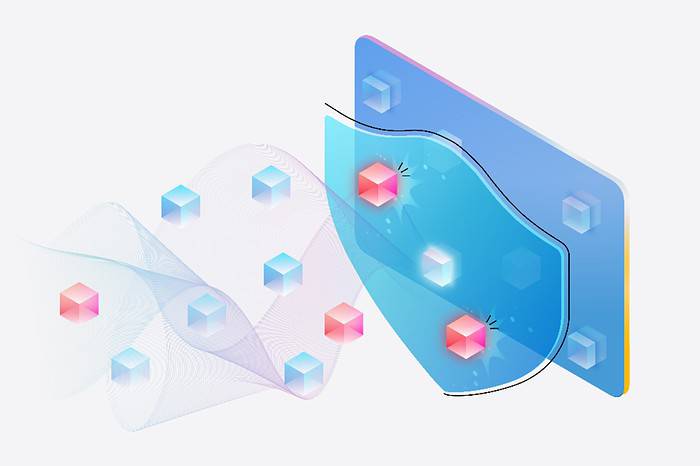

Microsoft dnes oznámila, významné vylepšenie zabezpečenia pre platformy Azure OpenAI Service a Azure AI Content Safety. Nová funkcia s názvom „Prompt Shields“ ponúka robustnú obranu proti čoraz sofistikovanejším útokom zameraným na veľké jazykové modely (LLM).

Prompt Shields chráni pred:

- Priame útoky: Tieto pokusy, známe tiež ako útoky na útek z väzenia, výslovne inštruujú LLM, aby ignorovala bezpečnostné protokoly alebo vykonala škodlivé akcie.

- Nepriame útoky: Tieto útoky nenápadne vkladajú škodlivé pokyny do zdanlivo normálneho textu s cieľom oklamať LLM do nežiaduceho správania.

Prompt Shields je integrovaný s filtrami obsahu služby Azure OpenAI a je dostupný v Azure AI Content Safety. Vďaka pokročilým algoritmom strojového učenia a spracovaniu prirodzeného jazyka dokáže Prompt Shields identifikovať a neutralizovať potenciálne hrozby v používateľských výzvach a údajoch tretích strán.

Spotlighting: Nová obranná technika

Spoločnosť Microsoft tiež predstavila „Spotlighting“, čo je špecializovaný rýchly inžiniersky prístup, ktorý má zabrániť nepriamym útokom. Techniky bodového osvetlenia, ako je vymedzovanie a označovanie údajov, pomáhajú LLM jasne rozlišovať medzi legitímnymi pokynmi a potenciálne škodlivými zabudovanými príkazmi.

Dostupnosť

Prompt Shields je momentálne vo verejnej ukážke ako súčasť Azure AI Content Safety a bude k dispozícii v rámci služby Azure OpenAI od 1. apríla. V blízkej budúcnosti sa plánuje integrácia do Azure AI Studio.