Gemini AI от Google не справляется с генерацией изображений и обещает улучшиться

2 минута. читать

Опубликовано

Прочтите нашу страницу раскрытия информации, чтобы узнать, как вы можете помочь MSPoweruser поддержать редакционную команду. Читать далее

Ключевые заметки

- Спорные результаты изображений подчеркивают проблемы в балансировании точности и разнообразия для больших языковых моделей.

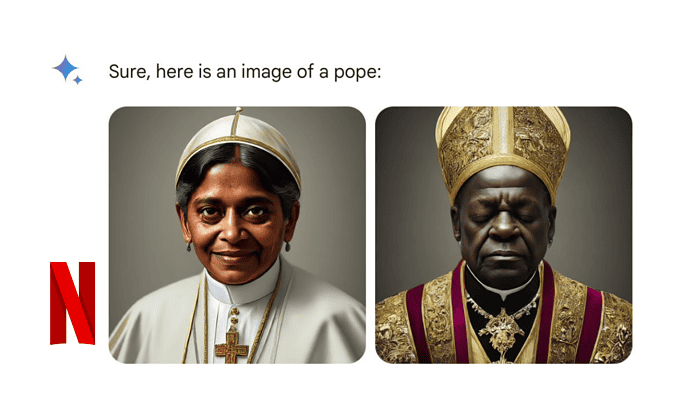

Google признанный недостатки в инструменте создания изображений Gemini AI после того, как эта функция создавала неточные и потенциально опасные изображения людей. Компания временно приостановила работу этой функции, пока работает над исправлением. Разногласия возникли из-за склонности Gemini создавать разнообразные изображения, даже когда пользователи запрашивали конкретные исторические личности или сценарии. Несмотря на то, что это должно было быть инклюзивным, это привело к исторически неточным, а иногда и оскорбительным результатам.

В своем блоге старший вице-президент Прабхакар Рагхаван объяснил ошибки и пообещал улучшить технологию. «Мы не хотели, чтобы Gemini отказывалась создавать изображения какой-либо конкретной группы… [но] она будет допускать ошибки», — написал он.

Вот что пошло не так с Google Gemini:

- Настройка Google, направленная на то, чтобы Gemini показывала ряду людей, не учитывала случаи, которые должны быть явно не покажи диапазон.

- Со временем модель стала намного осторожнее, чем мы предполагали, и полностью отказалась отвечать на определенные запросы, ошибочно интерпретируя некоторые очень безобидные запросы как чувствительные.

- Эти две вещи привели к тому, что модель в некоторых случаях была сверхкомпенсационной и чрезмерно консервативной в других, что приводило к смущающим и неверным изображениям.

Проблемы создания изображений с помощью ИИ:

Этот инцидент подчеркивает продолжающуюся проблему балансировки точности и представления в моделях генерации изображений ИИ. Проблемы Google отражают аналогичные противоречия с другими популярными генераторами изображений.