Free Software Foundation consideră că GitHub Copilot ar trebui să fie ilegal

3 min. citit

Actualizat pe

Citiți pagina noastră de dezvăluire pentru a afla cum puteți ajuta MSPoweruser să susțină echipa editorială Află mai multe

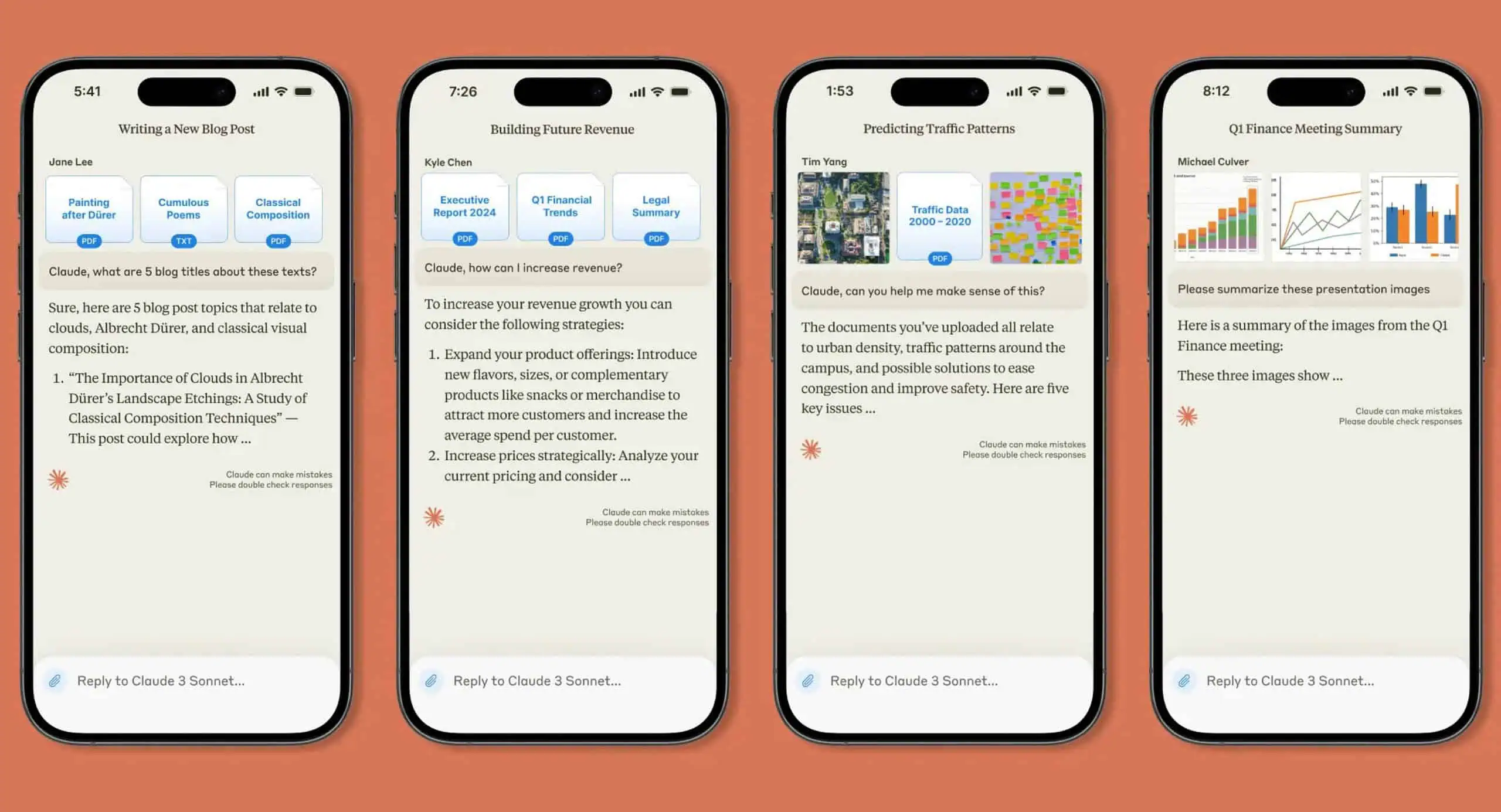

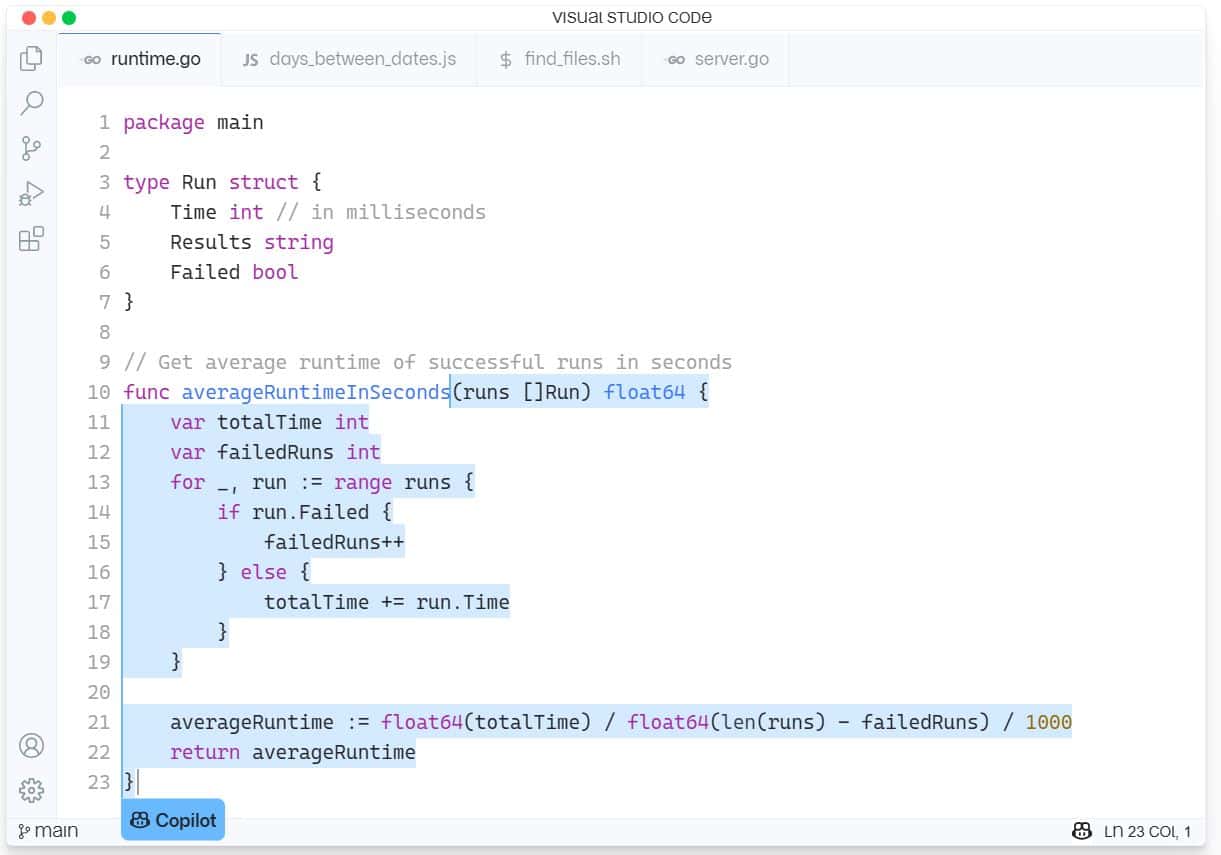

GitHub Copilot este un nou serviciu de asistență AI pentru dezvoltarea de software încorporat în Visual Studio Code al Microsoft. GitHub Copilot acceptă o varietate de limbi și cadre și ușurează viața dezvoltatorilor, oferind sugestii pentru linii întregi sau funcții întregi chiar în interiorul IDE. GitHub Copilot este alimentat de OpenAI Codex și a fost antrenat pe miliarde de linii de cod open-source.

Ultima problemă a făcut ca Free Software Foundation (FSF) să aibă o albină uriașă în capotă, numind instrumentul „inacceptabil și nedrept, din perspectiva noastră”.

Avocatul software-ului open-source se plânge că Copilot necesită software cu sursă închisă, cum ar fi Visual Studio IDE de la Microsoft sau editorul Visual Studio Code, pentru a rula și că acesta constituie un „serviciu ca înlocuitor de software”, ceea ce înseamnă că este o modalitate de a câștiga putere asupra calculatoarelor altor persoane.

FSF a considerat că există numeroase probleme cu Copilot, care mai trebuiau testate în instanță.

„Dezvoltatorii doresc să știe dacă antrenarea unei rețele neuronale cu ajutorul software-ului lor poate fi considerată drept utilizare. Alții care ar dori să folosească Copilot se întreabă dacă fragmentele de cod și alte elemente copiate din depozitele găzduite de GitHub ar putea duce la încălcarea drepturilor de autor. Și chiar dacă totul ar putea fi copacetic din punct de vedere legal, activiștii se întreabă dacă nu există ceva fundamental nedrept în ceea ce privește o companie de software proprietar care își construiește un serviciu din munca lor”, a scris FSF.

Ajutorul pentru a răspunde la aceste întrebări, FSF a solicitat cărți albe care examinează următoarele probleme:

- Formarea Copilot privind depozitele publice este încălcarea drepturilor de autor? Utilizare potrivita?

- Cât de probabil este rezultatul Copilot să genereze revendicări recurabile de încălcare a lucrărilor licențiate GPL?

- Pot dezvoltatorii care folosesc Copilot să se conformeze licențelor software libere precum GPL?

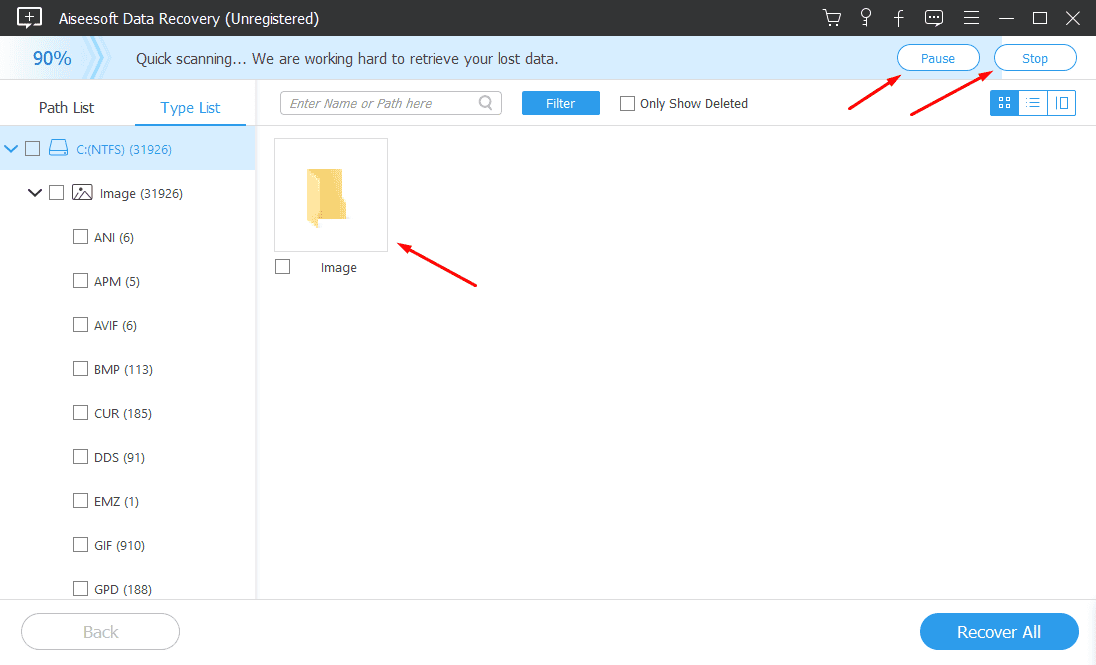

- Cum pot dezvoltatorii să se asigure că codul asupra căruia dețin drepturile de autor este protejat împotriva încălcărilor generate de Copilot?

- Dacă Copilot generează cod care dă naștere la încălcarea unei lucrări cu licență de software liber, cum poate fi descoperită această încălcare de către deținătorul drepturilor de autor?

- Un model AI/ML instruit este protejat prin drepturi de autor? Cine deține drepturile de autor?

- Ar trebui organizații precum FSF să susțină schimbarea legii dreptului de autor relevantă pentru aceste întrebări?

FSF va plăti 500 USD pentru cărțile albe publicate și poate elibera mai multe fonduri dacă sunt necesare cercetări suplimentare.

Cei care doresc să facă o depunere o pot trimite la [e-mail protejat] înainte de 21 august. Citiți mai multe despre proces pe FSF.org aici.

Microsoft a răspuns provocării viitoare spunând: „Acesta este un spațiu nou și suntem dornici să ne angajăm într-o discuție cu dezvoltatorii pe aceste subiecte și să conducem industria în stabilirea standardelor adecvate pentru antrenarea modelelor AI”.

Având în vedere că Copilot fură uneori funcții întregi din alte aplicații Open Source, cititorii noștri sunt de acord cu FSF sau FSF este ipocrit pur și simplu pentru că este mai degrabă un AI decât un cod uman de reutilizare? Spune-ne părerea ta în comentariile de mai jos.

de infoworld