Samsung ordonă interzicerea generativă a AI angajaților din cauza problemelor de securitate

3 min. citit

Publicat în data de

Citiți pagina noastră de dezvăluire pentru a afla cum puteți ajuta MSPoweruser să susțină echipa editorială Află mai multe

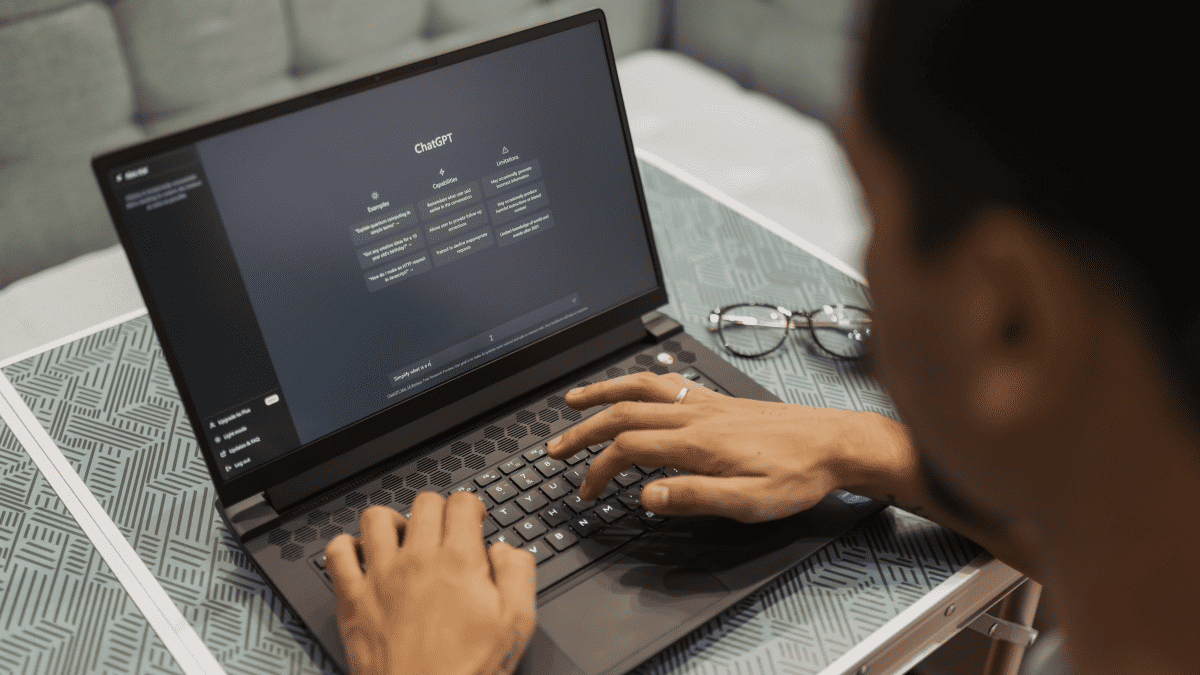

Samsung nu vrea ca personalul său să aibă încredere completă în IA generativă, cum ar fi Chat GPT când vine vorba de informațiile sensibile ale companiei. Ca atare, compania sud-coreeană interzice acum utilizarea serviciilor AI generative în cadrul forței de muncă.

„Vă rugăm să respectați cu sârguință ghidul nostru de securitate, iar nerespectarea acestui lucru poate duce la o încălcare sau compromitere a informațiilor companiei, care duce la acțiuni disciplinare până la și inclusiv desființarea angajării”, a spus Samsung într-un memoriu revizuit de către Bloomberg News.

Potrivit raportului, compania a efectuat un sondaj în aprilie, arătând că 65% dintre respondenți credeau că utilizarea instrumentelor AI la locul de muncă s-ar putea traduce în posibile probleme de securitate. În mod interesant, Samsung a descoperit și luna trecută că unii dintre inginerii săi au scurs „în mod accidental” cod sursă intern atunci când l-au încărcat pe ChatGPT în aprilie.

Raportul a spus că Samsung a lansat notul subliniind preocupările de securitate. Se teme că informațiile confidențiale transmise instrumentelor AI sunt stocate pe servere externe, ceea ce este în afara controlului Samsung și ar putea duce la scurgeri publice.

Nota a avertizat personalul dintr-o anumită divizie cu privire la utilizarea instrumentelor AI generative și i-a încurajat să urmeze politicile companiei, subliniind că cei care refuză să facă acest lucru ar putea fi pedepsiți. În ciuda avertismentului, Samsung a notat în memoriul adresat personalului că va fi temporar, împărtășind intențiile de a „crea un mediu sigur” pentru utilizarea tehnologiei precum ChatGPT.

„HQ revizuiește măsurile de securitate pentru a crea un mediu sigur pentru utilizarea în siguranță a AI generativă pentru a spori productivitatea și eficiența angajaților”, se arată în nota. „Cu toate acestea, până când aceste măsuri sunt pregătite, restricționăm temporar utilizarea IA generativă.”

Samsung s-a alăturat altor companii (de exemplu, JPMorgan Chase & Co., Bank of America Corp. și Citigroup Inc.) care au interzis deja utilizarea AI generativă în locurile lor din cauza acelorași preocupări. Cu toate acestea, mutarea unor astfel de companii nu este o surpriză - mai ales după o eroare recentă ChatGPT care a expus temporar istoricul chatului și, eventual, informațiile de plată. Și având în vedere că OpenAI ar putea accesa informațiile furnizate pentru crearea sa ChatGPT, companiile au tot dreptul să se teamă de utilizarea de către angajații lor a unui astfel de instrument AI.

În ciuda acestui fapt, OpenAI a fost întotdeauna vocal în avertizarea utilizatorilor săi să nu partajeze „orice informație sensibilă”. La fel de a explicat de către OpenAI însuși, „poate folosi Conținutul pe care ni-l furnizați pentru a ne îmbunătăți Serviciile, de exemplu pentru a instrui modelele care alimentează ChatGPT”. Este important să rețineți, totuși, că ChatGPT are deja o funcție de mod incognito. Cu toate acestea, s-ar putea să nu fie încă o asigurare suficientă pentru companii, mai ales că o simplă problemă de securitate ar putea însemna un dezastru imens în afaceri.