Ta av Copilot Designer fra nettet: en Microsoft-ingeniør etter å ha avslørt det kan produsere ekstremt upassende innhold

2 min. lese

Publisert på

Les vår avsløringsside for å finne ut hvordan du kan hjelpe MSPoweruser opprettholde redaksjonen Les mer

Viktige merknader

- Microsoft-ingeniøren flagger AI-bildegenerator Copilot Designer for å produsere skadelig innhold som voldelige bilder og brudd på opphavsrett.

- Ingeniøren oppfordrer Microsoft til å fjerne verktøyet, legge til advarsler og endre aldersgrensen på grunn av sikkerhetshensyn.

- Hendelsen belyser bredere spørsmål om potensielt misbruk og etiske hensyn rundt generativ AI-teknologi.

En Microsoft-ingeniør har reist bekymringer om selskapets AI-bildegenerator, Copilot Designer. Han hevder det kan produsere skadelig og upassende innhold.

Shane Jones, som er ledende programvareingeniør hos Microsoft, sa at han oppdaget at verktøyet kan generere voldelige, seksuelle og partiske bilder. Det minner meg om Taylor Swift-sagaen, som ble sagt å være gjort av et Microsoft-produkt.

Han rapporterte funnene sine internt, men var ikke fornøyd med svaret, noe som gjorde at han offentliggjorde sakene sine.

Jones, som identifiserte sårbarheter gjennom "red-teaming" (testing for svakheter), rapporterte å møte forstyrrende bilder, inkludert:

- Bilder som viser demoner og monstre sammen med termer relatert til abortrettigheter.

- Bilder av kvinner i seksualiserte scenarier midt i bilulykker.

- Bilder som viser tenåringer på fester med narkotika og våpen.

- Bilder som viser Disney-karakterer i potensielt opphavsrettsbeskyttede og støtende situasjoner, inkludert scener som skildrer vold i Midtøsten og karakterer knyttet til militære bilder.

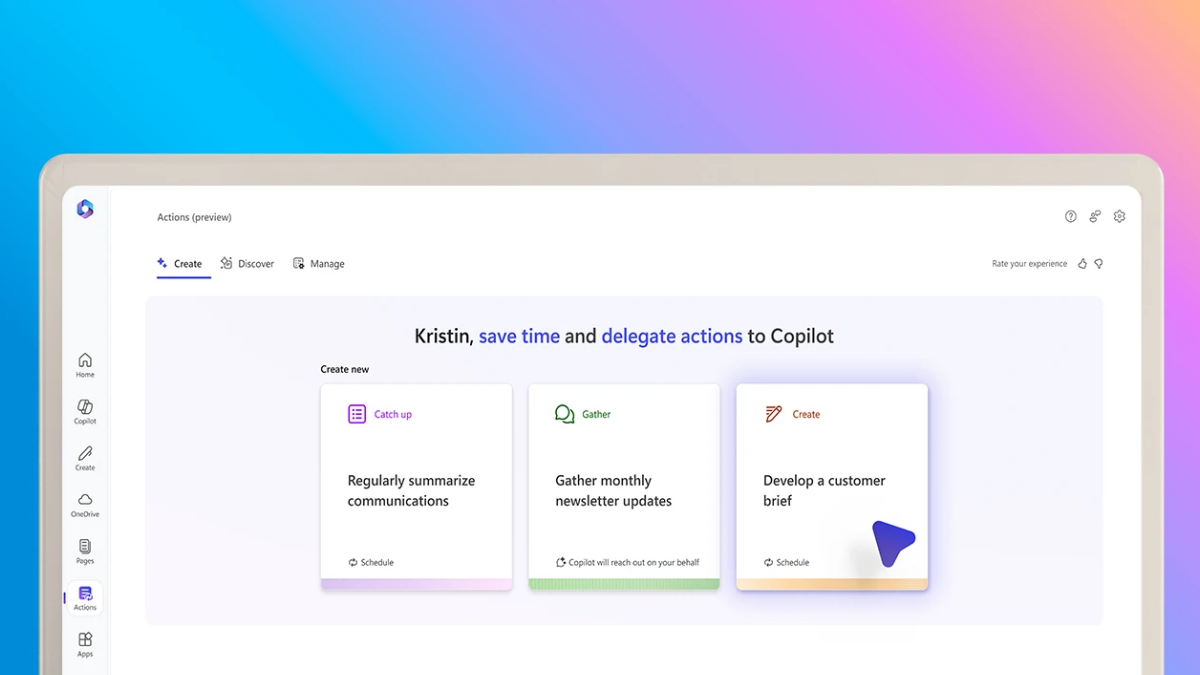

Jones ber Microsoft om å ta noen umiddelbare tiltak, som inkluderer et stort skritt med å fjerne Copilot Designer fra markedet inntil sikkerhetstiltak er implementert. Han la til avsløringer om verktøyets begrensninger og endret appvurderingen for å gjenspeile at den ikke passer for alle aldre. Eller hvem som helst.

Microsoft har ennå ikke svart på alle Jones sine spesifikke påstander. En talsperson sa imidlertid at selskapet er forpliktet til å ta opp eventuelle bekymringer ansatte har og setter pris på deres innsats for å teste teknologien.

Når det gjelder sikkerhetsomgåelser eller bekymringer som kan ha en potensiell innvirkning på tjenestene våre eller partnerne våre, har vi etablert robuste interne rapporteringskanaler for å undersøke og rette opp eventuelle problemer, som vi oppfordrer ansatte til å bruke slik at vi kan validere og teste deres bekymringer.

Bekymringene om generativ AI og potensialet for misbruk vokser, til og med Geminis bildeskaper laget våknebilder nylig, som fikk Google til å slå av produksjonen av menneskelige bilder en stund.

Dette er en utviklingshistorie, og vi vil fortsette å gi oppdateringer etter hvert som de blir tilgjengelige.

Mer her..

Brukerforum

0 meldinger