Microsoft og NVIDIA kunngjør den største og kraftigste språkmodellen som er trent til dags dato

1 min. lese

Publisert på

Les vår avsløringsside for å finne ut hvordan du kan hjelpe MSPoweruser opprettholde redaksjonen Les mer

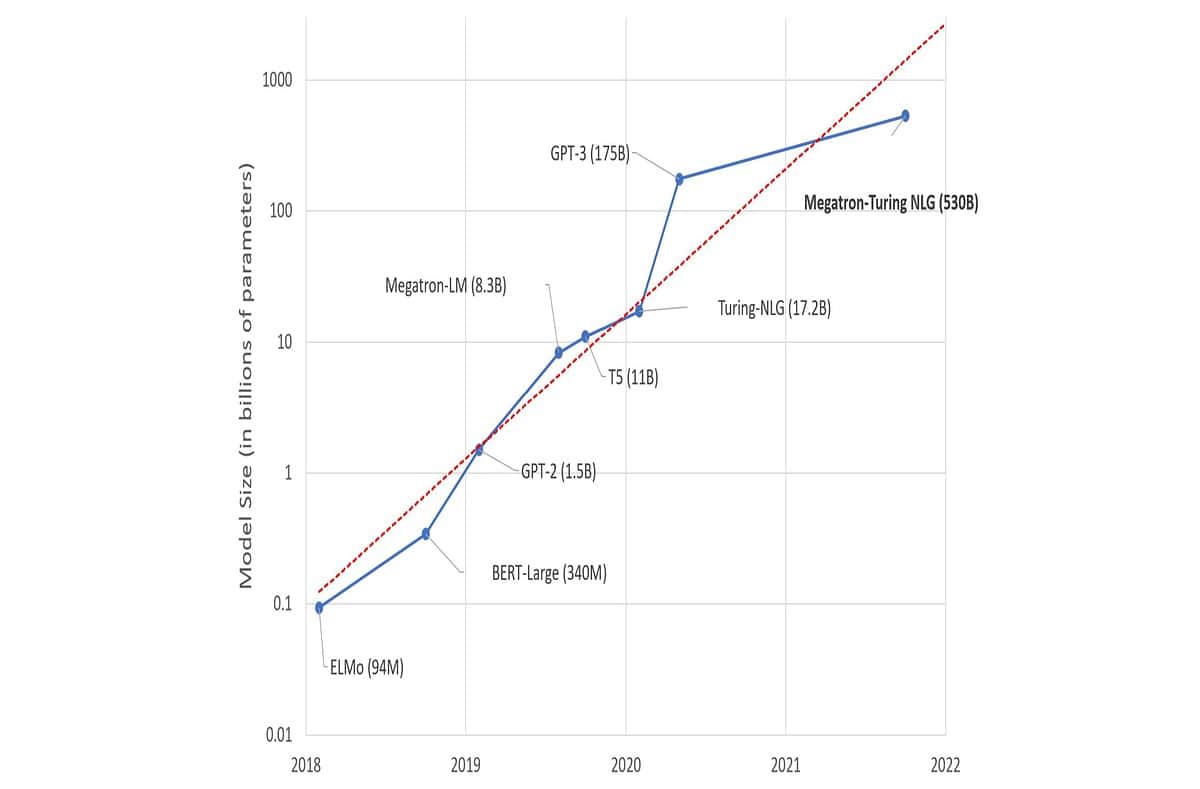

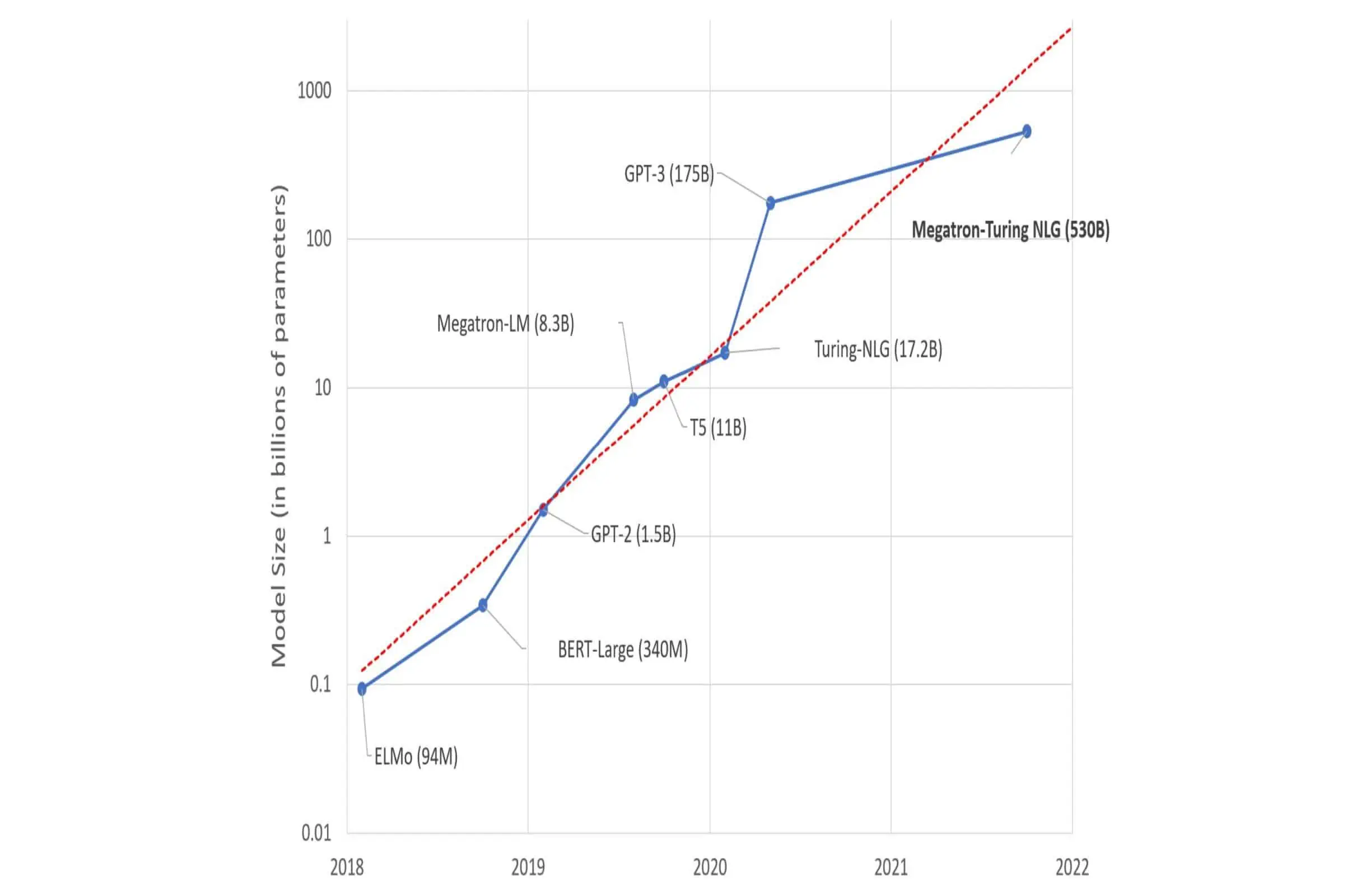

Microsoft og NVIDIA kunngjorde i dag den DeepSpeed- og Megatron-drevne Megatron-Turing Natural Language Generation-modellen (MT-NLG), den største og kraftigste monolitiske transformatorspråkmodellen som er trent til dags dato. Denne modellen inkluderer 530 milliarder parametere, 3 ganger antall parametere sammenlignet med den eksisterende største modellen, GPT-3. Trening av en så stor modell innebærer ulike utfordringer. NVIDIA og Microsoft jobbet med mange innovasjoner og gjennombrudd langs alle AI-akser.

For eksempel, i tett samarbeid, oppnådde NVIDIA og Microsoft en enestående treningseffektivitet ved å konvergere en toppmoderne GPU-akselerert treningsinfrastruktur med en banebrytende distribuert læringsprogramvarestabel. Vi bygde høykvalitets, naturlig språkopplæringskorpora med hundrevis av milliarder av tokens, og samutviklede treningsoppskrifter for å forbedre optimaliseringseffektiviteten og stabiliteten.

Du kan lære mer om dette prosjektet fra lenkene nedenfor.