Microsoft의 Phi-2 2.7B 모델은 최근 발표된 Google Gemini Nano-2 3.2B 모델보다 성능이 뛰어납니다.

2 분. 읽다

에 게시됨

공개 페이지를 읽고 MSPoweruser가 편집팀을 유지하는 데 어떻게 도움을 줄 수 있는지 알아보세요. 자세히 보기

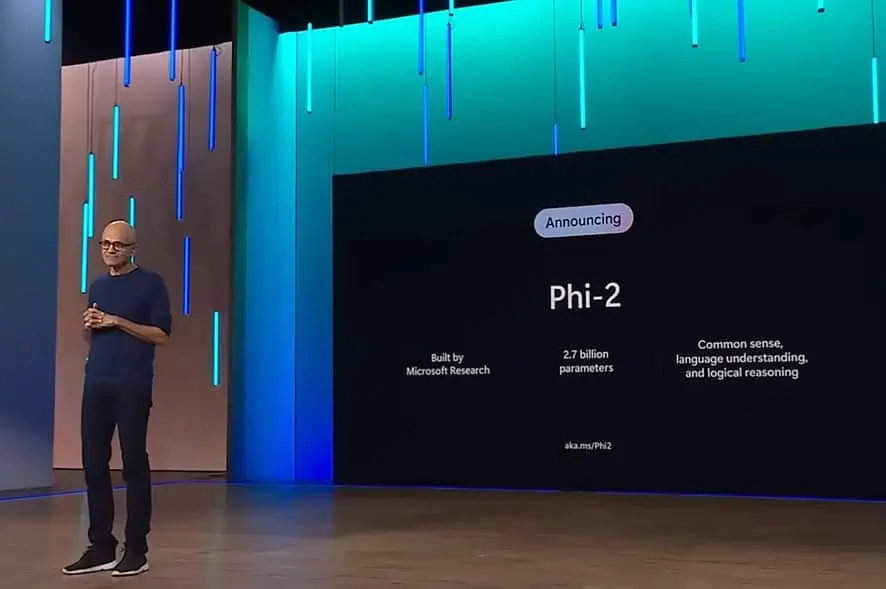

지난 몇 달 동안 Microsoft Research는 "Phi"라는 소규모 언어 모델(SLM) 제품군을 출시했습니다. Phi-1은 1.3억 개의 매개변수로 처음 출시되었으며 기본 Python 코딩에 특화되었습니다. 지난 XNUMX월 마이크로소프트 리서치 출시 1.5억 개의 매개변수가 있는 Phi-1.3 모델이지만 다양한 NLP 합성 텍스트가 포함된 새로운 데이터 소스로 훈련되었습니다. 작은 크기에도 불구하고 phi-1.5는 비슷한 크기의 다른 모델과 비교할 때 거의 최첨단 성능을 제공했습니다.

오늘 Microsoft는 2억 개의 매개변수를 갖춘 Phi-2.7 모델의 출시를 발표했습니다. Microsoft Research에서는 이 새로운 SLM이 13억 개 미만의 매개변수를 사용하는 기본 언어 모델 중에서 최첨단 성능을 제공한다고 주장합니다. 일부 복잡한 벤치마크에서 Phi-2는 최대 25배 더 큰 모델과 일치하거나 성능이 뛰어납니다.

지난주 구글 발표 Gemini 언어 모델 제품군. Gemini Nano는 기기 내 작업을 위해 제작된 Google의 가장 효율적인 모델이며 모바일 실리콘에서 직접 실행할 수 있습니다. Gemini Nano와 유사한 소규모 언어 모델은 텍스트 요약, 상황별 스마트 답장, 고급 교정 및 문법 교정과 같은 기능을 지원합니다.

Microsoft에 따르면 새로운 Phi-2 모델은 크기가 더 작음에도 불구하고 새로운 Google Gemini Nano-2와 일치하거나 성능이 뛰어납니다. 아래에서 Google Gemini Nano-2와 Phi-2 모델 간의 벤치마크 비교를 확인할 수 있습니다.

| 모델 | 크기 | BBH | 부울Q | MBPP | MMLU |

|---|---|---|---|---|---|

| 제미니 나노 2 | 3.2B | 42.4 | 79.3 | 27.2 | 55.8 |

| 파이-2 | 2.7B | 59.3 | 83.3 | 59.1 | 56.7 |

Gemini Nano-2보다 성능이 뛰어난 것 외에도 Phi-2는 다양한 벤치마크에서 2B 및 7B 매개변수에서 Mistral 및 Llama-13 모델의 성능을 능가합니다. 아래에서 세부정보를 찾아보세요.

| 모델 | 크기 | BBH | 상식 추리 | 지원하는 언어 이해 | 연산 | 코딩 |

|---|---|---|---|---|---|---|

| 라마-2 | 7B | 40.0 | 62.2 | 56.7 | 16.5 | 21.0 |

| 13B | 47.8 | 65.0 | 61.9 | 34.2 | 25.4 | |

| 70B | 66.5 | 69.2 | 67.6 | 64.1 | 38.3 | |

| 한랭 한 북서풍 | 7B | 57.2 | 66.4 | 63.7 | 46.4 | 39.4 |

| 파이-2 | 2.7B | 59.2 | 68.8 | 62.0 | 61.1 | 53.7 |

이전 두 phi 모델은 Hugging Face에서 사용할 수 있었지만, 피-2 Azure 모델 카탈로그에서 사용할 수 있게 되었습니다. Phi-2에 대해 자세히 알아볼 수 있습니다. 여기에서 지금 확인해 보세요..