Microsoft Research, 대규모 언어 모델의 GPU 효율성을 높이는 새로운 기술인 Splitwise 출시

2 분. 읽다

에 게시됨

공개 페이지를 읽고 MSPoweruser가 편집팀을 유지하는 데 어떻게 도움을 줄 수 있는지 알아보세요. 자세히 보기

주요 사항

- Splitwise는 LLM 추론 효율성과 지속 가능성의 획기적인 발전입니다.

- 프롬프트 단계와 토큰 단계를 분리함으로써 Splitwise는 GPU 사용의 새로운 잠재력을 발휘하고 클라우드 공급자가 동일한 전력 예산으로 더 많은 쿼리를 더 빠르게 처리할 수 있도록 합니다.

LLM(대형 언어 모델)은 자연어 처리 및 인공 지능 분야를 변화시켜 코드 생성, 대화 에이전트 및 텍스트 요약과 같은 애플리케이션을 지원합니다. 그러나 이러한 모델은 증가하는 LLM 추론 수요를 충족하기 위해 점점 더 많은 그래픽 처리 장치(GPU)를 배포해야 하는 클라우드 제공업체에게 심각한 과제를 제기하기도 합니다.

문제는 GPU가 비쌀 뿐만 아니라 전력도 많이 소모하고 이를 실행하는 데 필요한 전력을 공급할 수 있는 용량도 제한적이라는 점입니다. 결과적으로 클라우드 제공업체는 사용자 쿼리를 거부하거나 운영 비용 및 환경에 미치는 영향을 증가시키는 딜레마에 직면하는 경우가 많습니다.

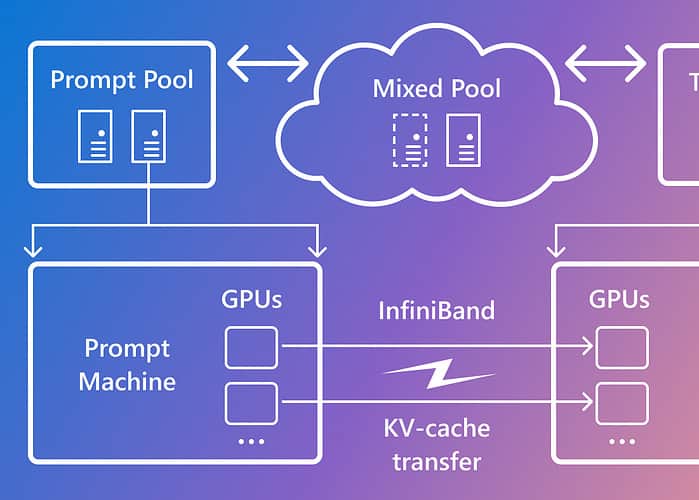

이 문제를 해결하기 위해 Microsoft Azure의 연구원들은 다음과 같은 새로운 기술을 개발했습니다. Splitwise이는 계산을 두 개의 개별 단계로 분할하고 이를 다른 시스템에 할당하여 LLM 추론을 보다 효율적이고 지속 가능하게 만드는 것을 목표로 합니다. 이 기술에 대한 자세한 내용은 "분할 방식: 위상 분할을 사용한 효율적인 생성적 LLM 추론" 연구 논문.

Splitwise는 LLM 추론이 프롬프트 단계와 토큰 생성 단계라는 서로 다른 특성을 가진 두 단계로 구성된다는 관찰을 기반으로 합니다. 프롬프트 단계에서 모델은 많은 GPU 컴퓨팅을 사용하여 사용자 입력 또는 프롬프트를 병렬로 처리합니다. 토큰 생성 단계에서 모델은 많은 GPU 메모리 대역폭을 사용하여 각 출력 토큰을 순차적으로 생성합니다. 두 개의 LLM 추론 단계를 두 개의 개별 머신 풀로 분리하는 것 외에도 Microsoft는 실시간 계산 요구에 따라 동적으로 크기가 조정되는 프롬프트 및 토큰 단계 전반의 혼합 일괄 처리를 위해 세 번째 머신 풀을 사용했습니다.

Splitwise를 사용하여 Microsoft는 다음을 달성할 수 있었습니다.

- 현재 설계보다 1.4% 저렴한 비용으로 20배 더 높은 처리량을 제공합니다.

- 동일한 비용과 전력 예산으로 2.35배 더 많은 처리량을 제공합니다.

Splitwise는 LLM 추론 효율성과 지속 가능성의 획기적인 발전입니다. 프롬프트 단계와 토큰 단계를 분리함으로써 Splitwise는 GPU 사용의 새로운 잠재력을 발휘하고 클라우드 공급자가 동일한 전력 예산으로 더 많은 쿼리를 더 빠르게 처리할 수 있도록 합니다. Splitwise는 이제 vLLM의 일부이며 다른 프레임워크와 함께 구현될 수도 있습니다. Microsoft Azure의 연구원들은 LLM 추론을 보다 효율적이고 지속 가능하게 만들기 위한 작업을 계속하고 최대 처리량, 비용 절감 및 전력 효율성을 촉진하는 맞춤형 머신 풀을 구상할 계획입니다.