Microsoft Research מציגה את Splitwise, טכניקה חדשה להגברת יעילות ה-GPU עבור דגמי שפות גדולות

2 דקות לקרוא

פורסם ב

קרא את דף הגילויים שלנו כדי לגלות כיצד תוכל לעזור ל-MSPoweruser לקיים את צוות העריכה קראו עוד

הערות עיקריות

- Splitwise היא פריצת דרך ביעילות מסקנות LLM ובקיימות.

- על ידי הפרדת שלבי ההנחיה והאסימון, Splitwise פותחת פוטנציאל חדש בשימוש ב-GPU ומאפשרת לספקי ענן להגיש יותר שאילתות מהר יותר תחת אותו תקציב כוח.

מודלים של שפה גדולים (LLMs) משנים את תחומי עיבוד השפה הטבעית והבינה המלאכותית, ומאפשרים יישומים כגון יצירת קוד, סוכני שיחה וסיכום טקסט. עם זאת, מודלים אלה גם מציבים אתגרים משמעותיים עבור ספקי ענן, שצריכים לפרוס יותר ויותר יחידות עיבוד גרפיות (GPU) כדי לענות על הדרישה הגוברת להסקת LLM.

הבעיה היא שמעבדי GPU הם לא רק יקרים, אלא גם זוללים בכוח, והיכולת לספק את החשמל הדרוש להפעלתם מוגבלת. כתוצאה מכך, ספקי ענן מתמודדים לעתים קרובות עם הדילמה של דחיית שאילתות משתמשים או הגדלת עלויות התפעול וההשפעה הסביבתית שלהם.

כדי לטפל בבעיה זו, חוקרים ב-Microsoft Azure פיתחו טכניקה חדשה בשם פיצול, שמטרתה להפוך מסקנות LLM ליעילה יותר ובר קיימא על ידי פיצול החישוב לשני שלבים נפרדים והקצאתם למכונות שונות. אתה יכול לקרוא על טכניקה זו בפירוט ב"Splitwise: הסקת LLM יעילה באמצעות פיצול שלבים" עבודת מחקר.

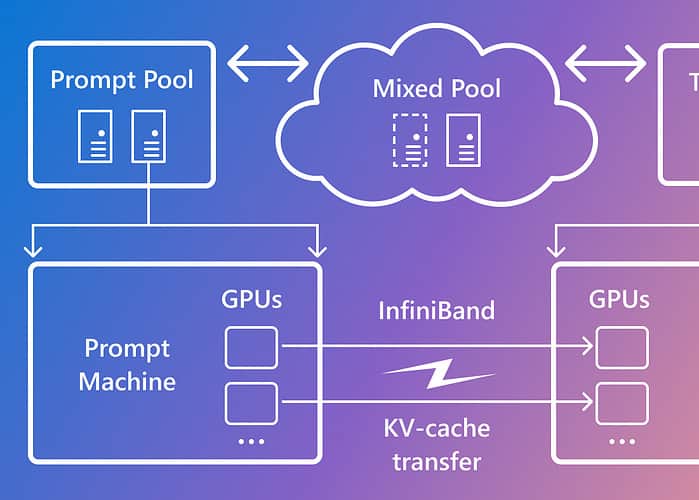

Splitwise מבוססת על התצפית שהסקת LLM מורכבת משני שלבים בעלי מאפיינים שונים: שלב ההנחיה ושלב יצירת האסימון. בשלב ההנחיה, המודל מעבד את קלט המשתמש, או ההנחיה, במקביל, תוך שימוש בהרבה מחשוב GPU. בשלב יצירת האסימון, המודל מייצר כל אסימון פלט ברצף, תוך שימוש בהרבה רוחב פס של זיכרון GPU. בנוסף להפרדת שני שלבי ההסקת ה-LLM לשני מאגרי מכונות נפרדים, מיקרוסופט השתמשה במאגר מכונות שלישי עבור אצווה מעורבת על פני שלבי ההנחיה והאסימון, בגודל דינמי על בסיס דרישות חישוביות בזמן אמת.

באמצעות Splitwise, מיקרוסופט הצליחה להשיג את הדברים הבאים:

- תפוקה גבוהה פי 1.4 בעלות נמוכה ב-20% מהעיצובים הנוכחיים.

- תפוקה גדולה פי 2.35 עם אותם תקציבי עלויות והספק.

Splitwise היא פריצת דרך ביעילות מסקנות LLM ובקיימות. על ידי הפרדת שלבי ההנחיה והאסימון, Splitwise פותחת פוטנציאל חדש בשימוש ב-GPU ומאפשרת לספקי ענן להגיש יותר שאילתות מהר יותר תחת אותו תקציב כוח. Splitwise היא כעת חלק מ-vLLM וניתן ליישם אותה גם עם מסגרות אחרות. החוקרים ב-Microsoft Azure מתכננים להמשיך בעבודתם על הפיכת מסקנות LLM ליעילה ובר קיימא יותר, וחוזים בריכות מכונות מותאמות המניעות תפוקה מקסימלית, עלויות מופחתות ויעילות חשמל.