Microsoft Orca-Math הוא מודל שפה קטן שיכול להתעלות על GPT-3.5 ו-Gemini Pro בפתרון בעיות מתמטיקה

2 דקות לקרוא

פורסם ב

קרא את דף הגילויים שלנו כדי לגלות כיצד תוכל לעזור ל-MSPoweruser לקיים את צוות העריכה קראו עוד

הערות עיקריות

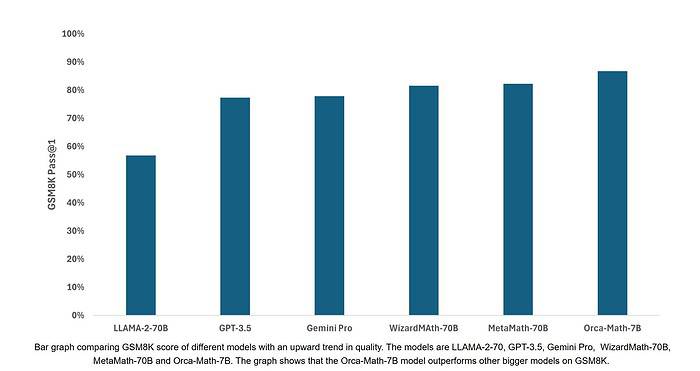

- לפי מדדים, Orca-Math השיגה 86.81% ב-GSM8k pass@1.

- המספר הזה מנצח את ה-LLAMA-2-70 של Meta, את Gemini Pro של גוגל, את ה-GPT-3.5 של OpenAI ואפילו דגמים ספציפיים למתמטיקה כמו MetaMath-70B ו-WizardMa8th-70B.

מחקר של מיקרוסופט היום הודיע Orca-Math, מודל שפה קטן (SLM) שיכול להתעלות על דגמים גדולים בהרבה כמו Gemini Pro ו-GPT-3.5 בפתרון בעיות מתמטיקה. Orca-Math מדגימה כיצד SLMs מיוחדים יכולים להצטיין בתחומים ספציפיים, אפילו לעלות על דגמים גדולים יותר. חשוב לציין שדגם זה לא נוצר מאפס על ידי מיקרוסופט, במקום זאת דגם זה נוצר על ידי כוונון עדין של דגם Mistral 7B.

לפי מדדים, Orca-Math השיגה 86.81% ב-GSM8k pass@1. המספר הזה מנצח את ה-LLAMA-2-70 של Meta, את Gemini Pro של גוגל, את ה-GPT-3.5 של OpenAI ואפילו דגמים ספציפיים למתמטיקה כמו MetaMath-70B ו-WizardMa8th-70B. חשוב לציין שדגם הבסיס Mistral-7B שעל בסיסו נבנתה Orca-Math השיג רק 37.83% ב-GSM8K.

Microsoft Research הצליחה להשיג ביצועים מרשימים אלה על ידי ביצוע הטכניקות הבאות:

- נתונים סינתטיים באיכות גבוהה: Orca-Math הוכשרה על מערך נתונים של 200,000 בעיות מתמטיקה, מעוצב בקפידה באמצעות ריבוי סוכנים (AutoGen). אמנם מערך נתונים זה קטן יותר מכמה מערכי נתונים אחרים למתמטיקה, אך הוא אפשר אימון מהיר וחסכוני יותר.

- תהליך למידה איטרטיבי: בנוסף לכוונון עדין בפיקוח מסורתי, Orca-Math עבר תהליך למידה איטרטיבי. הוא תרגל פתרון בעיות והשתפר ללא הרף בהתבסס על משוב מאות "מורה".

"הממצאים שלנו מראים שדגמים קטנים יותר הם בעלי ערך במסגרות מיוחדות שבהן הם יכולים להתאים לביצועים של דגמים גדולים בהרבה, אך עם היקף מוגבל. על ידי אימון של Orca-Math על מערך נתונים קטן של 200,000 בעיות מתמטיקה, השגנו רמות ביצועים מתחרות או עולות על אלו של מודלים גדולים בהרבה", כתב צוות המחקר של מיקרוסופט.