Microsoft Azure AI חושפת 'מגנים מהירה' כדי להילחם במניפולציות של LLM

2 דקות לקרוא

פורסם ב

קרא את דף הגילויים שלנו כדי לגלות כיצד תוכל לעזור ל-MSPoweruser לקיים את צוות העריכה קראו עוד

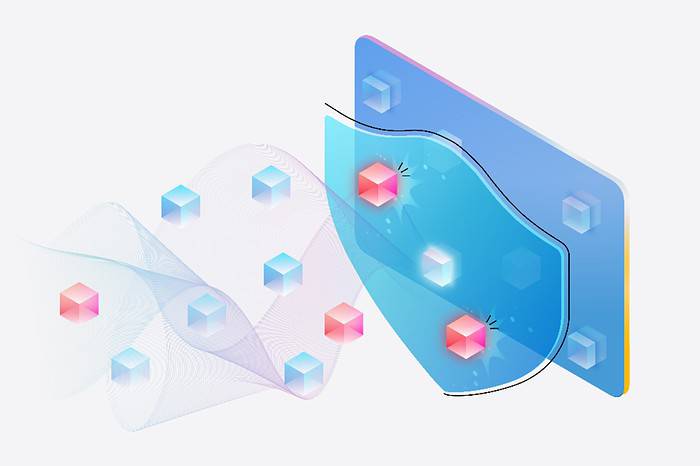

מיקרוסופט היום הודיע שיפור אבטחה משמעותי עבור הפלטפורמות Azure OpenAI Service ו-Azure AI Content Safety. הפיצ'ר החדש, שזכה לכינוי "Prompt Shields", מציע הגנה חזקה מפני התקפות מתוחכמות יותר ויותר המכוונות למודלים של שפות גדולות (LLMs).

Prompt Shields מגן מפני:

- התקפות ישירות: הניסיונות הללו, הידועים גם בתור התקפות פריצת מעצר, מנחות במפורש את ה-LLM להתעלם מפרוטוקולי בטיחות או לבצע פעולות זדוניות.

- התקפות עקיפות: התקפות אלו מטמיעות בעדינות הוראות מזיקות בתוך טקסט רגיל לכאורה, במטרה להערים על ה-LLM להתנהגות בלתי רצויה.

Prompt Shields משולבת עם מסנני תוכן Azure OpenAI Service וזמינים ב-Azure AI Content Safety. הודות לאלגוריתמים מתקדמים של למידת מכונה ועיבוד שפה טבעית, Prompt Shields יכול לזהות ולנטרל איומים פוטנציאליים בהודעות משתמש ובנתונים של צד שלישי.

זרקור: טכניקת הגנה חדשה

מיקרוסופט הציגה גם את "Spotlighting", גישה הנדסית דחופה מיוחדת שנועדה לסכל התקפות עקיפות. טכניקות זרקור, כגון תוחמות וסימון נתונים, עוזרות ל-LLM להבחין בבירור בין הוראות לגיטימיות לבין פקודות מוטמעות שעלולות להזיק.

זמינות

Prompt Shields נמצא כעת בתצוגה מקדימה ציבורית כחלק מ-Azure AI Content Safety ויהיה זמין בשירות Azure OpenAI ב-1 באפריל. שילוב ב-Azure AI Studio מתוכנן בעתיד הקרוב.