Samsung ordina il divieto generativo dell'IA ai dipendenti a causa di problemi di sicurezza

3 minuto. leggere

Edizione del

Leggi la nostra pagina informativa per scoprire come puoi aiutare MSPoweruser a sostenere il team editoriale Per saperne di più

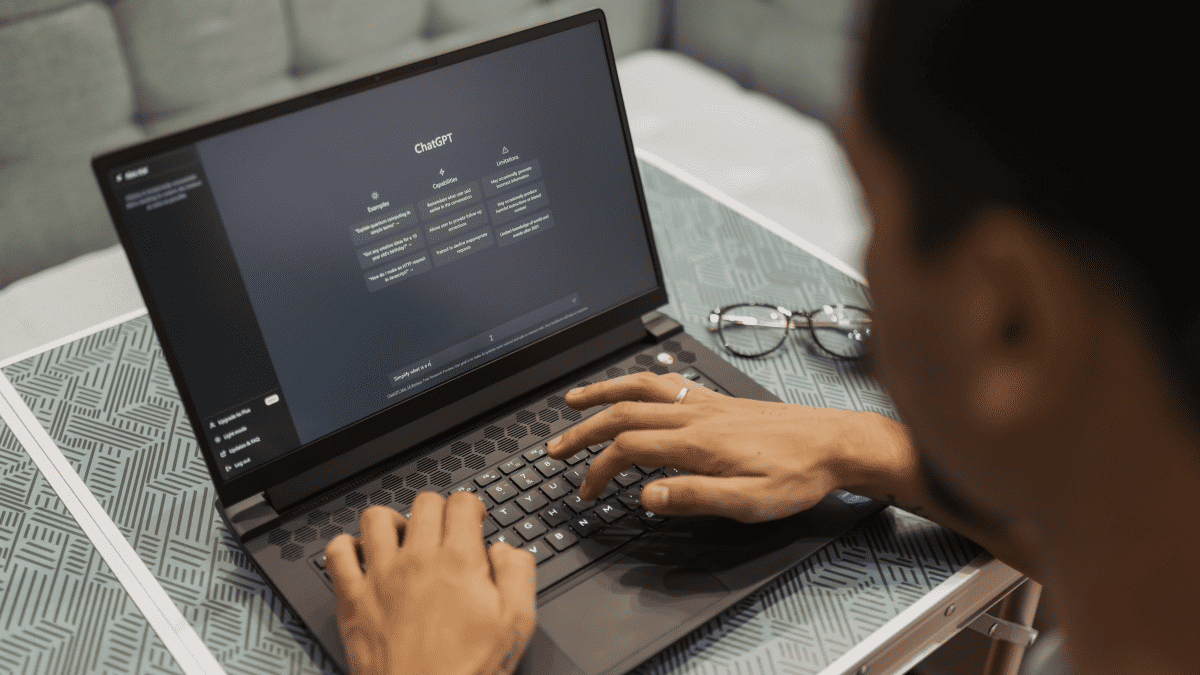

Samsung non vuole che il suo staff si fidi completamente dell'IA generativa ChatGPT quando si tratta di informazioni sensibili dell'azienda. Pertanto, l'azienda sudcoreana sta ora vietando l'uso di servizi di intelligenza artificiale generativa all'interno della sua forza lavoro.

"Vi chiediamo di aderire diligentemente alle nostre linee guida sulla sicurezza e il mancato rispetto di ciò potrebbe comportare una violazione o compromissione delle informazioni aziendali con conseguente azione disciplinare fino alla cessazione del rapporto di lavoro", ha affermato Samsung in un promemoria esaminato da Bloomberg News.

Secondo il rapporto, la società ha condotto un sondaggio ad aprile, mostrando che il 65% degli intervistati riteneva che l'utilizzo di strumenti di intelligenza artificiale sul posto di lavoro potesse tradursi in possibili problemi di sicurezza. È interessante notare che Samsung ha anche scoperto il mese scorso che alcuni dei suoi ingegneri hanno "accidentalmente" fatto trapelare il codice sorgente interno quando lo hanno caricato su ChatGPT ad aprile.

Il rapporto ha condiviso che Samsung ha rilasciato il promemoria sottolineando i problemi di sicurezza. Teme che le informazioni riservate inviate agli strumenti di intelligenza artificiale siano archiviate su server esterni, che sfuggono al controllo di Samsung e potrebbero portare a fughe di notizie pubbliche.

Il promemoria ha avvertito il personale di una divisione specifica sull'utilizzo di strumenti di intelligenza artificiale generativa e li ha incoraggiati a seguire le politiche aziendali, sottolineando che coloro che si rifiutano di farlo potrebbero essere puniti. Nonostante l'avvertimento, Samsung ha notato nel promemoria allo staff che sarebbe stato temporaneo, condividendo le intenzioni di "creare un ambiente sicuro" per l'utilizzo di tecnologie come ChatGPT.

"HQ sta rivedendo le misure di sicurezza per creare un ambiente sicuro per l'utilizzo sicuro dell'IA generativa per migliorare la produttività e l'efficienza dei dipendenti", si legge nel promemoria. "Tuttavia, fino a quando queste misure non saranno preparate, stiamo temporaneamente limitando l'uso dell'IA generativa".

Samsung si è unita ad altre società (ad esempio, JPMorgan Chase & Co., Bank of America Corp. e Citigroup Inc.) che hanno già vietato l'uso dell'IA generativa nei rispettivi luoghi a causa delle stesse preoccupazioni. Il passaggio da tali società, tuttavia, non è una sorpresa, soprattutto dopo un recente bug di ChatGPT che ha esposto temporaneamente la cronologia della chat e forse le informazioni di pagamento. E dato che OpenAI potrebbe accedere alle informazioni fornite alla sua creazione ChatGPT, le aziende hanno tutto il diritto di temere l'uso da parte dei propri dipendenti di tale strumento di intelligenza artificiale.

Nonostante ciò, OpenAI è sempre stata esplicita nell'avvertire i suoi utenti di non condividere "alcuna informazione sensibile". COME ha spiegato dalla stessa OpenAI, "può utilizzare i Contenuti che ci fornisci per migliorare i nostri Servizi, ad esempio per addestrare i modelli che alimentano ChatGPT". È importante notare, tuttavia, che ChatGPT ha già una funzione di modalità di navigazione in incognito. Tuttavia, potrebbe non essere ancora una garanzia sufficiente per le aziende, soprattutto perché un semplice problema di sicurezza potrebbe comportare un enorme disastro aziendale.