Microsoft e NVIDIA annunciano il modello linguistico più grande e potente addestrato fino ad oggi

1 minuto. leggere

Edizione del

Leggi la nostra pagina informativa per scoprire come puoi aiutare MSPoweruser a sostenere il team editoriale Per saperne di più

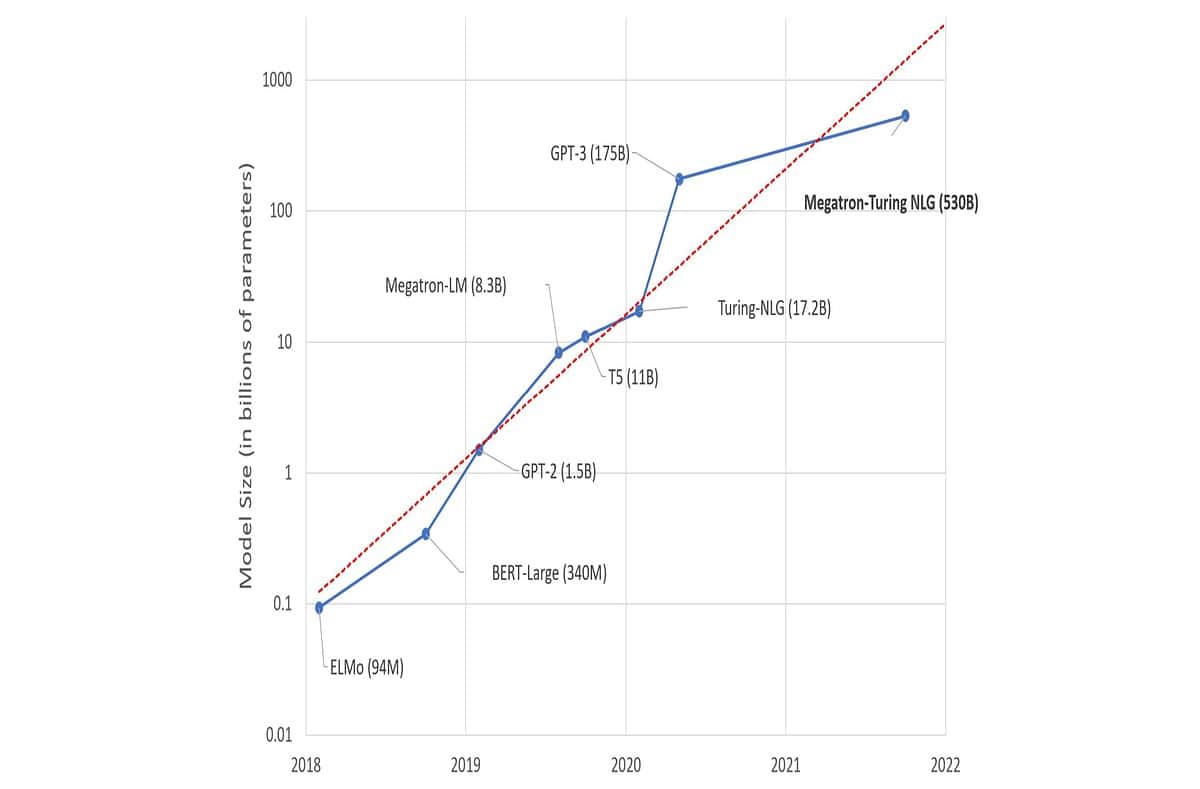

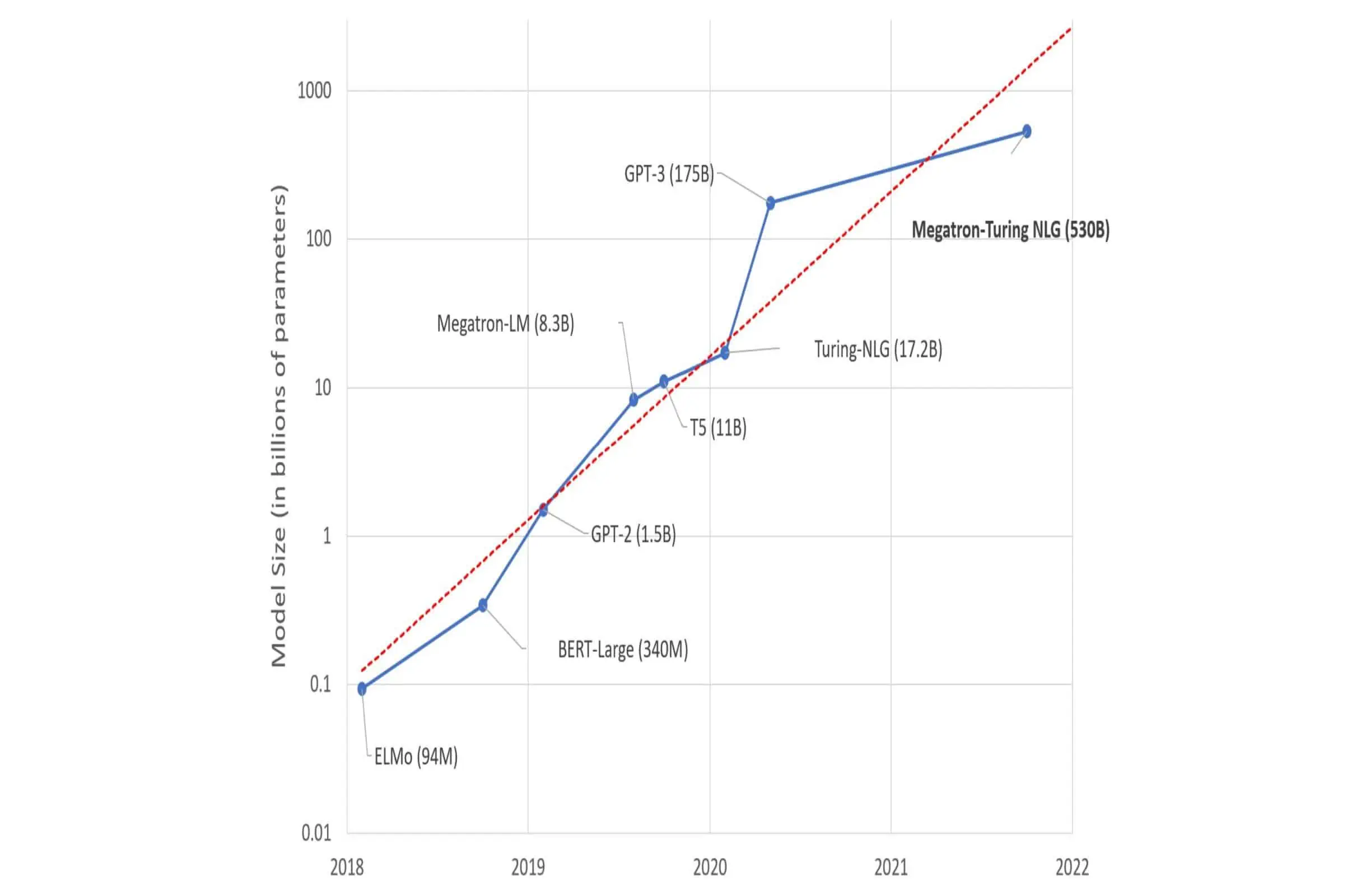

Microsoft e NVIDIA hanno annunciato oggi il modello Megatron-Turing Natural Language Generation (MT-NLG) basato su DeepSpeed e Megatron, il più grande e potente modello di linguaggio del trasformatore monolitico addestrato fino ad oggi. Questo modello include 530 miliardi di parametri, 3 volte il numero di parametri rispetto al modello più grande esistente, GPT-3. La formazione di un modello così grande comporta varie sfide. NVIDIA e Microsoft hanno lavorato a molte innovazioni e scoperte lungo tutti gli assi dell'IA.

Ad esempio, lavorando a stretto contatto, NVIDIA e Microsoft hanno raggiunto un'efficienza di formazione senza precedenti facendo convergere un'infrastruttura di formazione all'avanguardia con accelerazione GPU con uno stack software di apprendimento distribuito all'avanguardia. Abbiamo creato corpora di formazione in linguaggio naturale di alta qualità con centinaia di miliardi di token e sviluppato insieme ricette di formazione per migliorare l'efficienza e la stabilità dell'ottimizzazione.

Puoi saperne di più su questo progetto dai link sottostanti.